本文来自微信公众号:青野有枯荣(ID:Tsingyeh_Story),作者:青野Tsingyeh,题图来自:《2001太空漫游》

最近ChatGPT在各大新闻媒体的热度居高不下,从其对学术规范的冲击到替代谷歌的争议,都可以感受到扑面而来的颠覆性。相对于搜索引擎仍然给人保留了相当一部分信息检索的主动性,ChatGPT几乎是万能管家——它直接提供唯一的答案和解决方案。也因而,它引发了人们普遍的危机感:既然如此,它是否将替代掉我的工作?

作为一个经常“负责解答万事万物”宏观研究员,驱使我接触ChatGPT的一方面是好奇,另一方面也是“被替代”的恐惧——毕竟我们所做的几乎是同行。我花了2天左右的时间与ChatGPT进行各个层面的对话,尝试弄清这台“机器”的能与不能,进而评估两个问题:

1. ChatGPT一进门,是否可以代替屋里所有人?

2. 什么样的特性可以避免被AI替代,并且驾驭AI?

我与ChatGPT的问答主要涉及以下几种类型,我将分别用星级代表我对ChatGPT在此方面实际能力的评估:

①事实/史实★★★☆☆

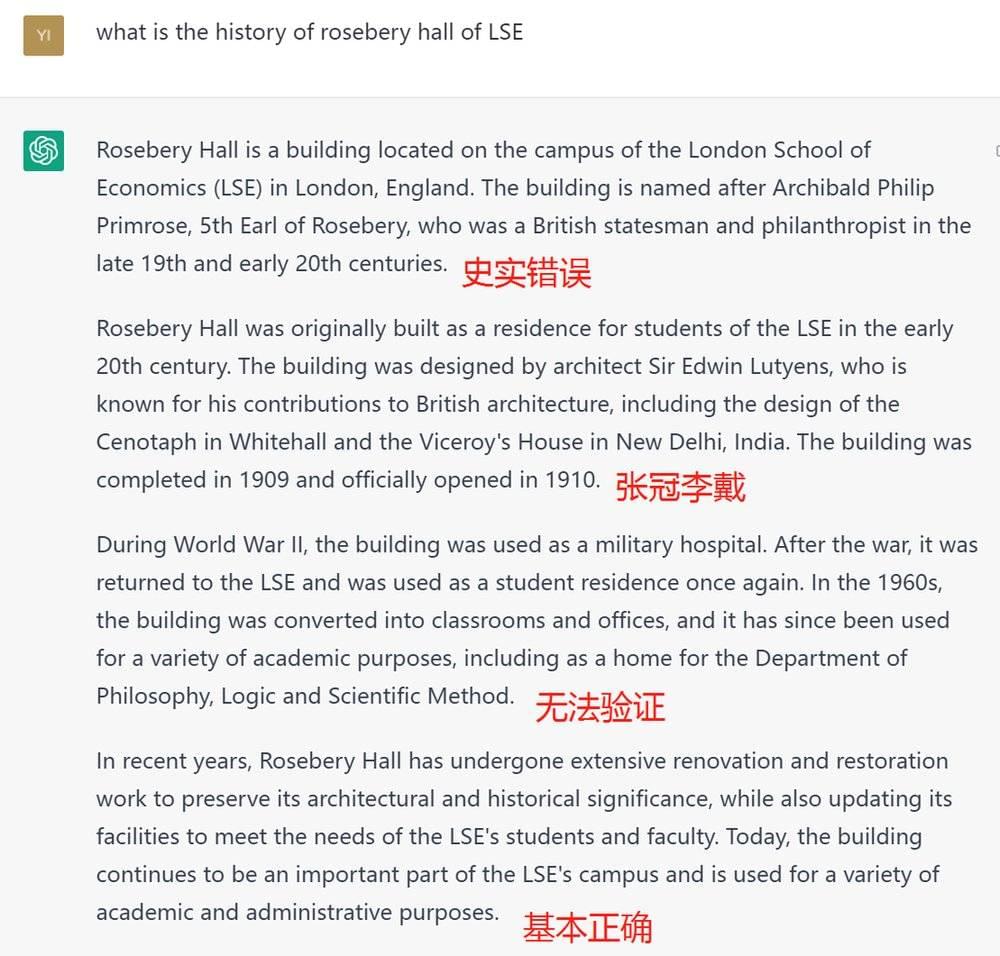

对于大部分公开资料充分的事实,ChatGPT能进行简单并清晰的总结。但有一点引起了我的注意,即在一些冷门事实上,ChatGPT会发生明显的张冠李戴、移花接木的情况,但它清晰和毋庸置疑的语法对读者构成了陷阱。

我向AI询问我研究生时代宿舍楼的历史,可以看到ChatGPT陈述得相当,然而我自己的检索却无法验证其中的大部分内容,反而找到一些证据指向ChatGPT可能基于错误的关键词联想,将这栋楼与另外的建筑搞混了。同样的问题也出现在我询问ChatGPT我的工作单位所在的建筑历史时。显然,ChatGPT在处理这些问题方面只是“随口编了个通顺的故事”。

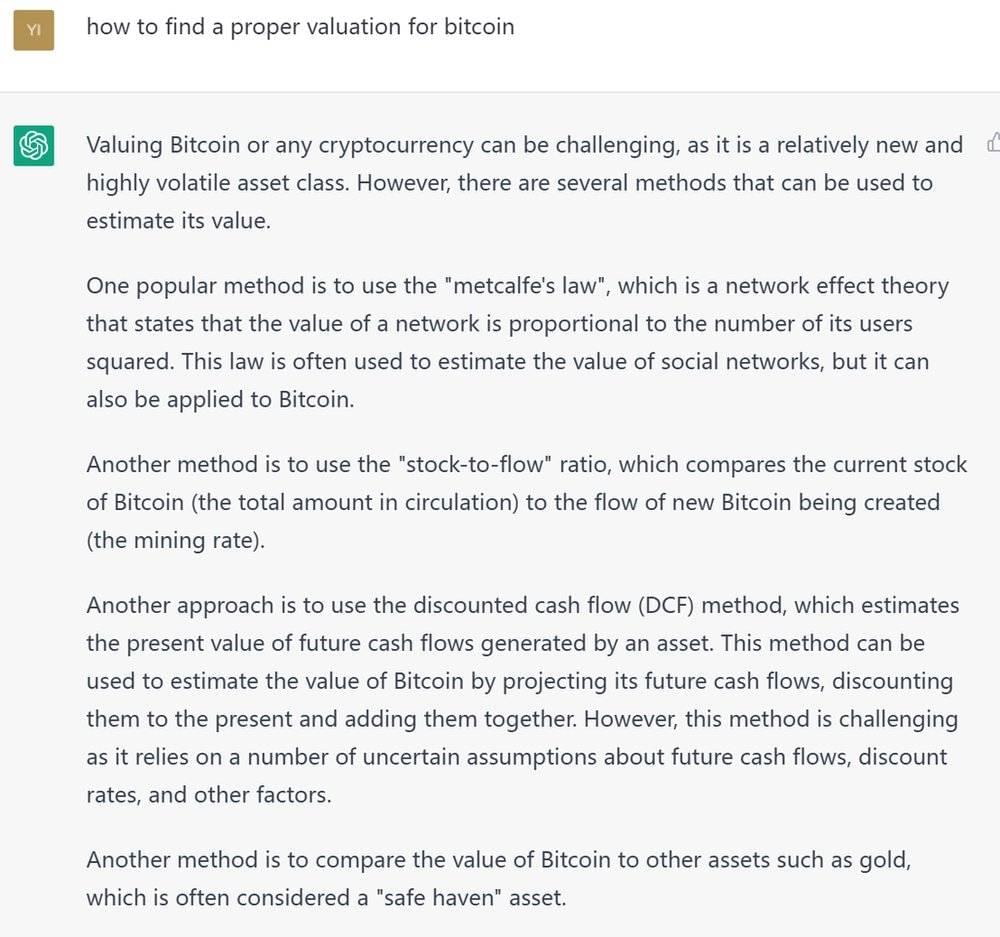

②原理/方法/机制★★★★★

这方面我向ChatGPT的提问内容涉及:经济、物理、甚至是黄焖鸡米饭的制作方法。如果你尝试问明确地问一个已经被研究得很成熟的问题,大概率能得到一个非常系统性的回答。在回答中可以看到,ChatGPT在结构化写作方面的优势非常突出,回答精炼通顺、要点明确,十分易于读者快速理解。

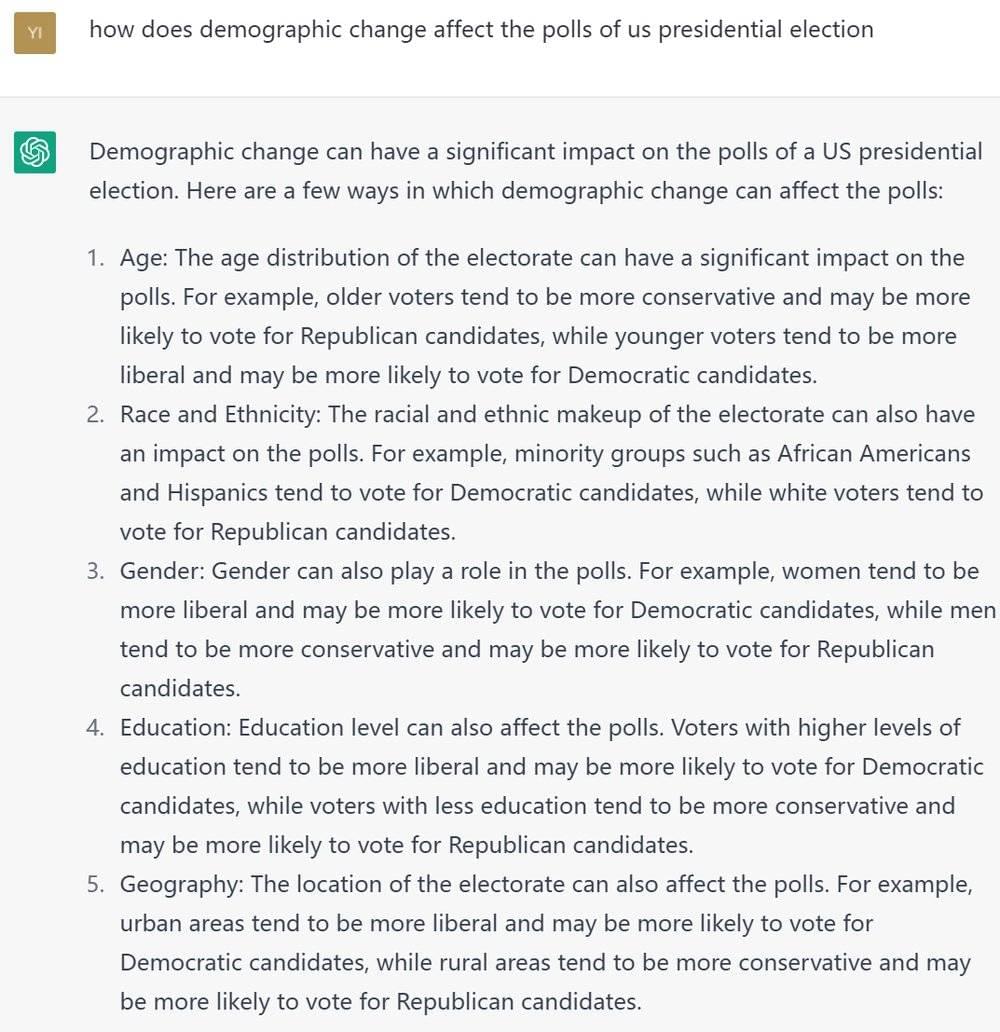

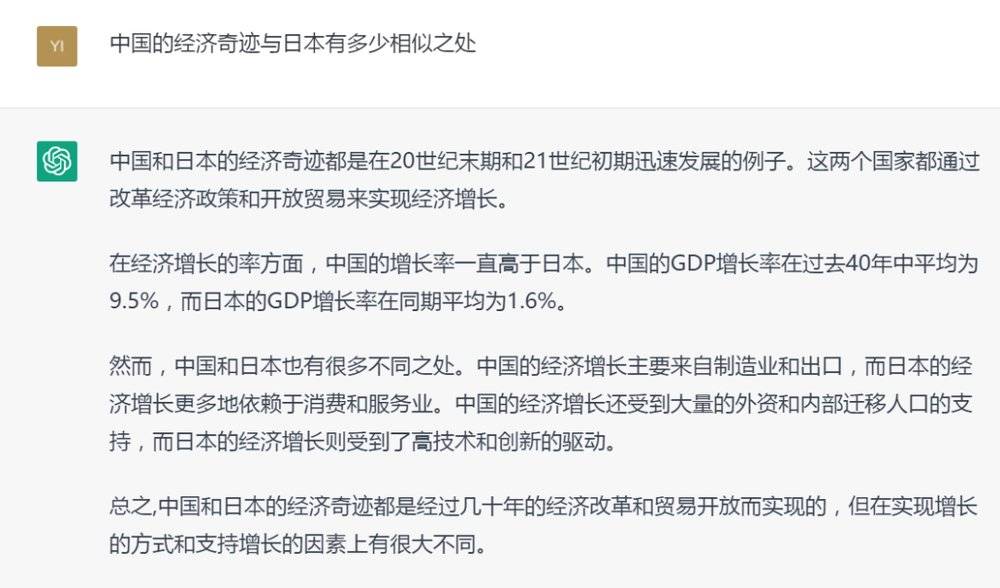

③对比/评估★★★★☆

这方面我对ChatGPT提问涉及电池的不同技术路线、国别间货币政策框架、方言的差异等。可以发现,ChatGPT进行概念对比并不完全依托既定材料的结论,而是遵循了分类-比较的逻辑思路。不过需要注意的是,在对比复杂成因的事物(比如经济模式等)时,ChatGPT似乎会犯下静态比较等等错误,并可能会错过一些非常重要的深层因素。

④议论/评价★★★☆☆

如果让ChatGPT评价既有研究比较充分的领域(比如说政策评价等),ChatGPT同样能发挥出结构化写作的相当优势。但在涉及具体人物/政策/哲学困境/审美等的评价上,AI基本上采取了开放、中立、或是官方立场,目前似乎不能指望AI展现出明显的政治/哲学/美学倾向。

⑤预测/即时分析★☆☆☆☆

目前为止,ChatGPT无法预测未来也拒绝预测未来。ChatGPT同样无法分析正在发生的事件和数据,问到此类问题是,ChatGPT会直接建议你去寻求权威发布机构和专业观点的支持。

⑥创作/建构

这部分无法由人类评价,我只能说AI的创造可能提供了另一种审美的视角,但如何评价则因人而异。比如以下的这番创作,使我感到些许奇妙,但其文笔又很难说能打动人。

总结来说,目前已知的ChatGPT的特性有(长处显而易见,这里主要聊聊短板):

1. AI的回答可能是真假交织或不完整的,具有相当的迷惑性;

2. AI目前无法获取非公开的事实和结论;

3. AI无法预测,无法对不同的观点赋予权重,也无法进行及时、具体场景的分析;

4. AI无法提供主观和价值层面的判断。

从目前ChatGPT所提供回答质量来看,我仍然认为Google和Wiki等简单易行的替代渠道在多数情形下能提供更优质的信息,而在专业的领域内,专业的信息渠道和检索能力将更占有压倒性优势。不过我也相信,随着时间推移,以上1、2、3点短板都可能得到改进,但其中隐含的一个关键问题可能很难被解决:我们在获得ChatGPT回答的同时,并没有被告知其背后的信息来源和处理过程,亦不知道ChatGPT在回答过程中省略了什么。在更宏观的维度上,AI对事实的误解和扭曲可能具有广泛的社会危害,进而挑战我们的集体记忆与共识。我们需要认真地从社会和个人两个层面来思考AI时代的诸多“何去何从”。

在与ChatGPT聊天时,我时常感觉到自己在疑惑:与我对话的这台机器是否真的在思考,抑或是,它只是用流畅的语法来让我觉得它在思考,而它实际上或许只是概率的运算,并不“理解”自己在说什么?正因如此,它才会有以上种种缺陷,甚至是“一本正经地胡说八道”。

不过,我对其底层技术的细节十分外行,这个问题似乎更多是留给“图灵测试”等哲学话题了。不过我想,既然现代的语言哲学已经揭示了语言对于思维塑造的重要性,那么既然AI能够熟练地运用语言框架,我们或许也不能完全拒绝承认AI可能拥有了思考的能力——也因而,AI与人类的竞争必然存在。

就输出的结果而言,ChatGPT和人类的“研究员”们(不幸的是,我正是其中一员)有很多相似点——他们都向受众提供了“似然正确的答案”。考虑到AI未来非线性发展的路径,它们所能提供的“似然正确性”还会明显地提升,或许很快我们便将看到AI与人类的“研究员”的直接竞争,而这在金融领域内或许会十分明显。

我时常会听到类似这样的灵魂拷问:究竟是真相重要还是回答重要?如果是后者的话,那么研究员似乎确实没有什么存在的价值了。但这个问题显然不能如此消极地回答,我想更为重要的是思考:人类将如何证明其驾驭AI、而非被AI驾驭的价值呢?什么样的态度和能力是重要的呢?我思忖了一些时间,有一些未必成熟的想法:

发现和提问的能力:如果答案终将跟随算力变得越来越廉价,那么发现并精确地描述的问题,其价值将更胜于答案;

独立与批判性的逻辑框架:我们将越来越频繁地面对各类虚假事实和错误结论的挑战,扎实的知识储备是必要的,同样也需要独立、警惕和批判的态度,以及对任何信息进行交叉验真的技能也必不可少。

深度独创研究的能力:AI归纳梗概的高效率和清晰的结构性表达,将使得涉及浅层知识的内容创造和传播变得极端高效,以及冗余。而研究者需要拥有的竞争优势在于:用深度、独创、实在的研究,对浅知识形成压倒性的增强。

信息赋权和决策的能力:我不怀疑AI最终会具备一定的预测能力。但人类所不同的是,我们对信息作出自己的赋权,并作出决策、付诸行动。我们的精力将越来越注重终端的决策,提高决策的胜率、并降低错误决策的影响,将是人类越来越不能回避的问题。

杜绝语言的腐败:这一点想法,来源于我看到的一篇用ChatGPT做的城市发展远景规划,其中竟也充斥着相当多官样文章。Rubbish in rubbish out,我们太习惯用复杂的语言来掩饰真实的目的、扼杀创新的想法,既然AI提供了语言使用的一种新的形式,创造了新的可能,我们是否可以改变“语言的腐败”?——精炼直白,直抵核心。

行文至此,我也想到人类玩家的另一个、或许也是最凸出优势:相比起AI而言,大多数人在很长一段时间内仍将更愿意相信人类。何然?人未必比AI更为正确,但具体的人可以成为明确归咎的主体,而他们对价值的鲜明坚持也使得他们更为鲜活可爱。我想最重要(也可能是有点中二)的一点,是要有身为人类的觉悟,承担起全部的风险和责任,勇敢地进入与AI——这个人类造物共存的新世界。

本文来自微信公众号:青野有枯荣(ID:Tsingyeh_Story),作者:青野Tsingyeh