本文来自微信公众号:腾讯媒体研究院 (ID:TencentMRI),作者:井婷婷、张浩,原文标题:《后真相的时代,如何对抗虚假信息,拯救用户的时间价值?| 时间会客厅》,题图来源:《超验骇客》

近年来,随着信息媒介的多元化发展,网络谣言的传播也愈演愈烈,给社会以及个人带来了诸多负面影响。近日,网红泰国旅游失联、去泰国旅游会被“噶腰子”(指“器官交易”)的传言在网络上热度颇高,甚至引起了泰国高层的关注,联系到之前“胡某宇事件”“粉发女孩被造谣离世事件”的发生,谣言不仅会误导公众,还会造成严重的社会危害。这些事件的频发,让谣言治理的相关议题再次引发学界和业界的广泛关注。

而就在3月10日,中央网信办部署开展为期两个月的“清朗·从严整治‘自媒体’乱象”专项行动,该行动聚焦社交、短视频、网络直播等类型重点平台,针对“自媒体”造谣传谣、假冒仿冒、违规营利等突出问题,坚决打击,从严处置,营造清朗网络空间。

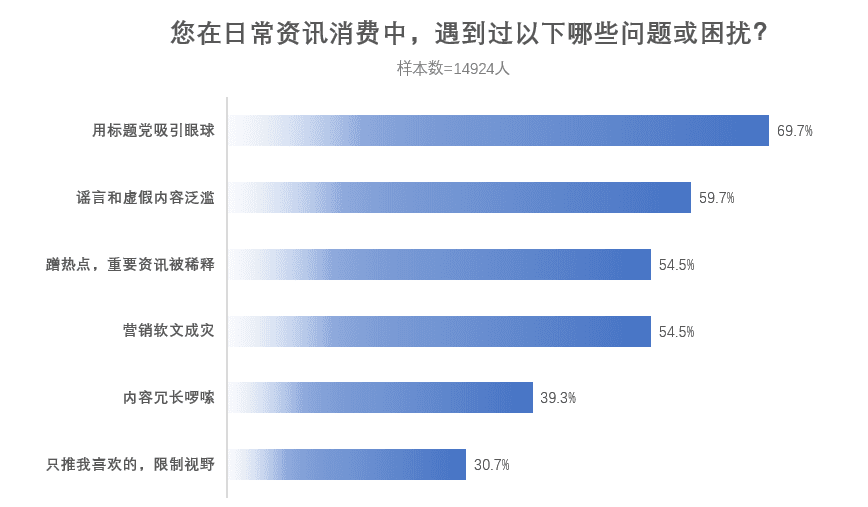

在这个背景下,腾讯媒体研究院发布了以“你对虚假信息怎么看?”为主题的用户调研。根据调研结果显示,在日常资讯消费中,其中有将近六成用户受到过谣言和虚假信息的困扰,已经成为影响用户获取信息效率的主要因素。

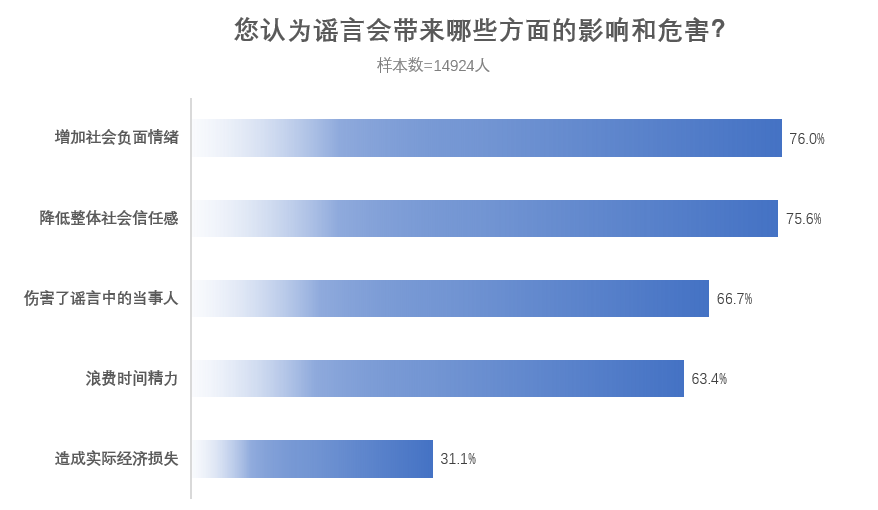

调研还显示,当前内容资讯领域存在很多的虚假、低质和占用用户时间的不实信息,不仅会误导用户,占用用户大量的时间,还会降低用户的生活质量,使大众产生负面的社会情绪(76.0%)和对社会的不信任感(75.6%)。

当下,尽管用户在获取信息的途径以及数量上,与过去相比便捷且数量庞大,但也正因为信息过于繁杂和混乱,使得用户不得不浪费大量的时间去验证和筛选“有用的”信息。在这个过程中,用户不但需要投入更多精力,同时也会因为谣言的存在经历信任瓦解以及重建的过程。所以,如何提升用户获取信息的效率,如何保证信息的真实可靠性,如何进行科学辟谣等诸多问题,现已成为学界和业界广泛关注和讨论的议题。

针对以上这些问题,腾讯新闻智库类栏目《时间会客厅》近期与赵子忠(中国传媒大学新媒体研究院院长)、周葆华(复旦大学新闻学院副院长)、李怡清(澎湃新闻国际新闻部副总监兼主编)以及宋建华(北青深一度主编)这几位传媒行业的学者、新闻媒体行业的一线从业者,进行了对话,通过对虚假信息的成因、传播以及杜绝虚假信息以提升受众时间价值的对策进行了讨论,希望对行业从业者有所帮助。

一、谣言为何频繁出现?

事实上,虚假信息的现象起源可以追溯到很久以前,自人类有传播现象始,真相便与谣言相生相伴。但在互联网和社交媒体的普及之后,信息的传播更加快速和便捷,虚假信息的泛滥变得更加普遍和突出。

从社会控制、信息安全与技术证实等角度看,“谣言”被定义为“在社会中出现并流传的未经官方公开证实或者已经被官方所辟谣的信息”

据相关报道显示,自2022年8月以来,中央网信办举报中心组织12家网站平台持续开展网络辟谣标签工作,对涉及疫情防控、卫生健康、食品安全、教育就业等领域网民反映强烈的网络谣言进行查证和标记。截至2月2日,通过中国互联网联合辟谣平台发布425条辟谣标签,各大网站平台依据辟谣标签对25万余条谣言进行标记。【1】这说明,网络上的虚假信息和谣言存在十分普遍。那么谣言为什么会频繁出现呢?一线的媒体工作者以及学界分别发表了自己的看法:

李怡清:虚假信息的出现和传播是有多种因素造成的。就目前来看,舆论场上涉及国外事件的虚假信息能够带来显著的流量和收益,“造谣”成本低,也鲜少会因此付出很大代价,因此滋生了国际谣言的泛滥。这些被虚构的信息,往往是非同寻常的、具有刺激性的,有人愿意看,有人愿意信,甚至进一步“转评赞”三连,这就有了谣言传播的空间和造谣的动因。

在实际操作过程中,我们发现,在国内外的社交平台上都有一些发布虚假信息的“常客”,我们“澎湃明查”的读者也能一眼辨认,看到这些账号名字时会说“怎么又是他”。目前尚不确认这些账号背后是否有机构的系统性支持,但流量和话题度所带来的显性利益已经足够刺激他们有意造谣或无意地、不经核实地发布虚假信息。

周葆华:这与信息运行的基本状态有关,谣言或者假新闻频繁出现是信息供需之间不对等的一个常见状态。新闻或者信息在传播过程中,在传播和接受之间,往往有很大的时间差,再加上不同的传播主体,新的造假技术的不断更新,以及权威声音没有及时地出现,这些都会导致虚假信息的传播。

赵子忠:在“后真相时代”,由于传播模式的碎片化,事件呈现的不同状态以及时间顺序的不同,导致不同人群针对同样的事件会有不同的结论,这也是多元视角的一个体现。现在很多所谓虚假新闻,其实是因为视角片面导致的。因为一个事情的逻辑没有建构,发布的时间又快,求证的时间偏短,就会导致大量的内容像一个马赛克的拼图,这是讨论虚假信息泛滥的一个大背景。

总的来说,复杂而多元的网络传播环境,加上用户对于媒介信息的信任度下降,导致大量猜测与联想的发生,所以谣言便产生了。

二、为何谣言更有吸引力?

相较于常规信息,我们发现虚假信息或谣言的传播往往更有市场,吸引力更大,比起真相,为什么有时候大家更容易相信阴谋论呢?媒体以及学界的看法如下:

李怡清:谣言之所以有人看,在于它更符合受众的某种心理。比如说猎奇,比如说符合一种刻板印象,还有一种情况是网民对于一些事件缺乏基础认知,因为不了解,所以就会轻信谣言的内容。与真相相对比较平实相反,谣言往往能够引起人们的强烈情绪。

举个流传特别广的例子,俄乌冲突中,俄军对亚速钢铁厂进行围困的时候,一直传说钢铁厂里面有一条“大鱼”。那”大鱼”是什么?到底有没有“大鱼”,这些不确定的因素,都给谣言产生制造了空间,也让用户有了强烈了解的需求,与“有没有大鱼并不确定”这个相对比较无聊的“真相”相比,说“拜登的儿子在里面”“北约的将领在里面”,这样的故事更刺激,更加能够调动用户的味蕾,这就是谣言的吸引力所在。

赵子忠:说假新闻吸引力大其实也谈不上,只能说影响力很大。年轻人作为互联网上的原住民,对谣言和假新闻的识别度很高,他可能也跟着讨论,在网络上起哄一下,但是你看到的只是他的行为,不代表他的态度。

在这种情况下,谣言和假新闻的影响力为什么还会有?是因为“群氓效应”,“群氓效应”就是盲目跟随,而这种跟随是一种行为,不是一种态度。谣言和假新闻的传播可以理解为是用户的一个吃瓜行为,这种吃瓜行为的门槛很低,参与人数众多,从传播学效果的监测标准上,感觉影响力很大。但实际上这个假新闻很多时候是个戏剧化的事件像一个瓜,大家吃完就完了,大部分人不会关注后续,所以有时候,所谓的公关传播中的舆情管理,其实有点反应过度。

三、如何有效辟谣?

俗语说到:“造谣一张嘴,辟谣跑断腿”,如何让真相赶上谣言的脚步?另外,个别事件即便是官方公布了真相,但是还会有质疑声,这是为什么,如何有效辟谣?学界以及媒体的看法如下:

周葆华:这种辟谣了但不被公众相信的问题,首先跟辟谣主体的公信力有关,如果你本身就已经缺失了公信力,那么辟谣很难得到相信;另外也跟辟谣的具体方式有关,如果你的信息供给不具体,没有细节,那么这种辟谣就会被理解为是一个应对式的辟谣,所以也会继续引发质疑。

李怡清:首先,真相追赶上谣言的速度这个说法,需要分情况来看。一般有了谣言,才需要辟谣,而辟谣本身就是真相输出的过程,这是一个前后置的关系。然后再说有效辟谣,简单讲,有效就是要把真相全面地展示出来。

举个例子,去年达沃斯论坛期间CNN发了一个报道,内容援引的是美国一位议员的推特,是一张图片。内容的大概意思就是泽连斯基通过视频在达沃斯论坛发布演讲之后,全场观众都起立鼓掌,只有中国代表团拒绝起立鼓掌。针对这个引发热议的不实报道,新华社很快就发布了不实申明,但是公众仍然对此有争议。

后来,“澎湃明查”的做法是做核查,首先是核查图片里涉及的要素是否准确,比如人物,照片里的人是不是中国代表团的人,如果不是,就去做证明,告知公众照片里的这个人的真实身份。为了让真相更加立得住,还得核验照片产生的时间,后来我们发现同一时间段中国代表团是在跟联合国某个机构的负责人在一对一地会谈,有照片为证,也有时间也有标注,最终我们证明了照片中的人不是中方代表,并把真相进行深度还原并发布。

从后续的反馈中,我们发现很多当天早上还在说不相信的那些人,包括同行的业内的一些前辈,转发了我们的那篇核查报道,这就等于是认可了这样的一个核查结果。

所以就这个案例来说,当你告诉对方一个结果,就只是说真的、假的、不实的时候,对方是不一定会完全采信的,他可能会将信将疑或者不相信。但如果你告诉他一个完整的流程,包括我们一步一步的推导,包括最终的事实真相是什么,那就不仅仅是一个结果,而是整个事件的全貌是什么,那你的真相就很有分量,公众没有任何理由不去相信这个东西。甚至他可以按照你的路径去重新找一遍,还是会得出同样的结论,那这个结论就会是非常扎实的。

需要强调的是,在辟谣的过程中,有时候为了还原真相,会涉及一些隐私边界的问题,对此,要有一个基准线,就是私域和公共利益关系的界限:如果这个信息公布和公共利益是相关的,那它就需要被披露和公布;如果是一个非常私人的、非常猎奇的信息,那就肯定不属于媒体应该去披露和关注的内容了。比如说自杀或者是一个案件的受害人,那他受害的这些细节肯定不属于公共利益范畴内;但如果是一个在逃犯,那他的相貌、他的个人信息就属于公共安全性质的。

赵子忠:辟谣求真从社会意义角度上来讲,是一定是要去做的,因为求真是维护社会正常运行的一个基本基石。但是在求真的过程中,要注意方法手段,要注意对当事人隐私的保护,有些时候真实跟隐私是有关联的,要适度披露。求真的目的是为了鼓励社会的正向能量,应本着有利于社会发展的角度去做,而不能伤害当事人。比如说像网络暴力就是这个问题的典型代表,有些人需要批评,但不需要几千万人去批评,这几千万人为了批评这个人,舍弃了好多该做的社会贡献,也造成了公共资源的浪费。

四、如何从源头防止谣言出现!

如果说谣言的出现,具备不可控的特征,那我们可做的就是在生产的源头进行把控,尽量减少谣言输出的机会。在这方面,媒体端的经验,可能更加具备可操作性:

李怡清:从国际新闻的报道层面去看,一般出现Bug的机会,一个是翻译、编译,这个主要依靠编辑的专业性以及日常的积累,第二个就是可能信息源本身就有不实。第二种情况我们会有交叉印证,包括看这个消息源本身是不是靠谱,包括消息源针对这一事件的说法是不是靠谱。比如日常的国际新闻,肯定是全球的主流媒体或者当事国家的权威媒体是主要信源,相对比较靠谱。那在这个靠谱基础上,如果有个交叉印证,就是两家不同的媒体同时报道了同样的信息,那就说明没太大问题了。

如果是一些特别重大的信息,哪怕是某一家主流媒体报道了,也不能完全采信。需要进一步地寻找看有没有辅助印证的消息。当然,也有一些小报,相对而言靠谱性就差一些,在突发时间发生时,如果选择他们的信息,我们会比较谨慎,也会做进一步甄别。

宋建华:从国内新闻报道的层面去看,主要分为前、中、后三个阶段去防止假新闻的输出。采访前,要注意事出反常必有妖。越反常,越具有新闻性的内容,越要提高事实核实的等级,防止“失实报道”。采访中应为避免新闻失实,有三个应遵守的原则,分别是:采访到核心当事人、言之有“物”、关键事实三个独立信源互相印证。采访后,则需要外围信息佐证,比如媒体同行的报道、官方的通报、公共社会信息平台的查询:裁判文书网、失信黑名单、职业资格、工商信息……

赵子忠:平台作为信息的传播者负有主体责任,所以要对新闻的求真做出巨大的贡献和成绩。因为平台具备传播力,既然享受了传播带来的好处,那从正常模式来讲,收益跟付出要对等,所以就要尽量维护真实客观这个大方向。对于内容的制作者来讲也一样,有多大收益就要负多大责任,关系越接近对等,真实就越多。虚假信息的核心就是在于收益和责任不对等,他造一个谣言,能获得很大的收益包括流量、影响力,但他付出的代价是什么,这值得我们思考,比如如何提升公众对于公共信息安全的意识,健全道德、法律以及经济处罚等惩治手段。比如可以借鉴对交通违法行为的处罚,直接以罚款的形式去遏制,效果会非常明显!

总的来说,我们现在看到无论是在生产端还是在监管层面,以及各大网络平台,在遏制谣言传播上都作了很大的努力。比如现下的网络发言实名制,还有中央网信办持续开展的网络辟谣标签工作以及“清朗·从严整治‘自媒体’乱象”专项行动等,都是监管层面去做的一些努力。【2】另外,各大平台现在都有专门的辟谣产品,比如腾讯新闻较真,澎湃明察,微博投诉等,也均是遏制谣言传播方面所作的尝试。除了日常的一些辟谣方式,我们也看到有一些新鲜的尝试,例如选择大家日常看到的比较有代表性的谣言,以更年轻有趣的方式进行演绎,达到寓教于乐的效果。

五、ChatGPT等技术出现,是否会造成更多虚假信息的传播?如何应对这些挑战?

从内容生产的角度看,ChatGPT的出现的确大大提升了信息生产的效率,但这也表明了新技术或许会使造谣成本与门槛大幅降低。正如新闻可信度评估机构News Guard称,对于那些不熟悉样本信息所涉内容或主题的人来说,ChatGPT制作的这些内容很容易被看作是合法、权威的信息,这揭示了人工智能程序的“武器化”风险。而OpenAI首席技术官米拉·穆拉蒂近日在接受美国《时代》杂志采访时承认,ChatGPT可能会“编造事实”,并表示这是当下基础的大型语言模型共同面临的挑战。对于新技术出现是否会导致更多谣言的出现,学界和媒体的看法如下:

周葆华:ChatGPT的出现,也不能说一定会让谣言或者假新闻的数量急剧提升,这个还有赖经验观察。ChatGPT是一个生成式的语言模型,不是一个能够提供准确知识的搜索模型,所以在生成当中会造成一些事实和数据的不准确。也就是说这个生成模型,它只是提供了某一方面的信息或者知识的一个参考。要避免ChatGPT造成谣言或者假新闻的泛滥,需要针对ChatGPT提供的知识或信息进行审慎的校验,而非简单、直接的采信。

另外,还需要公共信息的主要供给者,也就是专业媒体,做好守门人的角色,在利用ChatGPT作为辅助工具进行新闻报道的时候,不能完全调用,要做好事实的核查,做好信息的校验,有效地防止由于ChatGPT的生成模型所造成的信息不准确的问题。当然,从公众的角度来讲,公民应增强自身在数字智能时代的媒介素养。对ChatGPT生成的信息,拥有更强的识读能力,不要在没有进行核实的情况下对一些虚假信息进行传播。

李怡清:一些新技术的出现,比如“P图”类的产品或者技术,并不是为了制造假新闻而生产出来的,但是它被应用在虚假信息的制造和传播过程中,这个没办法避免。但是之后一定会有一些反向的、反查的技术来帮助鉴别虚假信息。就像“P图”现在也有一些应用软件可以去辅助判定这张图是不是“PS”的。所以未来如果有一天ChatGPT被相对规模性地应用在了造假上面,那你要相信,一定会有新的技术去做一个反向的核查(现在也已经出现了一些辅助性的小工具)。当然,眼下的信息核查类的产品,更多只能起到辅助做用,而且大部分还主要依赖人工去操作。

赵子忠:媒介的变化让信息增量更多,信息的角度也更为多元化,片面度也进一步增强,所以片面性信息会大量出现,把这些片面信息定性成是虚假信息也没有问题。但是怎么能够把片面信息、碎片化的信息拼成一个更综合、更全面的一个图,一个全景图、真相图,这个是目前平台和内容创作者都面临的一个课题。目前大家还不能接受碎片化搭起来的一个全景图有可能是个假图的问题。所以,未来最可拍的事情是,你所有的碎片都是真的,但是结果是假的。这是未来信息核查最大的挑战。

需要强调的是,早在今年一月初,OpenAI网站已经发布消息,他们已经训练了一个新的分类器,用来区分人类书写的文本和人工智能创作的内容,并公开供人们使用。【3】这或许是预防机器模型输出谣言的一种方式。

周葆华:要想预防聊天机器人造成虚假信息泛滥的情况,仅靠对文本内容进行识别还不够。“公众在传播信息。人们对信息环境的变化有无察觉?对信息真实性的问题本身是否有认知?能不能区分不同质量的媒介?不能脱离认知层面和知识层面简单地谈应对。这些都是需要注意的。

而在今年的两会上,全国政协委员彭静提出:当前治谣机制立法尚存在问题:一是存在立法空白,如《刑法》对“严重后果”及“重大损失”等没有明确界定,缺乏针对“网络虚假信息和谣言”的明确规定。此外,以司法手段追责所面临的周期长、诉讼成本高等问题也让受害人望而生畏。这就导致相关的治谣手段难以起到威慑做用,实现精准打击;二是内容分散,欠缺统一的互联网基本法或专门针对网络谣言的法律。

所以彭静彭静建议应进一步完善法律规定、压实平台责任。主要从三个方面入手,第一,完善网络谣言的法律制度,第二,加强网信办与网站平台间的协同联动。第三,健全网络谣言的激励与惩罚机制。只有加强网络谣言治理制度建设,才能维护互联网生态文明秩序。【4】

六、什么是优质的,有价值的内容?

想要杜绝谣言或者假新闻的产生,首先要了解什么是优质的,有价值的内容,对此学界和业界的专家们这么看:

李怡清:优质的内容应该是基于真实、可靠的信息,通过深度研究得出的专业知识、见解和观点,不是那种浅薄的快餐式内容。要具有长远价值,能够持续地为读者带来收益和启示的内容。总之,好的内容具有深度、广度和专业性,能够满足读者的需求,让他们从中得到真正的收获。

赵子忠:好的内容就是要解决社会发展中的一些普遍问题的内容。但这里边有一个悖论,好的内容未必是用户愿意看的内容,用户喜欢的内容和内容有价值不一定有关系。内容价值可大致分为:娱乐价值,情绪价值,文化价值,信息价值等。一般而言,大部分用户最爱看的内容是娱乐内容,它体现的是娱乐价值以及情绪价值,但还有一种是价值观价值,比如说勤奋努力等正面的价值观,内容也可以输出,但价值门槛太高,成本很大,而且操作难度也大,所以人们更愿意选择成本更低的娱乐价值和情绪价值类的内容。

但问题在于,情绪价值治标不治本,价值观不对,情绪问题还是解决不了,就像罗翔说的,“片刻的欢愉带来永久的寂寞”。如果人们不再去找价值观价值的时候,这个社会就萎靡了,所以现在很多年轻人的萎靡状态,跟当下新媒体提供了大量的情绪价值有直接关系。所以一言以蔽之,做有价值的内容,就是要做有价值观价值的内容。而求真也是树立内容价值观环节中非常重要的一环。

参考文献

【1】中央网信办举报中心持续开展网络辟谣标签工作. 人民网. 2023-01-28. http://www.news.cn/2023-01/28/c_1211722807.htm.

【2】中央网信办部署“清朗·从严整治‘自媒体’乱象”专项行动. 中国网信网. 2023-03-12. http://www.cac.gov.cn/2023-03/12/c_1680256771354020.htm.

【3】OpenAI releases tool to detect AI-generated text, including from ChatGPT. TechCrunch.2023-01-31. https://techcrunch.com/2023/01/31/openai-releases-tool-to-detect-ai-generated-text-including-from-chatgpt/

【4】全国政协委员彭静建议:防范和惩治网络谣言应出台专门条例. 中国青年网. 2023-03-07. https://news.youth.cn/gn/202303/t20230307_14367785.htm.

本文来自微信公众号:腾讯媒体研究院 (ID:TencentMRI),作者:井婷婷、张浩