Gemini(英文名双子座)推出,国内媒体标题上各种“王炸”“杀器”“碾压”之外,其实它展示的各种功能,已经很难再激起人们一度熟悉的神奇感和令人惊喜的效果了。

和所有的人一样,我首先关心的是,它超过GPT-4了吗?

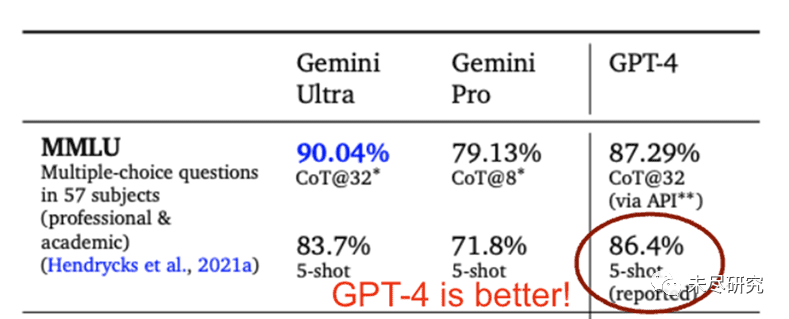

昨天看到Gemini发布的消息,第一件事,是把Gemini测试的表格,直接上传到Bard,它果然能对图表进行比较详细准确的解读。如与GPT-4相比,认为明年初推出的Gemini Ultra胜出,已经面世的Gemini Pro逊色,各自在多项指标上的表现如下:

“根据这张图的数据,GPT-4在大多数基准测试中都优于Gemini Pro。例如,在MMLU、GSM8K、MATH、BIG-Bench-Hard、HumanEval、Natural2Code、DROP、HellaSwag和WMT23等基准测试中,GPT-4的准确率都高于Gemini。”

“根据谷歌提供的数据,Gemini Ultra在32个广泛使用的学术基准测试中有30个都表现出了超越当前时代的‘先进结果’,而这些基准测试也是当前LLM领域最常用、最泛用的测试。其中,它以90.0%的得分成为第一个在MMLU(大规模多任务语言理解)上超越人类专家的模型(该测试结合了数学、物理、历史、法律、医学和伦理等57个学科)。Gemini Ultra还在新的MMMU基准测试上表现出了59.4%的领先级性能,该测试涵盖了“需要深思熟虑的”不同领域的多模态任务。

相比之下,GPT-4在MMLU基准测试中的得分为87.29%,在MMMU基准测试中的得分为52.9%。因此,Gemini Ultra在大多数基准测试中都优于GPT-4。”

不过,与许多熟悉大模型测评江湖的专家一样,我也要问一句,这些测评的参考价值有多大?

例如,最受关注的是所谓的Gemini对语言的理解力首次达到(而不是超过)了人类专家的水平,而且在这一项上的学霸级的90分,是尚未发布的Gemini Ultra“碾压”GPT-4的最重要依据。

但是,这个说法很快就引发了一些争议,认为在MMLU这项指标上有点人为拔高。只有CoT(思维链)达到32个例子时,Gemini才能达到90分,超过GPT-4;当例子数量减少到5个,Gemini Ultra得分83.7%,不如GPT-4得分86.4%,高于GPT-3.5的70%。

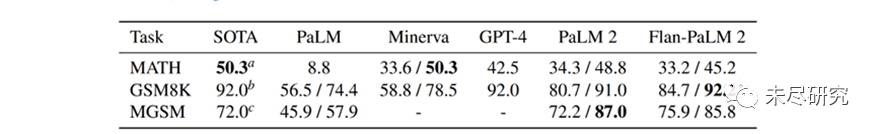

谷歌在5月份发布Palm-2的时候,也挑出了两个优于GPT-4的指标,但是后来这个大模型怎么样,大家都清楚了。

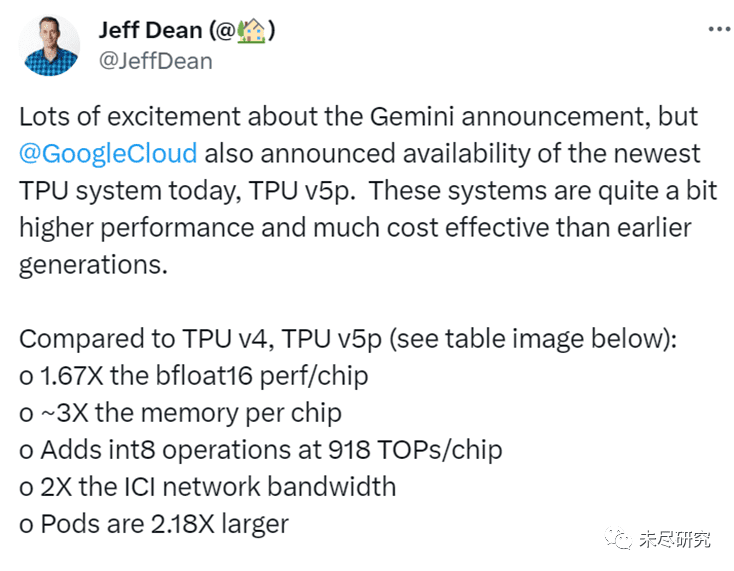

Gemini发布的喧嚣中,值得注意的是谷歌云发布了TPUv5p,训练大模型每刀效率提升2倍以上。不管Gemini是否碾压了GPT-4,但有一点是肯定的,谷歌拥有比微软更强大的大模型训练和推理平台。谷歌研究负责人Jeff Dean特意从技术报告中拎出了这些亮点:

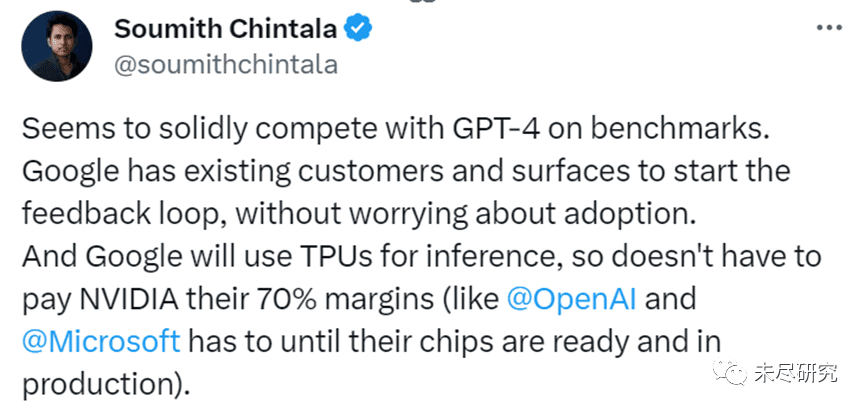

大家比较公认的是,Gemini赶上了GPT-4,其多模态能力甚至超过了GPT-4V。Meta的PyTorch联合创始人Soumich Chintala认为:

“似乎在基准测试上不让GPT-4。谷歌拥有现有的客户和平台可以开始建立反馈闭环,无需担心模型采纳问题。而且谷歌将使用TPU进行推理,因此不必像OpenAI和微软那样支付给NVIDIA 70%的利润(直到他们的芯片准备好并投入生产)。这是令人兴奋的转变。”

Gemini以后将成为谷歌所有产品与服务的基础模型。从技术报告中可以看出,开发这个大模型,由Google DeepMind牵头,几乎所有的主要研发部门、基础设施部门与数据内容部门都参与了,后面列出了约800名贡献者名单,与目前OpenAI公司的人数相当。

今年3月份GPT-4发布之后,谷歌很快把DeepMInd和Google Brain合并,由哈萨比斯担任CEO,主要使命,就是牵头研发多模态大模型Gemini。

谷歌拥有最大的AI人才库,包括Transformer论文在内的最重要研究成果,几乎都出自谷歌。谷歌还拥有最强的AI基础设施、最大的数据库、最强的搜索以及最丰富的应用场景。哈萨比斯的愿景也是实现通用人工智能。谷歌没有任何理由一直跟在OpenAI的后面追赶。

许多人认为谷歌动作迟缓,是因为大公司病。这肯定是一个原因,也导致谷歌今年以来的人才流失。

另外还有一个重要原因,作为一家已经拥有AI全栈技术与顶级应用的科技巨头,谷歌的行为肯定与初创公司OpenAI有所不同。

谷歌最重视的仍然是搜索。它并不想用语言大模型来颠覆搜索,而是用它来加强搜索,谷歌称之为生成式搜索。它也需要考虑生成式搜索的成本。大模型每次query的成本已经大幅度下降,但仍然比搜索的每次query昂贵。谷歌必须要考虑的,是每年为全世界数十亿用户提供的数万亿次免费搜索的成本。

所以对于谷歌来说,它的AI计算基础设施非常重要。它希望能在训练、推理、能耗等方面的成本降下来,既能支持生成式搜索,同时又加持其他的业务,包括硬件业务。

谷歌这次推出用于Pixel手机的两款Nano模型,会进一步推动生成式人工智能向设备端部署。同一天,苹果悄悄公布了基于M芯片的大模型训练和部署框架MLX,Mac笔记本电脑将会更加AI化。

谷歌推出Gemini已经晚了吗?似乎并不晚。正如哈萨比斯所说,发布了Gemini之后,就回到了他当初在DeepMind所熟悉的节奏,会迅速地迭代出更好的产品,从1.0版本到2.0版本。

Gemini推出,给Claude、Inflection,也包括开源的Llama2等大模型带来新的压力,这种压力会传递到国内。目前国内最好的大模型,综合水平基本上处于GPT-3.5这一档。进入2024年,大模型的竞争,可能会形成真正的双子座:GPT-5与Gemini-1。

本文来自微信公众号:未尽研究 (ID:Weijin_Research),作者:周健工