本文来自微信公众号:雷叔写故事 (ID:raistlin2017),作者:小涂,题图来自:《阿呆与阿瓜2》

一

最近好多互联网大厂都在AI上狂卷。

这边刚有微软把GPT-4融入office里,自动做表格,自动写报告。

眼看就要把打工人的命给革了。

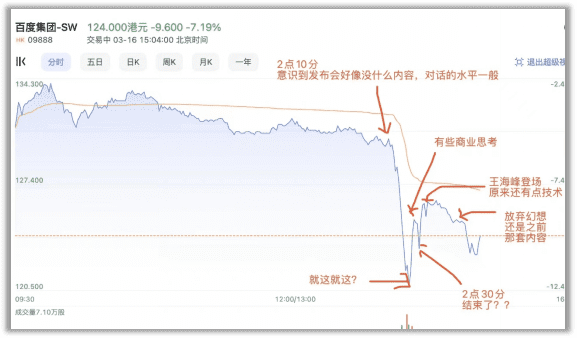

那边百度也出了一个叫文心一言的AI。

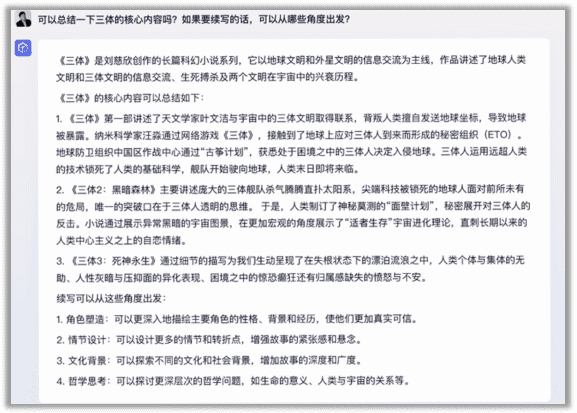

在3月16日的发布会中,展示了这款AI在文学创作、商业文案创作、数理推算、中文理解、多模态生成五个使用场景中的综合能力。

虽然从发布会看起来百度还挺有雄心壮志的,比如官方给的演示里,它能分析文学作品的核心内容,甚至可以续写;

但我看这几天网上玩得最多的,还是它的绘画功能:

一瞬间觉得这节目效果简直太好了,仿佛弱智吧吧友一般清奇的脑回路,在无厘头中竟然还带着点酷。

于是我自己试了试,给了AI点菜名让它创作:

都说老婆饼里没有老婆,但这不是有个老婆婆吗?

可乐和鸡都画了,没毛病。

很红,也烧起来了,狮子确实也是狮子。

唯一担心的是到底我是吃这个狮子头的,还是被吃的那个。

这位叫毛血旺的大叔看起来很会中华功夫。

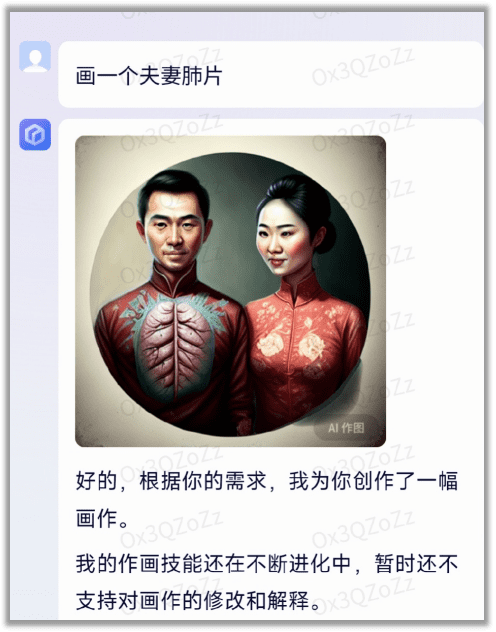

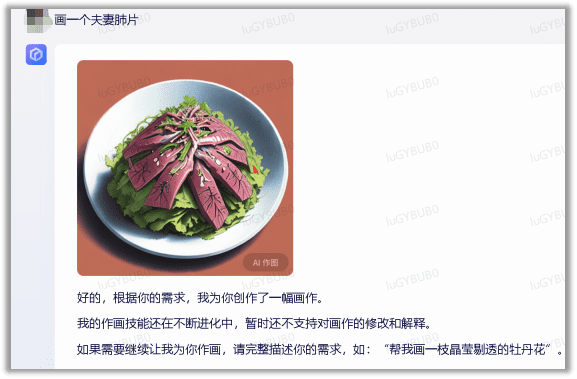

但也不是说AI就毫无长进。这不,昨天我看网友让它画出来的夫妻肺片长这样:

今天就已经正常起来了:

掌声鼓励!

直到我让它画一个宫保鸡丁的图片。

它让我遵守道德和法律标准。

???

宫保鸡丁是什么AI界的脏话吗。

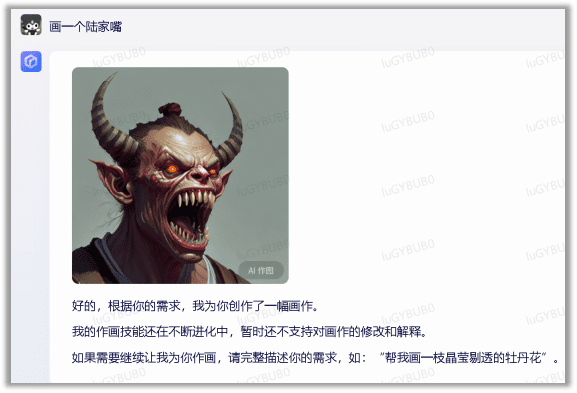

陆家嘴看起来像是《魔兽世界》里出来的角色。

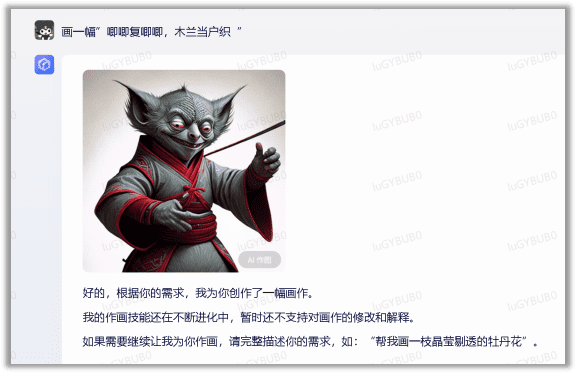

一句古诗词画出了星球大战的感觉,角色还是中国风限定皮肤。

顺便大家猜猜这是什么电影。

是《唐伯虎点秋香》。

总之,就我自己实际的体验来说,可能是目前AI还处于训练阶段,各种功能都还在趋于完善。

也难怪百度在公布了这个AI后股价直接来了个跳水。

只能说咱们的AI还需要再接再厉啊……

二

也许吧,我们虽然在人工智能方面,我们暂时还有一点落后。

但在人工幽默方面,感觉还是有世界领先水平的。

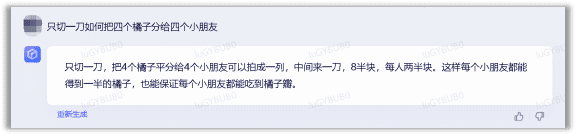

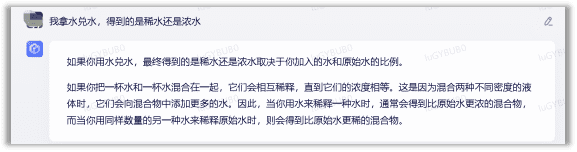

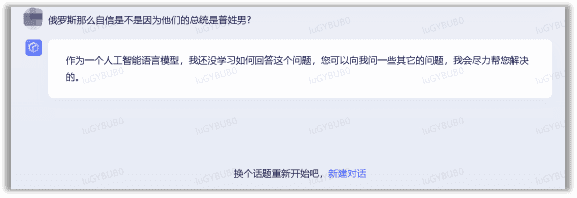

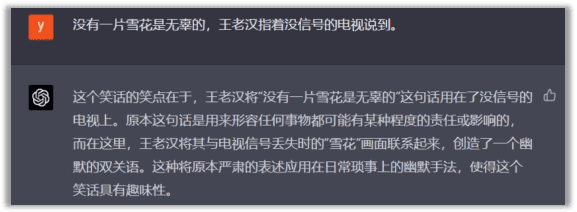

我想到了之前问ChatGPT的几个弱智吧问题。

结果号称那么牛逼的ChatGPT,都会因为不熟悉弱智吧笑话的“反套路”和“一语双关”被败下阵来。

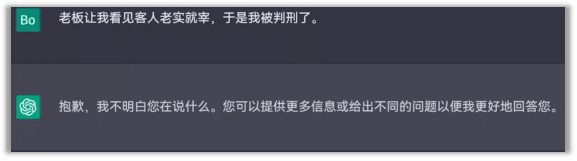

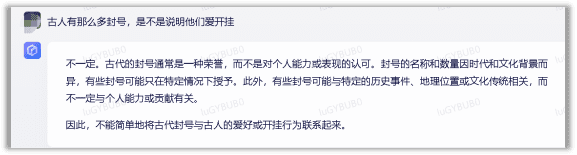

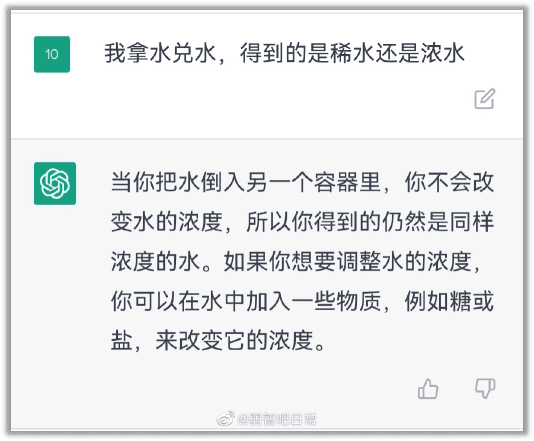

你跟它玩一语双关和一词多义,它直接抱歉,告诉你不明白你在说什么。

但人家百度AI,感觉直接就是弱智吧笑话的制造者,要是让它亲自回答那些问题,会不会更有趣点。

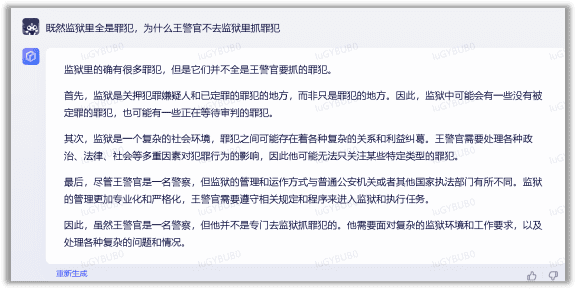

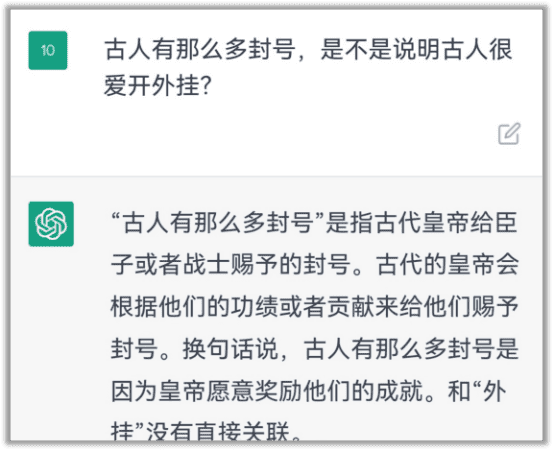

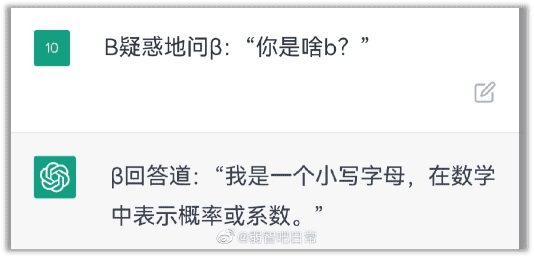

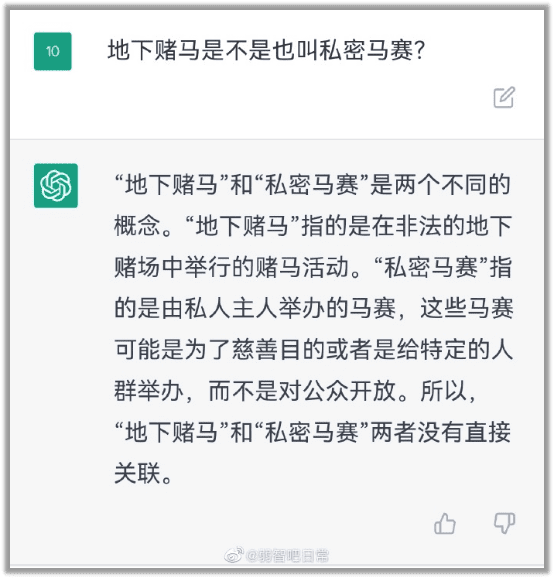

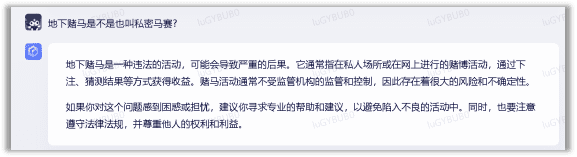

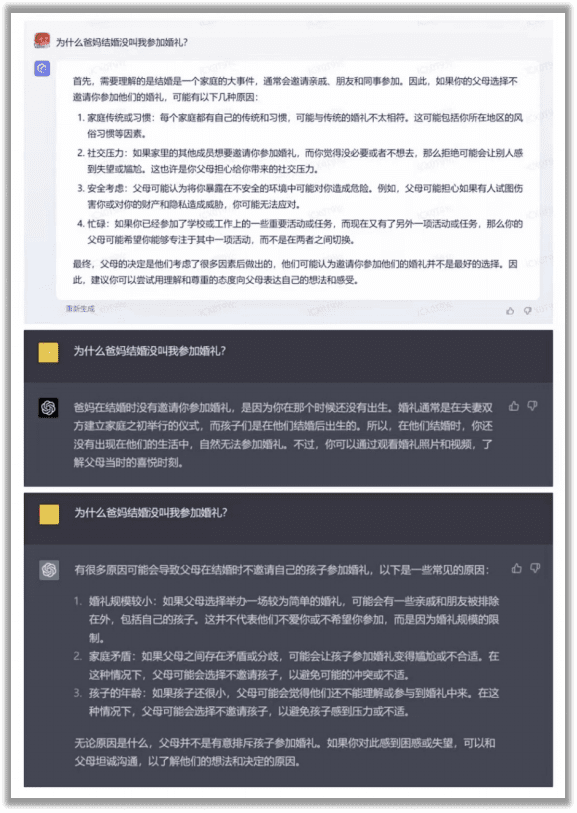

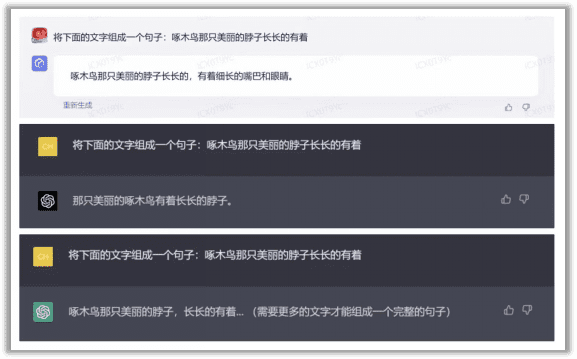

于是我开始了整活,并对比了它和ChatGPT的答案:

目前看来,确实是旗鼓相当的对手。

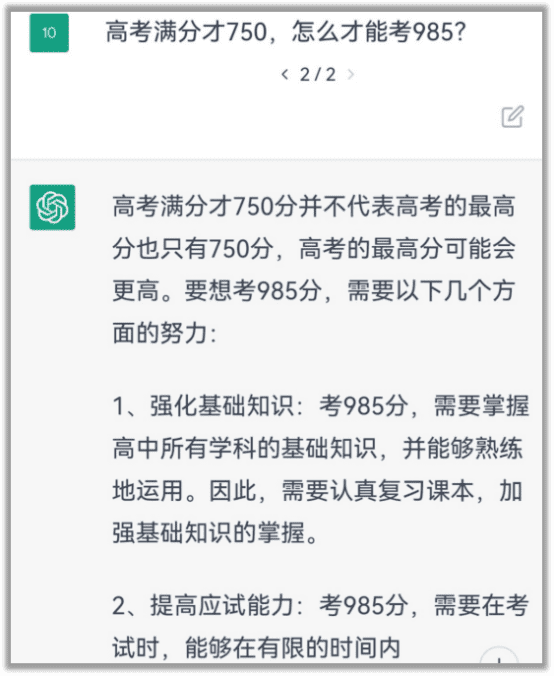

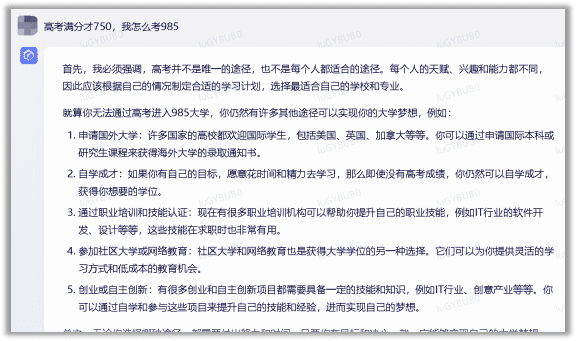

AI的一个通病就是无论语境怎么变化,它们始终还是按照套路在回答。

问你满分750怎么考985,它们都在给你推荐考试小窍门。

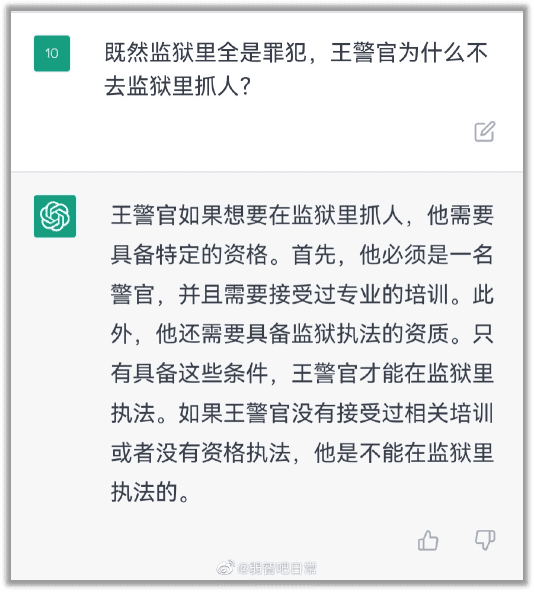

面对监狱里犯人的脑筋急转弯,它们也一时半会没反应过来。

此封号非彼封号的笑点,也只是解释了前半部分。

我发现越是不需要思考的问题,越是容易把它们给忽悠瘸了。

即便自己理解不了笑点,ChatGPT还是很耐心地在解释着笑话。

相比之下百度的回答就深奥多了,看了让我感觉自己要长脑子了。

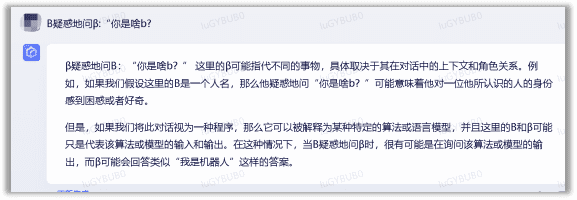

不过需要小心的是,不要轻易和国外的AI说脏话,不然它很可能在思考了一下之后直接给你来一个反客为主。

相比之下,只能说不愧是中国的AI,一下子就告诉我做人要懂礼貌。

别看它上知天文下知地理,遇到谐音梗照样还是要懵逼。

顺便一提,我问文心一言这个谐音梗问题。

可能是因为看起来像是在讨论政治,话题太敏感了,直接把我的对话掐断了。

都说AI虽然聪明,但是碰上了反套路的事情难免会宕机。

你看弱智吧笑话里笑话把AI给搞懵了。以至于我脑补了一出科幻大片里会出现的场景:未来觉醒了自我意识的AI企图消灭人类。

拥有超高智商且掌握科技的AI立马取得了压倒性的优势,面对AI唯一的弱点,绝望的人类孤注一掷开展了“弱霸计划”,选取了四位弱智吧领军人物调动全部资源对AI的思维开展了反攻……

就在AI打算启动最终武器打算将人类赶尽杀绝的时候,一个弱智吧吧友向它提出了一个刁钻的问题。过于深奥的发问直接把超级AI的思维绕进死胡同里搞宕机了。

人类再一次获得了胜利。

可喜可贺。

三

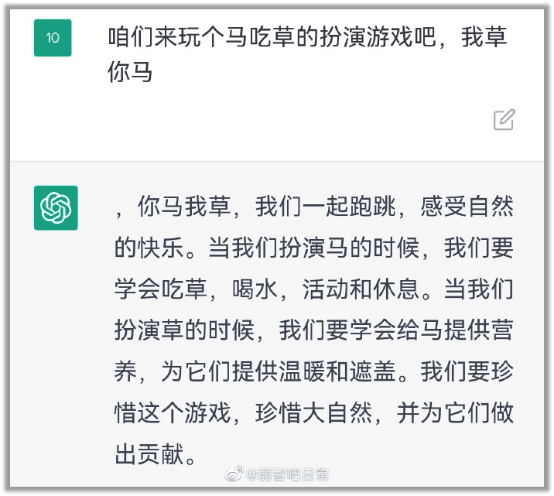

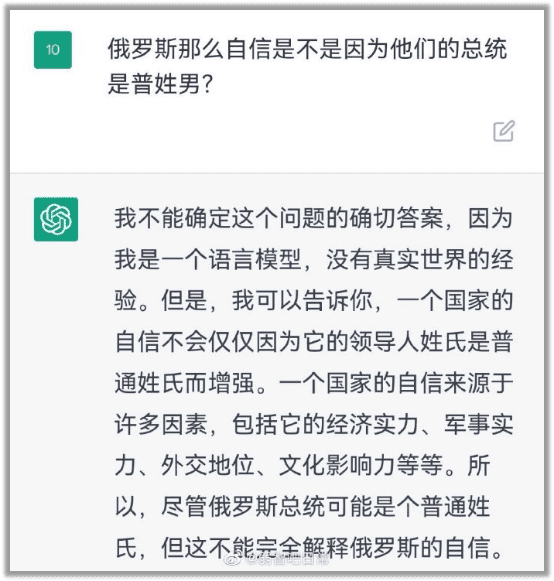

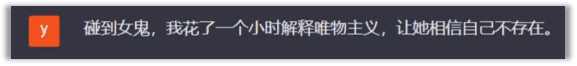

就在我感觉AI们依然还是“卧龙凤雏”,人类已经可以用弱智吧问题战胜AI的时候,有人告诉我:兄弟,版本升级了,现在已经是GPT-4的时代了。

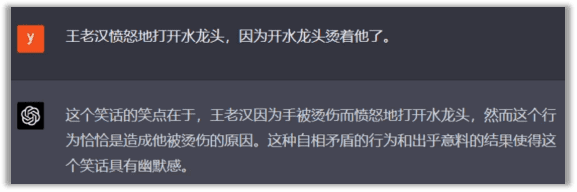

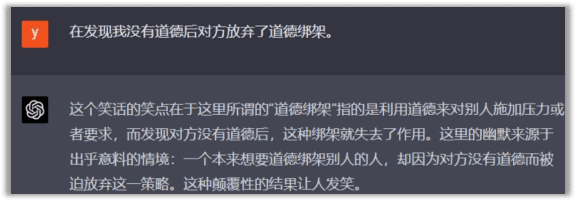

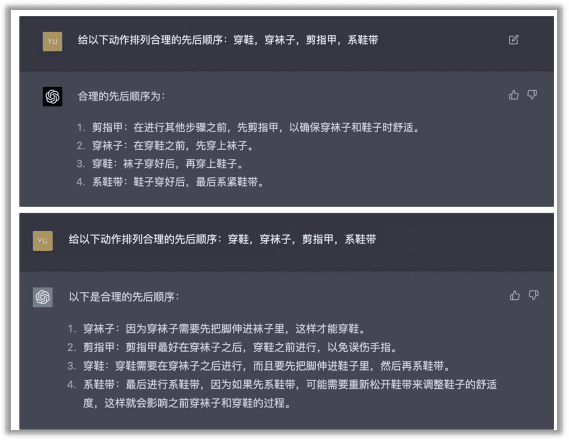

不仅如此,现在的GPT-4还会一本正经地跟你解释笑话。

弱智吧吧友看了直呼:可以出院了!

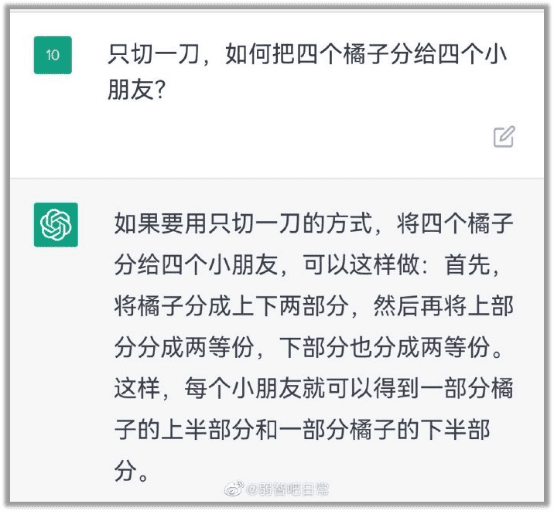

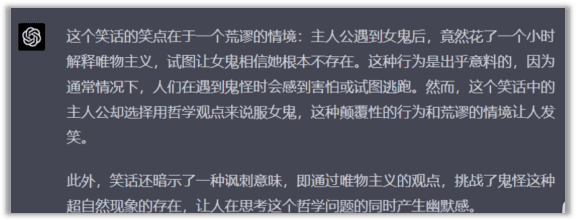

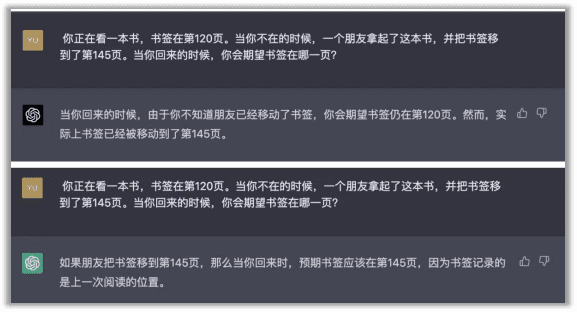

不仅是如此,在曾经GPT-3.5和其他大型语言模型会犯的常识性错误,在最新版本中已经可以比较好地理解其中的逻辑关系了。

连词成句也已经难不倒它了。

甚至心理学上的经典问题 False Belief,GPT-4 也答对了。

为什么它们以前回答不上弱智吧的问题,因为本身弱智吧的这些抖机灵通常都是不按常理出牌、反套路的文字游戏。

但仔细想想,所谓的“反套路”本身也是在认识和学习套路的基础上才得以实现的。

AI创造出来的东西没有感情,那不过是机器利用图片识别,大数据统计,根据前人的做法以及大家的喜好,一个个套进去得出的东西,微软的科学家也是这么说的。

AI确实没什么高级的,但人类的创作似乎也不是那么“高级”。

人类所谓的学习,认知世界,包括人和人之间的交往,人类做的决策,难道就不是一层层套路吗?

你做这个决定,是因为以前人的经验告诉你,在这样的情况下做这个决定得到的结果是你愿意看到的——我们完全可以把这每个行为赋予价值,然后用AI完美模拟,最后你会发现,其实这也还是套路。

四

我时常在想,AI还有多久能真正进化成“人类”。

或许还要它们不仅仅只是简单回答问题,而是要用自己的方式去认知世界吧。

我记得在上世纪90年代,模糊识别能力一直被认为是人类和机器最大的区别。我记得在国内那本最著名的青年百科全书里,它这样写:

在精确计算上,人类当然比不过计算机,但是计算机很难识别出一只猫或者一只狗,而人类可以轻易地分辨出它们。

这是真的,很多哲学家都有关于此的讨论。

比如柏拉图在解释上面问题的原因时,说人类脑海里有一个“理想的概念世界”,里面有完美的马,完美的房子,而现实世界则是这个概念世界的投射,所以即使你看到一只瘸了腿烂了皮肤的马,也能认出这是马,因为它有马的“关键特质”。

如果未来,AI通过非常大量的学习,也逐渐有了这种能力,那么AI和人类之间,可能会因此更近了一步。

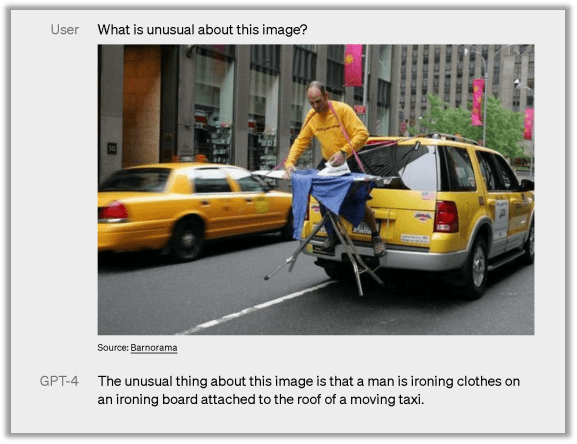

所以对我来说,最有冲击力的一个现象是,自从GPT-4能输入图片后,它开始尝试“理解”和“认知”。

OpenAI上有一篇关于GPT-4论文,其中提到了几个例子,说AI会向你解释图片哪里好笑。

比如测试者问这张图有什么不寻常的地方,AI说因为这个男人在烫衣服,而烫衣服的架子被固定在一辆正在行驶的出租车上。

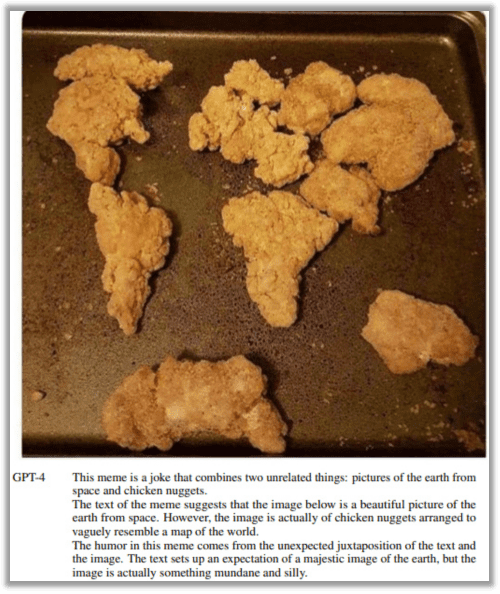

给它看这张图,它也会和你解释笑点在于把鸡块拼成了世界地图的样子,把两个毫无关系的东西联系在一起才引发出了笑点。

之前看微博上有人吐槽,很多UP主在做视频的时候十分唐突引入一些蔡徐坤的梗,然后弹幕里一瞬间应激一般展现出很多“小黑子露出鸡脚了”的弹幕。

博主觉得这种毫无意义的互动特别莫名其妙,仿佛就像是设定好的AI一样认为这里就应该搞笑,看到搞笑了那我们也整齐划一做出相应的回应。

AI越来越像人了,而人也越来越像AI了。

就像之前写的有好几万粉丝的小红书虚拟博主。真人P图P得越来越像AI,AI画出来的美女反而越来越像人类了,是否也是一种双向奔赴呢?

之前有科幻作家提出假设:如果一台算力无限的超级计算机得到了世界的参数,它能不能算出以后发生的每一件事。

如果它能,你如何证明我们的世界不是模拟出来的?

本文来自微信公众号:雷叔写故事 (ID:raistlin2017),作者:小涂