本文来自微信公众号:晚点LatePost (ID:postlate),作者:贺乾明,编辑:龚方毅,题图来源:视觉中国,原文标题:《Llama 2 发布:一夜之间,大模型竞争来到新起点》

当一家公司的新技术遥遥领先,眼看要独占一个行业,追赶者们应该怎么办?

2008 年,iPhone 发布后一年,各大手机厂商奋力研发操作系统追赶苹果。微软有 Windows Mobile、黑莓有 BBOS、诺基亚基于 Linux 系统开发了 Maemo、Palm 在秘密研发 WebOS……

又过了不到五年,还卖得动的智能手机要么来自苹果,要么装着开源的 Android 系统。现在,苹果的竞争对手们不再有属于自己的操作系统,但它们占据着超过 80% 的智能手机市场。

一整个行业围绕开源技术,协力对抗领先者,这一幕在今天的技术竞争中不断发生。

Windows 系统难以挑战,不满微软的科技行业将 Linux 变成了网站和互联网应用的操作系统。亚马逊 AWS 开创了云计算行业,阿里云、IBM 等竞争公司将 Google 的 Kubernetes(K8S)开源技术奉为标准。几乎所有移动处理器都依赖 ARM 架构,于是 RISC-V 正得到广泛的投资支持。

昨夜 Meta 又贡献了一个这样的例子。他们宣布将大语言模型 Llama 2 有条件地开源给商业使用(月活用户超过 7 亿需要单独申请),正是在牵头做大模型时代的开源标准。而 OpenAI 的密切合作伙伴微软,这一次成了 Llama 2 的首要合作伙伴。

微软是在同一天举行的 Inspire 大会宣布这项合作的,而且就在宣布的 2 分钟前,微软还在一张 PPT 上画着 “微软 ♥ OpenAI”。微软与有竞争关系的闭源 OpenAI 和开源 Llama 2 两头牵手,反映了如今大模型激烈的技术竞赛之外,多变的商业合纵连横。

微软 CEO 萨蒂亚·纳德拉(Satya Nadella)发布会上强调微软与 OpenAI 关系亲密(上)。Meta CEO 马克·扎克伯格(Mark Zuckerberg)与纳德拉的合影(下),图片来自扎克伯格的社交媒体。

ChatGPT 去年底亮相后,全球大小科技公司和各类研究机构都在奋力追赶,造出了上百个大模型。而在 Meta 开源 Llama 2 之后,这些模型中的大多数还没有商用就已经过时。

“Llama 2 看起来非常强大(超越 GPT-3),经过微调的聊天模型看起来与 ChatGPT 处于同一水平。”HuggingFace 机器学习科学家内森·兰伯特(Nathan Lambert)说,“对开源来说是一个巨大的飞跃,但对闭源的大模型公司是一个巨大打击,这个模型(Llama 2)将满足大多数公司对更低成本和个性化的需求”。

水平在GPT-3到GPT-3.5之间

今年 2 月,ChatGPT 发布 3 个月,Meta 就开源了第一版 Llama 大语言模型。当时开发者能拿到的只是 Llama 预训练模型、且只被允许用作研究,而不是一个像 ChatGPT 那样针对特定任务或者需求训练过的应用。

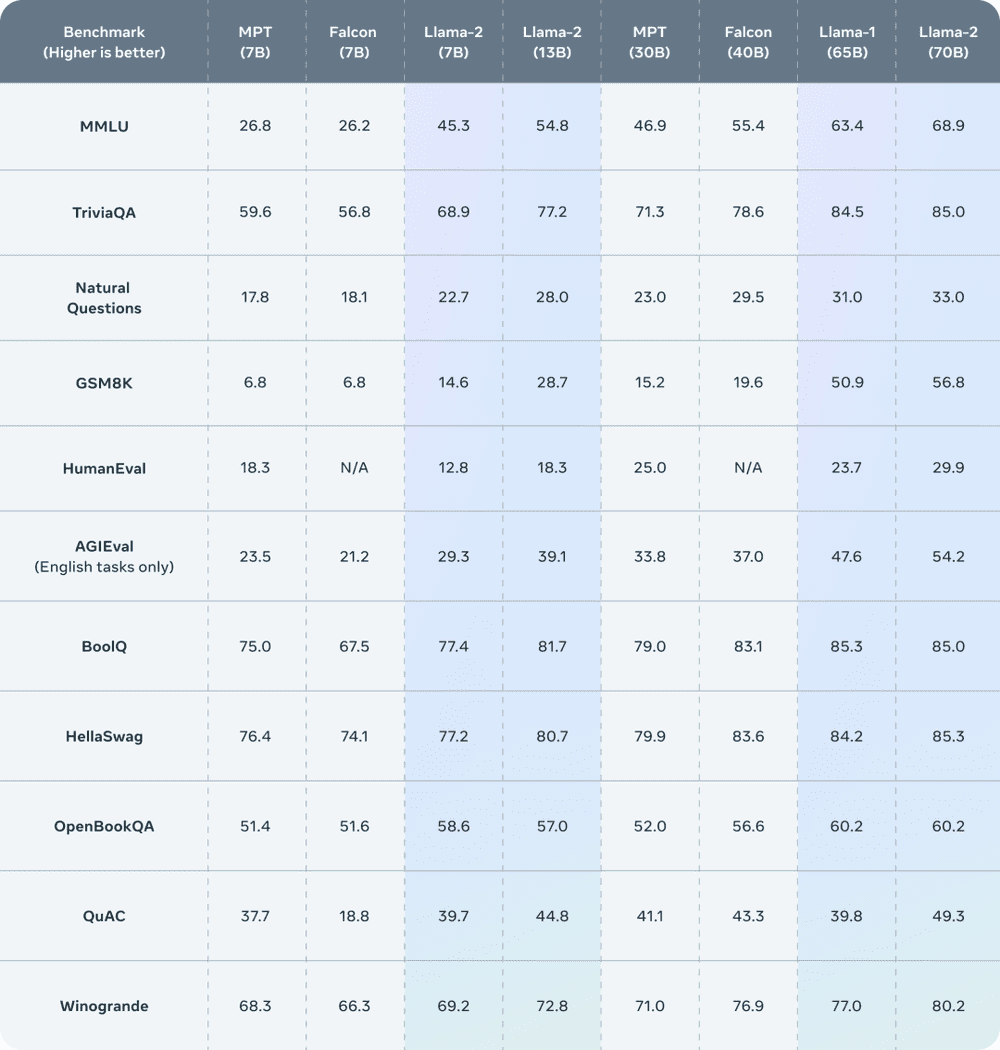

支持商用的 Llama 2 看上去更强。本次 Meta 一共发布 70 亿、130 亿和 700 亿三种参数规模的模型,其公布了模型训练数据、训练方法、数据标注等大量细节,展示了 Llama 2 的水平:

同等参数规模, Llama 2 能力超过所有的开源大模型;

700 亿参数的模型在推理层面接近 ChatGPT 背后的 GPT-3.5,但写代码的能力还有较大差距。

多位测试过 Llama 2 模型的开发者基本证实了 Meta 的说法:“代码测试环节挺不了 15 分钟”。70 亿参数的模型可以在 Mac 上运行,每秒钟能处理 6 个字符,比 Google 发布的 PaLM 2 最小的模型 “壁虎” 慢 70%。但 Google 并没有公布 “壁虎” 的具体参数。

根据 Meta 公布的信息,Llama 2 的训练数据(都来自公开数据)提升到 2 万亿个 Token(指一个常用单词、标点或数字),较第一代多 40%。其上下文长度扩展到了 4000 个字符,对文本语义的理解更强。

Meta 还像 OpenAI 那样,借助人类反馈强化学习(RLHF)机制,用 100 万人类标记数据训练出了类似 ChatGPT 的对话应用。这也是开源社区过去几个月微调训练 Llama 的常用方法。Meta 称 “大语言模型的卓越写作能力,从根本上是由 RLHF 驱动的。”

训练 Llama 2 可能并不便宜。HuggingFace 机器学习科学家内森·兰伯特估算 Llama 2 的训练成本可能超过 2500 万美元,不比 OpenAI 三年前训练 GPT-3 的花费少。他说,有充足的迹象表明,Meta 还在继续训练更强的 Llama。

Meta 的 Llama 2 在多个数据集上表现好过其他开源模型。图片来自 Meta。

“改变大语言模型的市场格局”

作为基础设施,大模型在产品中处于底层。用户使用大模型应用,感受到的就是对话框和大模型处理过的内容,不会看到用的什么大模型、什么技术。

大模型的这个特点,一定程度上决定了它的竞争局面——只要有更符合用户或企业需求的大模型出现,换起来的障碍并不高,甚至不会对用户造成太多负面影响。“如果大模型能力相差不大,只需要做一些调度工作就可以解决,开发量不大。” 一位 AI 开发者说。

有了 Llama 2 这样的开源大模型,自研的意义更小了。连竞争对手 OpenAI 的研究科学家、特斯拉前人工智能总监安德烈·卡帕西(Andrej Karpathy)都说,Llama 2 的发布是人工智能和大模型发展过程中的重要一天,“Llama 2 是任何人都可以拿到模型权重(参数特征,一个模型最关键的信息)的最强大语言模型。”

Meta 副总裁、人工智能部门负责人杨立昆(Yann LeCun)说,Llama 2 将改变大语言模型市场的格局。一位中国大模型创业公司高管解释了这句话:“很快就能看到许多开发大模型应用的公司,把基础模型换成 Llama 2”。

多位人工智能研究者认同杨立昆的说法,随着 Llama 2 发布,Meta 可以用开源、支持商用的策略会改变大模型的格局和生态。

今年 6 月,美国红杉资本发现在其投资的 33 家创业公司和上市公司中,65% 已经上线了大模型应用、94% 正用 OpenAI 的大模型接口(API)开发应用。

它们使用大模型的方法大多较为简单:直接调用 ChatGPT 的接口处理私有数据完成特定任务,如多语言互译、生成文本或者网页内容摘要等。很少有公司会做更深入的开发,比如用大量数据微调模型。

在中国,许多公司选择从头收集数据或者用公开数据集训练大模型,过去半年发布了 80 多个大模型,不乏有公司和机构开源模型,把支持商用当作竞争点,然后做起生意。

“晚点 LatePost”了解到,中国一家备受关注的大模型创业公司推出的开源 60 亿参数大模型,企业想买商用授权要花百万元;没有开源的千亿参数模型,售价每年上千万元。

一位上市公司人工智能部门负责人 5 月告诉“晚点 LatePost”,他们打算用 OpenAI 的 GPT-3.5 开发功能,但成本太高——每天成本预计上万元,而且想定制做开发很困难,也不支持同一时间响应大量用户的请求。

最后他们选择了参数量更小的 Llama(60 亿)和一个中国公司的开源大模型,这意味着训练和部署成本更低,而且经过数据微调后,在他们的业务场景中,基于 Llama 与中国开源模型的开发效果和使用 GPT-3.5 差别不大。

中国大模型公司当时的另一个优势是可以谈商业授权,而 Llama 不能。当 Llama 2 开始允许商用,中国大模型公司的这一优势现在也没有了。

开源大模型正迅速追赶

ChatGPT 去年底刚发布时,它凭看上去充满意义的回复和强大的写代码能力等功能震撼了世界。许多公司都在关注怎样才能做出一个类似的产品。

半年多过去,从大公司到普通程序员,都能借助开源社区做出来一个类似 ChatGPT 的应用。云端开发平台 Replit 发现,使用他们服务的开源大模型的项目数量,每个季度都在翻倍。

在 Llama 等开源大模型基础上,开发者们做出了各种开源数据集,比如基于人类反馈强化学习(RLHF)的数据集,持续提升开源大模型的能力。

根据加州大学伯克利分校、卡耐基梅隆大学等高校多位教授和学生成立的 LMSYS Org 评估,过去几个月,开源大模型与 GPT-4 的差距正明显缩小——从相差 191 分到近期的 115 分。在追赶过程中,开源社区还先大公司一步做出了在电脑、手机上运行的大模型,比 Google 早一个多月。

随着 Meta 开源 Llama 2,大模型开源社区的力量将会变得更强。Meta 称, 第一版不支持商用的模型开源后,他们收到了超过 10 万个研究人员的使用申请——这还没算那些直接从网上下载模型的人。

“大公司的人工智能研究人员因为开源许可问题对第一版 Llama 持谨慎态度,现在我认为他们中的许多人会跳上这艘船(Llama 2)并贡献他们的火力。” 英伟达资深人工智能科学家 Jim Fan 说,就算现在 Llama 2 编程能力不行,开源后很快就会追上来。

这次 Llama 2 最大开源参数版本(700 亿)的训练数据量还不到 OpenAI 三年前训练好的 GPT-3 的一半,但效果好于 GPT-3,就是最好的例证之一。

开源的逻辑偏向于大模型达到一定能力后,就扩大新技术的覆盖范围,让更多人使用技术,然后从大量应用中改进模型。而闭源的公司,如 OpenAI 更偏向于技术领先,研发强大模型后再推广给更多人。

就像 iOS 与 Andriod 在手机操作系统上的竞争,开源与闭源的竞争并不都是在同一维度上的短兵相接,大模型领域也会出现类似的分化。

在这种新的竞争格局下,连 Google 都没有信心继续保持领先。

今年 5 月,Google 一位高级工程师在内部撰文称,尽管 Google 在大模型的质量上仍然略有优势,但开源产品与 Google 大模型的差距正在以惊人的速度缩小,开源的模型迭代速度更快,使用者能根据不同的业务场景做定制开发,更利于保护隐私数据,成本也更低。

“只需要几周时间,他们用 100 美元和 130 亿参数的模型,就能做成我们花 1000 万美元和 540 亿参数模型很难做到的事情。”他说,“我们没有护城河,OpenAI 也没有”。

昨天,Meta 在宣布 Llama2 开源后解释说,开源对于当今人工智能模型的发展是正确的,尤其是在技术迅速发展的生产领域,“通过公开提供人工智能模型,它们可以惠及所有人ーー而不仅仅是少数几家大公司”。

一场不同于过去的新式竞争正在生成式人工智能领域开展。开源社区凭借开放协作的力量,正在以惊人的速度追赶商业巨头们建立的领先优势。而过去习惯于技术封闭和市场垄断的大公司,也在逐步拥抱开源。

本文来自微信公众号:晚点LatePost (ID:postlate),作者:贺乾明,编辑:龚方毅