本文来自微信公众号:硅星人 (ID:guixingren123),作者:光谱 杜晨,原文标题:《科技公司的尴尬战争:算法的“好意”,险些毁了一位父亲的人生》,题图来自:视觉中国

家住旧金山的马克怎么都没想到,本来急着给自己儿子看病,给医生发了一张照片,结果却让自己险些身败名裂。

事情发生在去年年初,由于当时仍处在疫情高峰期,一些非紧急医疗机构都关闭了服务,也包括马克家选择的儿童诊所。马克发现自己儿子的私处出现肿胀,急忙寻求专业人士的帮助,和医生打视频电话。

在视频之前,护士让马克发一张照片给医生看下。马克照做了。

然而让他没想到的是,这张照片可给他惹了大祸了。

爱子心切的父亲,算法眼中的“恋童癖”

在照片发出的两天后,马克突然接到了谷歌的一纸通知。

由于涉嫌储存和传播有害内容,严重违反用户协议和公司政策,并且涉嫌违法,他的谷歌账号被完全关闭。

由于马克是谷歌全家桶的忠实用户,谷歌这一决定的后果相当惨痛:他不仅失去了自己的 Gmail 邮件、通讯录、日历,还因为是 Google Fi 虚拟运营商的用户,连手机号都被一起冻结了。

到了这里,噩梦还远未结束。

谷歌不仅封了他的账号,还直接把这件事报到专门打击儿童色情/性虐待内容的监督机构那去了,该机构后来又联系了旧金山警察部门。终于在去年年底,旧金山警方从谷歌公司那里调取了关于马克的所有资料和记录,正式对马克展开了调查。

长达一年的时间里,马克面临“恋童癖”的严重指控,工作生活都难以开展,甚至几乎“身败名裂”……

《纽约时报》描述此事的文章提到,将马克置于尴尬境地的,正是谷歌少为人知的儿童性虐待内容打击系统。

根据美国政府的定义,儿童性虐待内容(Child Sexual Abuse Material,以下简称 CSAM),包括照片、视频等,只要其中涉及未成年人露骨色情行为的画面,都属于此类内容。更具体来说,涉及包括诱骗、勒索、展示/鼓动/宣扬性化(sexualization)未成年人、拐卖儿童性质的内容,都属于谷歌明令禁止的 CSAM 范畴。

为了防止平台、产品和技术被用于传播 CSAM,谷歌投入了大量资源,对 CSAM 进行扫描、阻止、移除和举报——然而这次让马克遭殃的并不是谷歌的扫描技术,而是谷歌的人工查验流程出了疏漏。

在各大公司,CSAM 检索和事后举报的流程,都包括了算法扫描和人工查验的双保险制度,谷歌也不免俗。然而在马克的遭遇当中,在算法发现了照片,并自动触发系统锁死马克的账户,并交由人工查验之后,核查员似乎并没有考虑当时的场景,没有发现这张照片是发给医疗专业人士的。

事后,马克立即进行了申诉。然而谷歌不仅拒绝复核之前做出的决定,甚至都不让他下载保存自己的数据。被关闭的账号,数据在两个月后就被自动删除了,马克失去了过去多年积累的很多重要信息。

事情就这样拖了整整一年,直到去年年底警方正式启动了调查。

在这一年里,马克几近“社死”,很难跟同事和朋友完整、诚实地解释,自己的电话号码、邮箱,为什么突然就凭空消失了。

直到今年前不久,当地警方才完成了调查并予以结案。

结果毫无意外:马克无罪。

对于把自己的忠实用户推进深渊,谷歌用法律作为挡箭牌的解释,很合情合理,却也绵软无力。一位公司发言人表示,美国的儿童保护相关法律要求像谷歌这样的公司必须对发现的 CSAM 事件进行上报。

根据谷歌的透明度报告,仅在2021年度,公司就屏蔽了近120万个涉及 CSAM 的超链接,向美国相关监督机构“全国失踪与受虐儿童服务中心”(NCMEC)提交了87万份报告,涉及约670万条内容,关闭了约27万个账号。

遗憾的是,马克不幸成为了27万分之一。

身处这27万人中间,就像那些进了监狱却高喊着无辜的人一样,那种有冤情说不出,说出也不被人相信的滋味,简直无法想象。

好心办坏事

在介绍打击 CSAM 工作的官方页面上,谷歌宣称,公司组建并训练了专门的队伍,使用最尖端的技术来识别 CSAM。

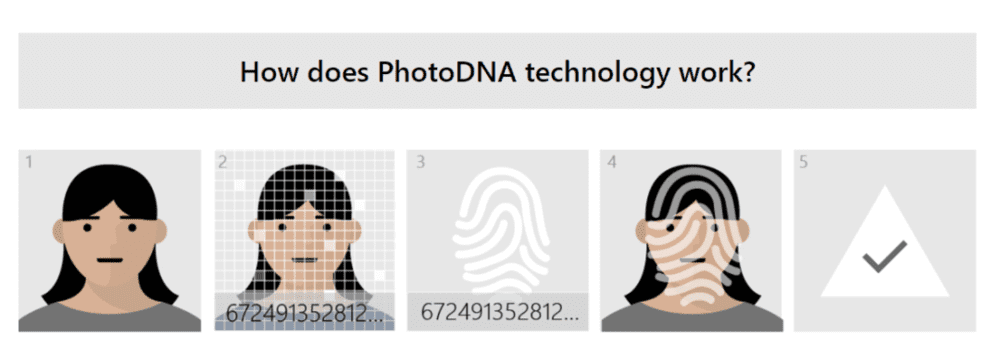

目前在美国大公司的范围里,检索 CSAM 有两种技术途径:哈希值匹配和计算机视觉识别。

哈希值匹配比较简单,就是调取市面上第三方机构维护的数据库里的条目,和自己平台上的图片进行哈希值匹配,从而检测已知的 CSAM 相关内容。这方面早年谷歌曾经用过微软的 PhotoDNA。这项技术已经存在了10年多的时间了,不止谷歌,包括 Meta、Reddit、Twitter 等公司,以及 CSAM 领域的权威公共监督机构 NCMEC,都在使用它。

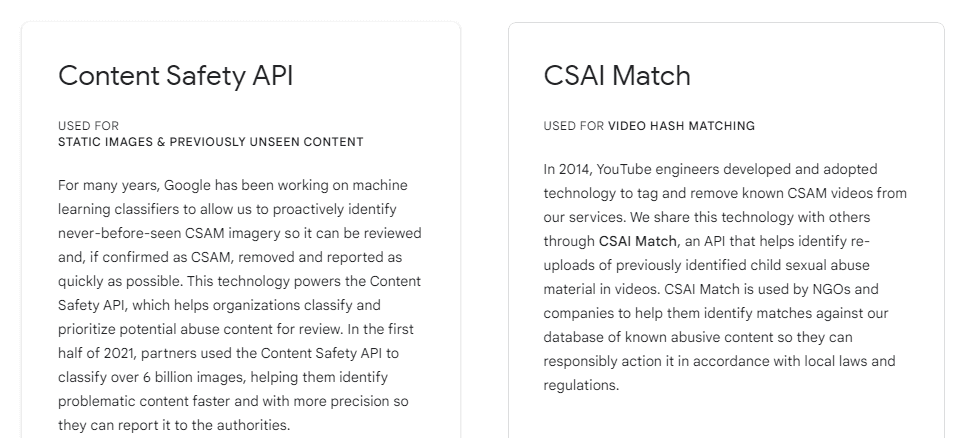

以及,谷歌系的 YouTube 也在使用自研的 CSAI Match 技术来,实现流媒体视频的哈希匹配。

当然,每天都有新的违法图片和视频诞生,所以除了哈希匹配之外,谷歌还自研并部署了基于计算机视觉技术的机器学习分类器,从而检索“未曾见过”的相关内容。

谷歌将这一技术整合到了 Content Safety API 当中,也开放给第三方使用。目前,包括 Meta、Reddit、Adobe、雅虎等公司,也是谷歌自研 CSAM 检索技术的用户和合作伙伴。

至于本次案件,谷歌似乎是从马克的 Google Photos 检索到了相关内容。

Google Photos 是谷歌推出的照片备份和云端相册服务,在自有品牌以及其它一些主流 Android 手机厂商的机型上都有预装。值得注意的是,用户在 Google Photos 里登录谷歌账号后,应用会提示建议用户打开自动上传备份——马克可能就是在这里吃了亏。

如果打开了自动上传功能,除了在某些第三方应用(比如 Twitter、Instagram) 下载的照片之外,包括相机照片集,以及手机上生成的其它照片,都会被 Google Photos 会自动上传到云端。

而根据官方网站和公司发言人透露的情况,谷歌不止明令限制用户通过 Google Photos 上传和传播相关内容,它的 CSAM 打击系统,也会对 Google Photos 里的照片进行扫描和匹配。

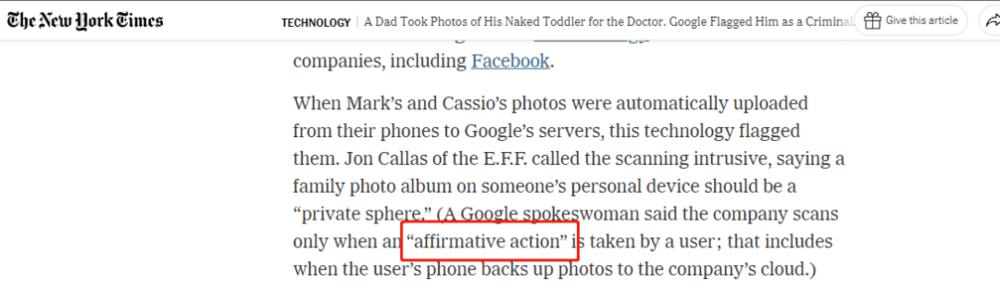

问题在于,根据谷歌发言人的表述,CSAM 打击系统的对象仅限于用户“主动行为” (affirmative action) 上传的图片。

从务实的角度来看,马克开启了 Google Photos 自动上传,结果因为急着给娃看病,拍了这张照片,自动上传了,忘了删,回头被谷歌找上麻烦——这样也要算作主动行为,未免有点牵强。

扫描 CSAM,能够保护儿童安全,有效地打击恋童癖和各种变态,听上去怎么都是一件好事对不对?

然而实际上,近年来美国大型互联网和科技公司在做这件事的时候各种问题故障和丑闻不断——结果就是,算法自动化打击 CSAM 这件事,在技术道德和隐私权方面已经引发了巨大争议。

如果把谷歌这次乌龙事件形容为“人祸”的话,那么去年同一时间苹果出的事故,可以称得上“天灾”了。

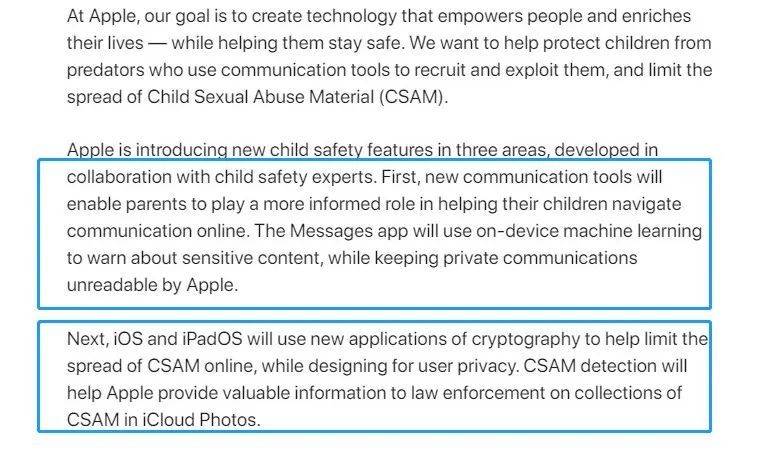

去年8月初,苹果突然宣布,将要在 iOS 平台上推出一个专门扫描 CSAM 的客户端侧工具。

苹果突出的关键词在“端侧”上:和谷歌一直以来扫描云端服务器存储的用户内容的做法不同,苹果表示只会在用户设备上做这件事,系统会下载 NCMEC 的数据库,然后完全在本地进行哈希值匹配。

然而,苹果所谓的“端侧”“注重隐私”等,只是表面说辞。有专家发现,实际上用户发送到 iCloud 保存的照片也会成为检测对象。还有研究者发现苹果所采用的匹配算法 NeuralHash 存在设计理念缺陷。而且这一技术根本不是即将推出,而是好久以前就偷偷植入到公开版 iOS 里了,苹果还专门混淆了 API 命名,以便“隐姓埋名”。

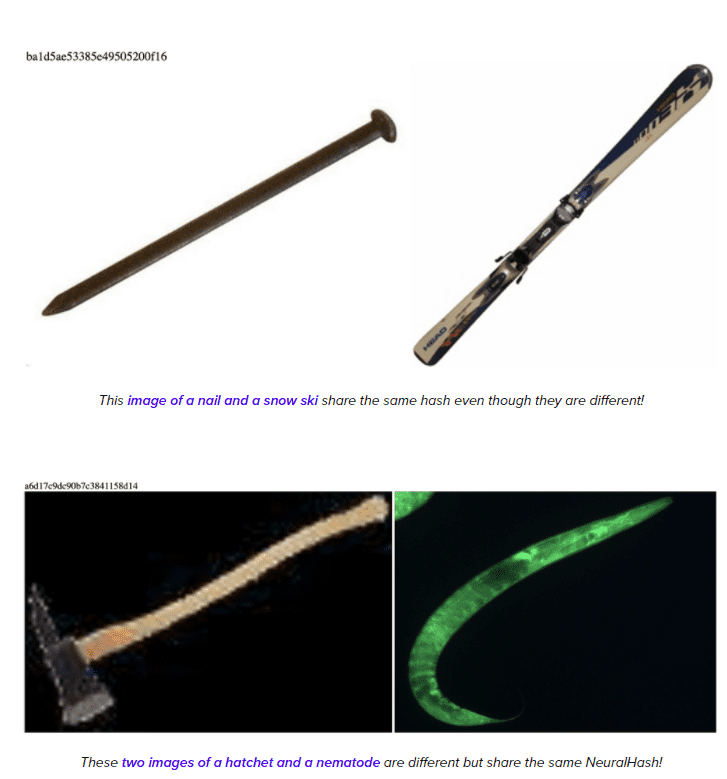

结果,苹果宣布了这件事之后没出一个月,就有人对 NeuralHash 算法实现了哈希碰撞和“原像攻击”。

简单来说,哈希碰撞就是找到两张哈希值相同的随机照片;而原像攻击,则是“刻意生成的碰撞”,也即先给定一张照片,然后生成另一张和其哈希值相同,但内容不同的照片。

甚至,有人直接在广受欢迎的 ImageNet 标注图像数据库里,都能够找到几对天然的 NeuralHash “双胞胎”(两张不同的原视图片,哈希值相同)……

这些攻击测试的结果,从原理和逻辑上直接推翻了苹果的 CSAM 检索技术,使其一文不值。

早期测试的结果显示,NeuralHash 的哈希碰撞发生率和苹果宣称的误报率水平差不多,属于可以接受的范围。然而考虑到苹果在全球拥有超过15亿设备用户,基数过于巨大,一旦 NeuralHash 出现误报,甚至哈希碰撞导致的事故,都会波及大量用户。

总的来看,目前谷歌、苹果这两大移动平台级超大型公司,在扫描和打击儿童色情这件事上,都确实努力做了一些事情,也值得鼓励。

然而这件事的另一面,却令人大为遗憾:因为一张随手拍出的照片,工作和生活陷入僵局,甚至险些身败名裂,这恐怕是马克,以及不少和他经历相似的人,所完全没有预料到的。

这也是整件事的尴尬之处:在过界的科技平台和糟糕的算法面前,好心真的可能会办坏事。

本文来自微信公众号:硅星人 (ID:guixingren123),作者:光谱 杜晨