本文来自微信公众号:科技新知(ID:kejixinzhi),作者:樟稻,编辑:伊页,原文标题:《自动驾驶也怕“被追尾”?》,题图来自:视觉中国

第二季度的汽车供应链危机刚刚度过,盛夏之末自动驾驶相关的交通事故又此起彼伏,不免让外界谈之色变:

辅助驾驶状态下的小鹏P7突发致命车祸、理想ONE在开启NOA(导航辅助驾驶)时撞上高速公路工程车、零跑汽车高速上半自动驾驶追尾前车……

上述这些事故严格意义上属于“辅助驾驶”的范畴,但后者经常在面向用户的车企广告、车辆销售时被混淆概念,可以说是披了一层“自动驾驶”的外壳来吸引关注。

当“辅助驾驶”在舆论漩涡中分身乏术之时,看起来危险性更大的“自动驾驶”本尊,却显得“无辜”起来。

同样在8月,网上流传一辆萝卜快跑无人出租车的车祸照片。内容显示,萝卜快跑无人车的后部遭到撞击,有车轮脱落,车损较为严重。

事后萝卜运力方面表示,“网上流传的萝卜运力测试车辆与社会车辆发生交通事故的照片,为8月10日萝卜运力车辆在正常测试过程中,被后方车辆分心驾驶导致追尾事故,无人员伤亡。”

公告最后,萝卜运力还提醒外界称,“近期相关部门也在不断呼吁告诫广大机动车驾驶员——分心驾驶如盲行。”颇有几分自矜的意味。

回顾以往,自汽车开始普及,交通事故问题一直伴随至今。随着行业安全标准的不断推动,安全技术能力的不断提升,社会逐渐接纳了适当的风险。

如今,人工智能等新一代技术的推动下,自动驾驶汽车逐渐在物理世界中出现。新事物的诞生往往夹杂着质疑,自动驾驶是否足够安全,一直是横亘在用户面前的一座大山。

从自动驾驶事故特征的横截面来剖析,无疑是消解技术隔阂的一种有效方式。

自动驾驶躺枪?

萝卜快跑不是第一次被追尾。

就在6月初,网上流传一辆萝卜快跑无人驾驶测试车的车祸照片。从照片中可以看到,车尾被严重撞毁,疑似发生追尾。

事后,百度方面回应声称,网上流传的萝卜快跑测试车辆被追尾照片,系发生在5月上旬,萝卜运力测试车辆在北京经开区正常行驶状态下,被后方货车追尾导致的交通事故。

上述负责人表示,经现场勘查、取证等工作,事故形成原因是货车未与前车保持足以采取紧急制动措施的安全距离的违法行为所导致,事故认定货车驾驶员负全部责任,和自动驾驶没有关系。

从现有披露的信息中看,平台声称自身不负有责任,且在现有的法律框架中,追尾事故多半是后车的责任。但短短3个月时间内,萝卜快跑就发生两起被追尾事件,概率不可不谓之高。

倘若拉长时间线来看,在数起典型的自动驾驶事故中,被追尾的次数其实屡见不鲜:

去年8月,苹果的两辆自动驾驶汽车发生了轻微交通事故。根据美国加州机动车辆管理局(California Department of Motor Vehicles,简称DMV)公布的事故报告显示,在这两起事故中,苹果公司的汽车均是被追尾。

更为巧合的是,2018年9月1日,据路透社报道,苹果自动驾驶车辆发生了首次“碰撞”事故,同样是被别人追尾。

根据苹果公司上交给DMV的一份文件显示,苹果的一辆雷克萨斯RX450自动驾驶测试汽车在“自动模式”下,以低于1 Mph的速度驶入劳伦斯高速公路时,被一辆2016款日产聆风追尾。

对于这起事故,苹果发言人拒绝发表评论,同样不愿回应此次事故测试车是否有责任。

典型案例之外,自动驾驶车辆频繁被追尾是偶然事件吗?从数据来看,答案是否定的。

DMV从2014年4月开始为自动驾驶汽车发放道路测试许可证,并要求所有自动驾驶汽车制造商每年提交驾驶测试中自动模式脱离和事故报告。

截至2022年8月5日,DMV收到499份不同厂商自动驾驶汽车真实道路测试车辆碰撞报告。分析这些数据,可以从中发现一些规律。

2014~2018年,报告中记录了82起自动驾驶汽车在自动驾驶模式时发生的事故,其中:

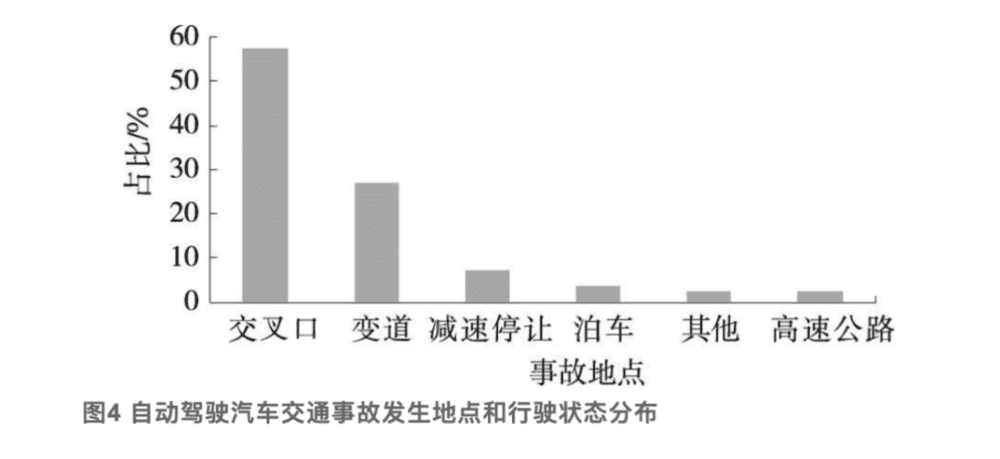

自动驾驶汽车交通事故主要发生在城市道路上,占总数的95%,城市道路上自动驾驶汽车事故中,发生在交叉口、变道和减速转弯的事故率分别为57%、27%和7%。

在交叉口事故中,64%是自动驾驶汽车停驻等候红灯或行人时被普通车辆追尾,15%是在减速转弯时被普通车辆追尾,其余的是在信号灯变红自动驾驶汽车减速或信号灯变绿自动驾驶汽车起动时被普通车辆追尾。其余场景中,被追尾次数占比比例也颇高。

从这份数据可以得出结论,自动驾驶车辆碰撞的原因,经常是由其他道路交通使用者所致被追尾。

当然,这份数据是2018年之前,随着自动驾驶技术的发展,车辆碰撞情形或许会发生变化。

根据百度发布的《自动驾驶汽车交通安全白皮书》显示,2014~2020年中,根据DMV公布的数据,在所记录真实事故案例中,自动驾驶汽车事故主要由其他道路交通使用者所致,占比为84%,因自动驾驶汽车自身原因所致事故占比为16%。

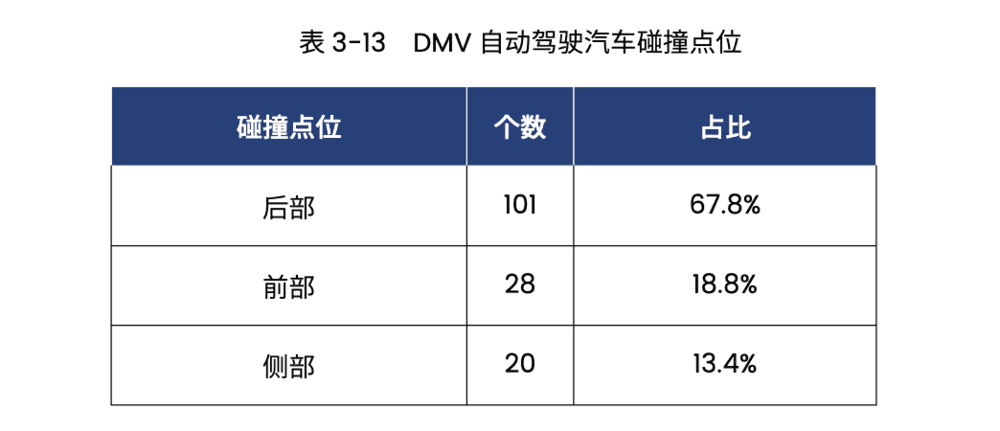

其中,在2019~2020年时间段内,自动驾驶汽车发生事故时,后部碰撞(其他道路交通参与者追尾正常行驶的自动驾驶汽车)点位个数为101个,占比67.8%。

从以上数据来看,自动驾驶似乎才是那个“受害者”。

技术未必无辜

在上述报告中,主要将因其他道路交通参与者导致的追尾事故场景定性为,其他机动车辆试图对自动驾驶汽车强行变道超车、自动驾驶汽车在交叉口附近进行减速礼让。

而造成车辆追尾的原因,被解释为后车驾驶人注意力不集中、疲劳驾驶、跟车太紧而车速快、车辆尾灯或刹车故障、轮胎磨损、雨雪天路面打滑及雾天能见度降低、路面磨损等。

从这些原因来看,似乎自动驾驶才是遵守交通规则的“好学生”,不遵守交通规则的人类驾驶员,才是追尾事故的始作俑者。

但数据同样是一把双刃剑。

美国统计专家Darrell Huff,早在其著作《统计数据会说谎》中,揭示了统计学领域惯常会出现的操纵伎俩,当时还引起了民众、政府和媒体对于“社会统计数据信息”的关注和探讨。

这类事件中,一个容易被忽视的地方在于,上述的碰撞数据均由厂商将涉及自动驾驶汽车的交通事故报告(OL 316)提交给DMV,在涉及事故细节一栏上也由厂商填写。因此,存在一定的“修饰”也是可能的。

除此之外,还需要考虑安全员的影响。当下,尽管部分地区新规允许服务商提供“主驾位无安全员、副驾有安全员”的自动驾驶出行服务,但多数自动驾驶场景中,主驾安全员是必备的。

根据公开资料披露,2021年,百度一辆L4级自动驾驶测试车辆在某开放道路测试过程中,发生一起由于安全员接管不当导致的车辆碰撞。

事发时,测试车辆左转通过交叉路口,对向社会车辆直行闯红灯,进入路口后社会车辆前部碰撞测试车辆右侧前部。尽管不是被追尾,但该事故同样是主要由其他道路交通使用者所致。

测试车辆在自动驾驶模式下左转进入路口,行驶至路口中间位置时,感知到对向车道内有社会车辆处于运动状态,并根据预测出的行驶轨迹预判其有闯红灯的安全风险,从安全角度考虑,自动驾驶系统采取制动措施提前避让违规通行的社会车辆。

但同时,测试车上的安全员也看到有车辆闯红灯朝向测试车驶来,出于驾驶本能,通过踩踏加速踏板的方式进行人工接管,指挥测试车辆在人工驾驶模式下加速行驶,最终被社会车辆碰撞。

还可以发现,人为的原因之外,自动驾驶自身的配置同样也能影响到追尾事故。

在今年2月,美国国家公路交通安全管理局(NHTSA)收到的关于特斯拉汽车意外和不必要的制动事件投诉越来越多,监管机构表示正在调查。

这种现象被调侃称为“幽灵刹车”。即用户在开启Autopilot或者使用FSD等L2自动驾驶系统时,车辆会在某种看似无需刹车的情况下突然无征兆地刹车。

这个故障对于车后跟随行驶的其他车辆来说,无疑是一种潜在危险。对此,不少车主向监管机构投诉称,特斯拉车辆的幽灵制动让其陷入被追尾的险境中。

据《华盛顿邮报》报道,2021年11月~2022年1月的三个月里,关于特斯拉“幽灵刹车”问题报告已经上升到107起,而在之前的22个月里只有34起。

今年5月,美国国家公路交通与安全管理局(NHTSA)已经给特斯拉公司发函,要求其在6月20日之前给大量特斯拉用户,因车辆频频出现“幽灵刹车”给出解释。

据《车东西》统计,“幽灵刹车”投诉增加的时间点正是出现在特斯拉宣布取消自动驾驶系统中的毫米波雷达之后——说明纯视觉路线与幽灵刹车的增多直接相关,即配置和算法问题。

尽管L2级的辅助驾驶,与L4级的自动驾驶有所区别(传感器、算法等),但技术路径上本就存在一定共性。Frank就曾分析Apollo 6.0 中一个简单的模块Guardian,发现也存在紧急刹车的情况。

因此,自动驾驶确实需要警惕最近发生的同类事故。

写在最后

有亲身体验过自动驾驶的业内人士表示,“坐过自动驾驶出租车就可以发现,它太遵守交通规则了,以至于路上大多数车辆反而显得不守规则。旁边车辆稍一加速超车、或者前面有行人离车较近,自动驾驶车辆为了保证行驶安全就容易紧急制动,急刹车时顿挫感非常明显。”

这似乎成为了一道难解的数学题:如果通过预判与估算等综合算法来灵活控制自动驾驶车辆的行车轨迹,以至于让其“更像”真人驾驶,反而更会提升事故率。

其实,在如今的技术水平下,假设自动驾驶车辆上路后,都能按照既定的规则行驶,相对而言是安全的。核心矛盾在于,人类驾驶员的行为是非常复杂的,除非上路车辆全部自动驾驶,否则难以预判人类驾驶,车祸的发生就避无可避。

在上述案例中,对自动驾驶被追尾事故的苛责,似乎显得有些吹毛求疵,因噎废食本就是不可取的,任何一项技术从诞生走到完全成熟都需要过程。

但如今自动驾驶正处于技术快速演进、产业加速布局的商业化前期阶段,任何矛盾都容易被舆论无限放大。

今年8月8日,百度表示称已获得重庆和武汉的批准,可以向乘客提供全无人驾驶网约车有偿服务,这些网约车没有司机或安全人员。

目前自动驾驶车辆无需在驾驶座配备司机,但大多情况下仍然需要在副驾座位上配备一名安全人员。此次获批,预示着自动驾驶商业化落地更进一步的同时,安全性也被外界更加关注。

作为自动驾驶技术与产业应用发展最重要的前提条件,在行业进入“稳步爬升期”之前,对安全过分谨慎些一点也不为过。

参考资料

公路与汽运《美国加州自动驾驶汽车路测数据分析》

百度《自动驾驶汽车交通安全白皮书》

车东西《拿掉毫米波雷达后,特斯拉3个月被投诉了107次》

Frank《自动驾驶 Apollo 源码分析系列,安全守护篇(一):为何紧急刹车?》

本文来自微信公众号:科技新知(ID:kejixinzhi),作者:樟稻