本文来自微信公众号:硅星人(ID:guixingren123),作者:光谱杜晨,编辑:Vicky Xiao

就在特斯拉中国因为车主车顶维权一事而被千夫所指时,在大洋彼岸的美国,特斯拉同样再度遭遇一场噩梦。

4 月 17 日,一辆 2019 款 Model S 在美国得克萨斯州休斯顿市郊发生严重车祸,高速撞击路旁树木。车辆完全烧毁,因为电池不断爆燃,消防员用了整整 100 吨水才完全扑灭了火焰。

诡异的是,车内的两名死者,一名在副驾,一名在后座,调查人员对公众表示“百分之百确认驾驶座上没有人”。

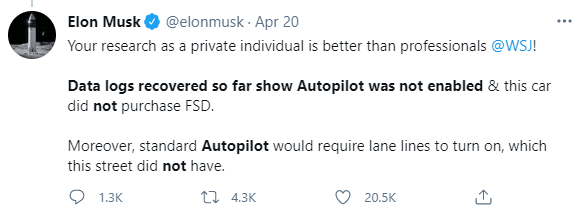

事故发生前不久,特斯拉 CEO 马斯克刚刚在 Twitter 上发布过公司新统计的数据,显示 Autopilot 功能的事故率是其它所有车辆的十分之一。事发后,马斯克回帖网友的推文,表示目前从车辆中收集到的数据显示,事故发生时 Autopilot 功能并未启动,该车辆未购买 FSD 高级自动驾驶功能升级包。

不管马斯克如何辩解,公众对于特斯拉 Autopilot 辅助/自动驾驶功能的质疑还是再一次甚嚣尘上。作为一款含有市面上较为先进的辅助驾驶功能和乘驾安全体验的电动车,Model S 为何在驾驶座上无人时仍可以高速行驶,无论 Autopilot 是否启动,都令人费解。

美国汽车安全监管部门 NHTSA,已经派出专门调查组参与事故调查工作,当地警方也计划对特斯拉公司下达搜查令,提取事故车辆的数据。

根据特斯拉宣布的数字,Autopilot 启动时的事故率,约每420万英里一次事故,是 NHTSA 统计的美国总体情况的十分之一。不过考虑到 Autopilot 作为特斯拉电动车的最大卖点之一,目睹这些事故一而再地发生,还是令人心惊胆颤。

并不是特斯拉的技术不行,它在辅助/自动驾驶上的技术和里程积累强于其它竞争对手是不争的事实。整件事情里最令人害怕的,是特斯拉作为辅助和自动驾驶技术的领导者,严重夸大 Autopilot 功能和电动车的其它技术特性的行为被默许了。

在现有情况下,车主信赖特斯拉宣传的辅助/自动驾驶功能,结果该功能没有正常工作,导致事故发生;而另外一些情况,则是这些过度宣传误导了消费者,在很大程度上容许甚至激励了少数车主危险驾驶的行为。

自动驾驶 or 辅助驾驶?

2016 年 5 月 7 日,美国俄亥俄州,一辆开启了 Autopilot 功能的 Model S 撞上一辆卡车,驾驶员当场死亡,Autopilot 在美国夺去了第一条生命。彼时,Autopilot 功能刚刚上线半年。

相信很多硅星人读者都还记得,2018 年在硅谷山景城的 101 高速路段,一名华裔车主 Wei Huang 驾驶 Model X,撞上了混凝土隔离带,不幸丧命。遗憾的是,当时开启的 Autopilot 以及车上搭载的诸多先进的传感器,均没有及时发现并警告车主前方隔离带导致车道收窄(特斯拉的说辞是,隔离带本身已经破损,缺乏足够清晰的视觉提醒)。

包括上周休斯顿的事故,美国国家运输安全委员会 NTSB(一个政府属性的民用交通事故调查机构),正在对至少 28 起特斯拉电动车伤亡事故展开特别调查。这些事故涉及包括 Autopilot、电池起火、刹车失灵等诸多因素。

据硅星人统计,自从特斯拉于 2015 年 10 月发布 Autopilot 功能以来,全球已知确认 Autopilot 功能开启的相关事故,已经造成至少 6 人死亡,其中 3 人位于美国,另外 3 人分别位于中国(2016 年 1 月 12 日)、日本(2018 年 4 月 29 日)和挪威(2020 年 5 月 4 日)。

Autopilot 模式启动所导致的事故人员严重受伤,更是多到不计其数。

相当一部分车主最初选择特斯拉,看中的正是它的高科技属性。而 Autopilot,又是人们期待已久的自动驾驶技术在大规模市售车型中的最早也最高调的应用。不过自从 Autopilot 推出以来,对于该功能到底算不算自动驾驶功能的讨论和质疑,一直此起彼伏。

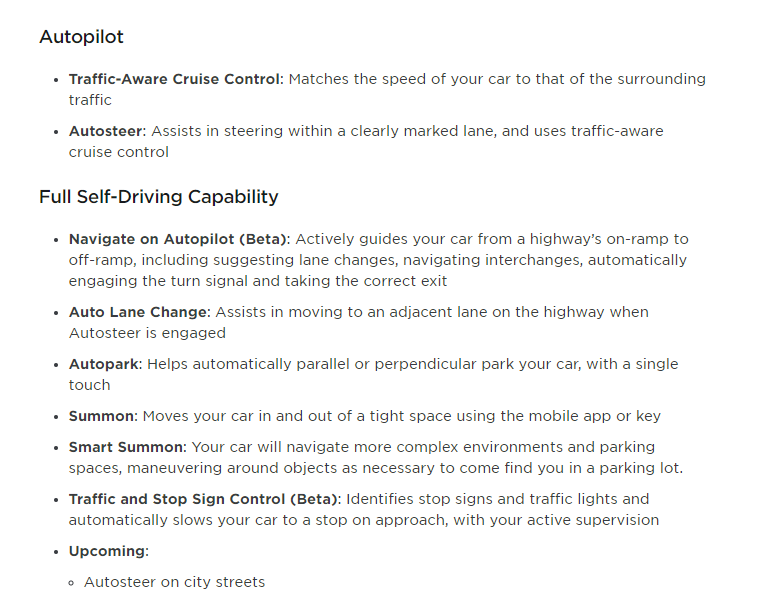

简单来说,Autopilot 是一个更加先进的汽车自动巡航功能,从 2019 年 4 月之后的车型开始标配,无需额外付费;2016 年~2019 年的车型均包含了 Autopilot 所需的硬件,需要付费才能激活。

除了定速巡航、跟随车道之外,Autopilot 还有一个 FSD 模式,可以自动进行转换车道、根据周围交通情况自动调整车速、变换车道、驶入驶出匝道、自动泊车、根据信号灯/停车指示牌完成操作等更多功能,作为升级包,售价 10,000 美元。

FSD 的全称是 Full Self-Driving(完全自主驾驶),其中大部分功能均已商业化;少数功能仍处于公测阶段(Beta),但也对市售车型的消费者开放,只要付费升级 FSD,即可开启。

即便如此,特斯拉还是在它的营销宣传中使用了 FSD 这一明显带有误导性的命名方式。

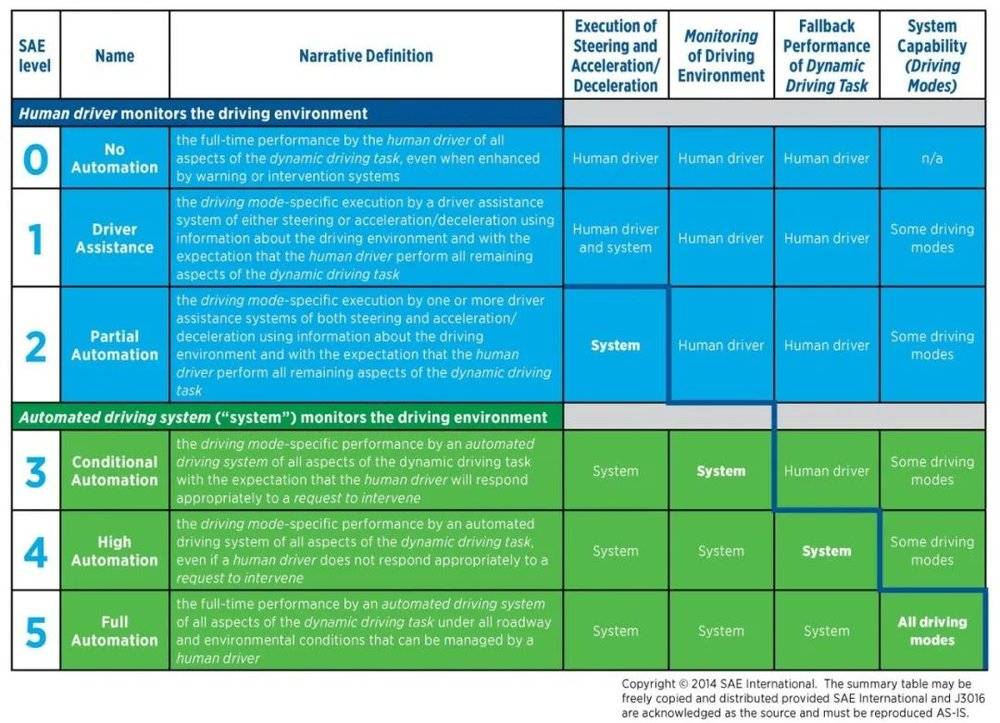

根据国际自动机工程师学会(SAE)发布的,被行业广泛接受的定义方式,Autopilot 以及 FSD 功能的自动化分级水平位于 L2 至 L3 之间,并未达到公认的“自动驾驶”。特斯拉自己并未明确定义过 Autopilot/FSD 属于何种自动驾驶等级,不过马斯克去年曾经表示特斯拉很快就将实现 L5,也即完全的自动驾驶。

具体来说,L3 的其中一个指标就是在特定情况下驾驶员可以无需关注路况(eyes off)。

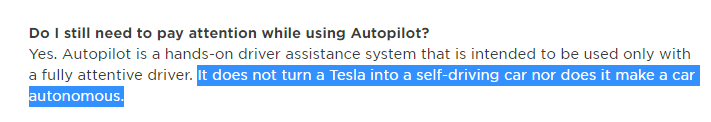

而特斯拉确实有告知用户,即使开启了 Autopilot 功能,驾驶员也仍需保持注意力——意味着 Autopilot 未达到 L3 水平,不属于自动驾驶。

另一个问题在于,前述特斯拉对用户的告知,没有出现在 Autopilot 功能介绍足够明显的位置,也没有以足够清楚、带有警告性的方式呈现。

除此之外,特斯拉还宣称,Autopilot 功能“并不会将特斯拉汽车变为一辆自动驾驶汽车”——而这又和 Autopilot/FSD 的命名方式产生了直接冲突。

很明显,特斯拉 Autopilot 功能仍处在辅助驾驶的水平。而将其一部分功能称为 Full Self-Driving,难免有过度营销甚至虚假宣传之嫌。

海外汽车媒体 Autoblog 报道,一些专业人士对特斯拉 Autopilot 夸张的营销行为表示愤慨。

UC 伯克利自动驾驶技术研究者 Steven Shladover 表示,特斯拉的这种行为“就是在刻意误导人们,Autopilot 的功能非常有限,仍需驾驶者保持注意力”。

南卡罗莱纳大学法学教授、自动驾驶相关研究者 Bryant Smith 则认为,特斯拉的行为已经超出了“误导”“不负责任”的范畴,甚至可以被定性为欺诈,“叫什么 Autopilot 已经够过分了,升级成为‘完全自动驾驶’只会更糟糕”。

而这种模棱两可的宣传方式,为特斯拉制造了“甩锅”的机会。

在2018年山景城 Model X Autopilot 事故中,特斯拉宣称驾驶者“有长达5秒的事件可以作出反应”,但车主没有对路况保持实时关注,才导致事故的发生;在其它几起已知的 Autopilot 事故中,以及除了 Autopilot 之外的其它涉及产品质量的事件当中,特斯拉的回应也大致相同。

欧洲正在行动,美国无动于衷

2019年,马斯克就在 Twitter 上透露过,由于自动驾驶功能的合法性在德国等欧盟国家尚未确立,一部分 Autopilot 的最新功能会在当地受到限制,特斯拉正在和欧盟监管部门合作,以探讨解决这一问题。

这一“合作”并未产出什么有价值的结果,反倒是特斯拉毫不遮掩地在德国继续宣传 Autopilot 和 FSD。

去年,德国反不正当竞争监管机构将特斯拉起诉到了巴伐利亚州一家法院,指出该公司的 Autopilot 和 FSD 的命名、宣传行为,构成了误导公众的行为,并且包含这些功能的汽车在德国上路,违反了当地有关交通安全的法律法规。

法院判定特斯拉败诉,并禁止该公司在面向德国民众的宣传内容中使用 Autopilot、FSD 之类的字眼。比如,特斯拉将被禁止告知消费者,购买 FSD 升级包可以“解锁自动驾驶的完全潜力”。

法官认定:特斯拉带有误导性的宣传内容,暗示了该系统在德国合法,而事实并非如此;而且,特斯拉还让消费者误认为特斯拉汽车可以在无需人工干预的前提下自动驾驶。

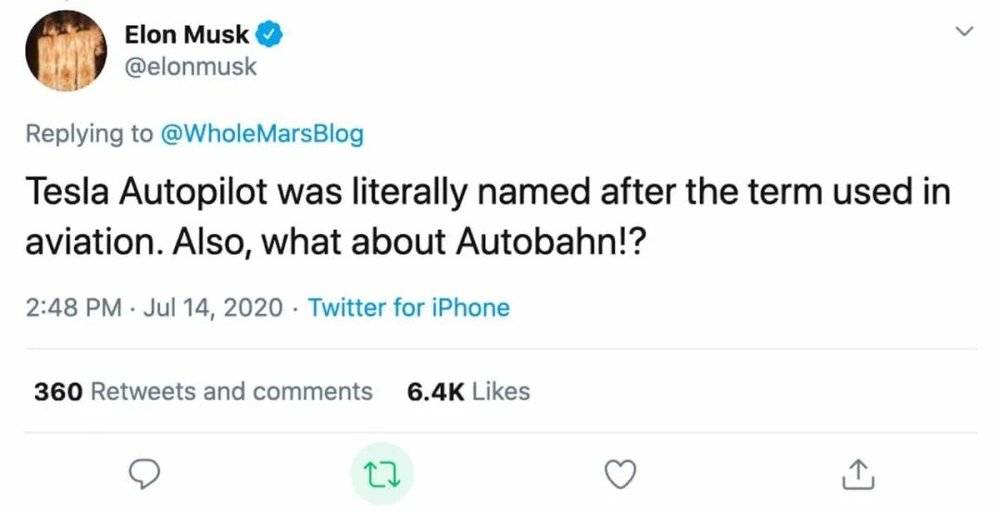

马斯克对此的回应绵软无力:“我们 Autopilot 的命名方式是从航空领域(飞机的辅助巡航功能)来的,德国的高速路不也叫 Autobahn 嘛。”

与此同时,欧盟新车安全评鉴协会(Euro NCAP)成员、英国汽车安全专家 Matthew Avery 也指出,特斯拉公司面向英国特斯拉用户的宣传方式,也可能构成误导宣传的嫌疑。

此前,特斯拉给英国的车主发过一封促销邮件,写道:“我们的记录显示你还未将你的新车升级到完全自动驾驶能力,现在升级可以享受折扣,仅需2,200英镑。”(Our records indicate that you haven’t upgraded your Model S… to Full Self-Driving Capability. You can upgrade now at a reduced price of £2,200.)

这里的“完全自动驾驶能力”,其实只是 FSD 而已……

但对于那些对技术不太感冒的车主来说,这种宣传方式容易误导他们,让他们以为交了这笔钱,自己的车就获得了完全自动驾驶的能力了。

这位英国汽车安全专家,对特斯拉的怨言主要也是集中在宣传上,而不是技术上。他认为特斯拉 Autopilot 技术其实还挺好用的,“如果进行正常合理的宣传,这些功能对于道路安全最终还是有帮助的”。

但是,Autopilot 的推广不能够建立在过度宣传的基础上,而是应该警示司机不要形成错误的印象,不应该对 Autopilot 过度依赖。

“Autopilot 导致的许多事故都是致命的。这些司机究竟是在闹着玩,抑或是更糟糕的情况——他们真的相信 Autopilot 具备完全自动驾驶的能力——我们无从得知。”

一边,欧盟国家愈发重视此情况,另一边,美国各级监管部门却对特斯拉涉嫌过度宣传的行为,在很大程度上无动于衷。

美国科技公司在自动驾驶技术上的领先,是不争的事实。因此,为了避免打击创新,监管机构 NHTSA 在过去相当长的时间里,一直没有在联邦层面对车企和自动驾驶技术公司进行过有效的监管,只是在有限的几桩恶性交通事故发生后宣布参与调查。

具体的监管职责,很大程度上被下放到了州。而在州级层面,出于保护企业促进创新等因素,政府监管特斯拉等自动驾驶技术公司的意愿更低。

以自动驾驶路测为例:对自动驾驶公司开放度较高的加州、亚利桑那州等,当地部门只是每年从这些公司那收集路测报告,然后公开。这些报告怎么写,当地部门大体上没有严格的要求,公司有很大的自主权。甚至对于路测中发生的事故,这些公司都可以自己修改定义方式,从而蒙混过关,让报告显得更好看。

UC 伯克利的 Smith 教授指出,在美国联邦以及各州层面,监管机构在处理自动驾驶相关事故时,偏向将责任放在驾驶员的身上,而忽视了对于像特斯拉等车企的追责。

随着自动驾驶技术的进步,新的驾驶体验不断冲击着汽车工业,促进了创新,也客观导致了交通事故发生,引发社会讨论。在中国、欧洲等世界主要国家市场,对自动驾驶技术的监管,以及对特斯拉等公司的调查,都在逐步升温。

如果车企被认定存在过度宣传和误导消费者的情况,它就应该进行整改,而不是撑着技术和体验创新的大旗,继续摇摆。

本文来自微信公众号:硅星人(ID:guixingren123),作者:光谱杜晨,编辑:Vicky Xiao