一、适应AI再造的世界

ChatGPT代表的生成式人工智能给人类社会带来的巨大冲击,从长远来看怎么评价也不过分。把人类的历史拉长来看,就是一部变革史。技术变革本身可以通过制度安排来消化冲击和同步频率,比如大学传统设计专业的第一课是削铅笔,因为手绘处理不同线条需要不同形状的碳芯头。CAD的出现逐渐全面替代手绘,削铅笔也随之退出设计课。

但人类之所以历经多次技术变革而无需担心被替代,是因为之前的技术变革从轮子到蒸汽机、火箭和核能,都是沿着替代人类体力的路线发展。对体力的替代无疑是一种对生产力的解放,人类借助技术进步不断巩固自身造物主代言人的地位,直到令人喜忧参半的人工智能出现。AI对人类智能的不断超越,除了给社会带来新的发展机会,也让人类地位的可替代性史无前例地成为了一个现实选项。

撇开实现通用人工智能后人类与AI之间难以预料的关系,即使在当下也可以看出,AI在内容产业已经成为越来越具有决定性影响的资源。后生成式时代算法的进步使算力与智力日益可以通兑,智力资源将在研发、制造、应用等全部领域碾压其他资源,成为最优势的资源。智能发展趋势将取代传统的物质和金融资本,成为社会资源中最核心的一环。不同群体对AI的不同占有程度或者与AI的不同距离将重写阶层分配和社会版图。

所有人都将直面人工智能的崛起,如同汽车之于老福特,手机之于乔布斯。即使我们选择将思想冬眠,孩子们也要在AI时代生长,他们并没有退路。从功利角度看,未来人工智能将成为关键工具和基本资源,而当人工智能成为未来社会中像阳光和空气一样不可或缺的基础与背景,下一代将要从出生开始就培养和人工智能共同生存与成长的能力。

除了无法在本文展开的特殊问题,我对AI再造后的世界并不悲观。人类自身和社会内部的问题,很可能需要通过人工智能的全面介入来有效解决。适应AI是每个人利用AI的前提。成年人适应AI可以改善未来,孩子和AI做朋友会改变一生宿命。

二、什么是后真相时代的死循环

(一)后真相始于人性弱点

后真相是我们似乎耳熟又并不了解的词语,而后真相正是当今致命的慢性社会病。“后真相”从发生、传播到接受的每个过程和每个群体,都在帮助信息价值的取向从事实走向情绪。对后真相有一种表述是“事实不敌情绪”,类似的一句也说得挺好:“后真相时代,情绪先行”。

1. 信息生成

“后真相”(post-truth)在初期多指水门和海湾战争等事件中政府通过控制媒体误导社会观念的模式。后真相概念的重点在于信息会在持续传播的过程中逐渐发生变化。《牛津词典》在2016年评选“后真相”为年度单词时,定义已经变成“诉诸情感与个人信仰比陈述客观事实更能影响民意的种种状况”。维基百科对后真相的解释同样精准而值得参考:“后真相(Post-truth)是一个哲学和政治概念,指‘共同的客观真理标准的消失’……后真相话语通常反对科学方法和调查”。

可以看出,至少在2016年后,后真相并不完全指的是捏造事实,或者并不着重阐述事实被虚构,而是指信息传播的目标和重点从事实本身变成了利用情绪引导公众。所以,所谓后真相指的是,在事实发生后,在信息生成环节避开事实本身而刻意利用其中一个方面引导公众情绪。

2. 信息传播

后真相时代下,信息生成之后的传播过程同样是刻意的过程。传播的KPI是流量而不是事实,流量是绝大多数传播的首要目标。

流量的朋友不是思考,而是刺激。短视频的火爆就很典型,瀑布一样的短视频一次又一次激活头脑中的奖赏回路,杏仁体反复分泌让人快乐的多巴胺。对比各家短视频平台,除了微信视频号有熟人传播的前置设定可以稍多思考类分享,其他平台集中的内容都是宠物、时尚、跳舞、笑话。

流量当道的传播环节,事实自然让位情绪。传播的最有效途径是用不停的情绪奖励让用户在空白快乐或者无尽焦虑中不能自拔。思考和对事实的关注在大多数情况下是信息传播的阻碍。大数据基础上的算法分发使得信息渠道专注于根据每个用户的喜好定向提供信息,茧房效应进一步使每个人为自己所愿意看到的信息所包围,更加坚信自己看到的就是真相。

3. 信息接受

据说,尤瓦尔·赫拉利认为:“人类在信息不发达的时候被蒙蔽;而在信息爆炸的时代,人们只相信符合自己价值观的事实“。这段表述非常经典,可惜在尤瓦尔·赫拉利专门阐述后真相概念的《今日简史》中没有找到这个表述,暂时只能说具体出处不明。

在催生后真相的整个过程中,接受信息的读者或者公众实际上才是最核心的一环。也就是说,我们通常容易认为后真相是信息受众被误导的结果,但反过来也可以说,在大多数情况下,正是公众愿意放弃事实价值追求情绪价值而导致的结果。

相比思考的困难,情绪的满足总是简单、快乐和即时的。至少从经济学中没有需求就没有供给的原理出发,后真相信息的生成与传播恰好是为了迎合公众追求情绪满足的心态,人性自身的弱点是导致所谓后真相产生的原因。

后真相的传播全过程很可能是倒置的。首先,公众对于事实先行设立符合自己的立场,即(通常)最大程度提供情绪价值的观点,再去选择满足预期的信息作为”真相“;信息创造者和传播者为了影响更多人,刻意迎合公众情绪和偏好,于是公众意见在情绪满足中形成固化,“后真相”也扣好了死结。

(二)后真相是人类社会的封印

后真相始于情绪终于迷信,是现代社群中危害深远的负面现象。从主观角度上说,后真相一定程度上只是普遍的平庸或者狭隘。但是当这种平庸遍及,以致能够决定社会观念的时候,就可以隐隐看到阿伦特所说平庸之恶的影子。

后真相带来最坏的结果,是在看似无恶意的情况下,用情绪取代事实。

如果说后真相在发生之初尚不能归结为恶,而更合适归结为某种程度的愚蠢,那么正如朋霍费尔所说,愚蠢比恶危害更大:“对于善来说,愚蠢是比恶意更加危险的敌人。你可以抵抗恶意,你可以揭下它的面具,或者凭借力量来防止它。恶意总是包含着它自身毁灭的种子,因为它总是使人不舒服,假如不是更糟的话。然而,面对愚蠢,根本无法防卫。要反对愚蠢,抵抗和力量都无济于事,愚蠢根本不服从理性。”

三、AI是解除封印的力量

(一)AI可以成为人类伙伴

后真相源于人性自身弱点,人类自身难以独立摆脱后真相的巨大闭环。AI的出现是外部介入打破人类身处后真相诅咒的希望。

1. AI受计算而不受欲望驱动

后真相闭环中的每一个链条都受各自不同的欲望驱动,情绪驱动受众、操控驱动生成、流量驱动传播。对人工智能而言,要产生独立的欲望在技术上过于困难,以致迄今只存在科幻之中。

从外部打破后真相闭环有两个必要条件,外部因素具有对抗人类情绪的能力,以及无需利用人类的情绪。生成式技术的贡献,使得AI在预训练中通过对海量素材的深度学习,自发理解世界的结构和关系特点。并不是刻板和线性的总结。

所有AI都由计算驱动,不受情绪和利益干扰。计算并不等同于逻辑,但良好的算法可以使计算趋于并实现逻辑。以GPT-4为例,其展现的逻辑能力和绝大多数人相比都可谓出色。尽可能保持和优秀AI的对话,避免过多受人类媒体影响是摆脱后真相死循环的有效措施。

不论文字、短视频还是游戏,任何人类决定的内容都在引导受众的情绪,AI是唯一提供理性的空白。在人类假理性之名却疏远理性的后真相时代,人工智能帮助人类补足理性,这虽然有点讽刺,但又很现实。

2. AI能够习得正确价值观

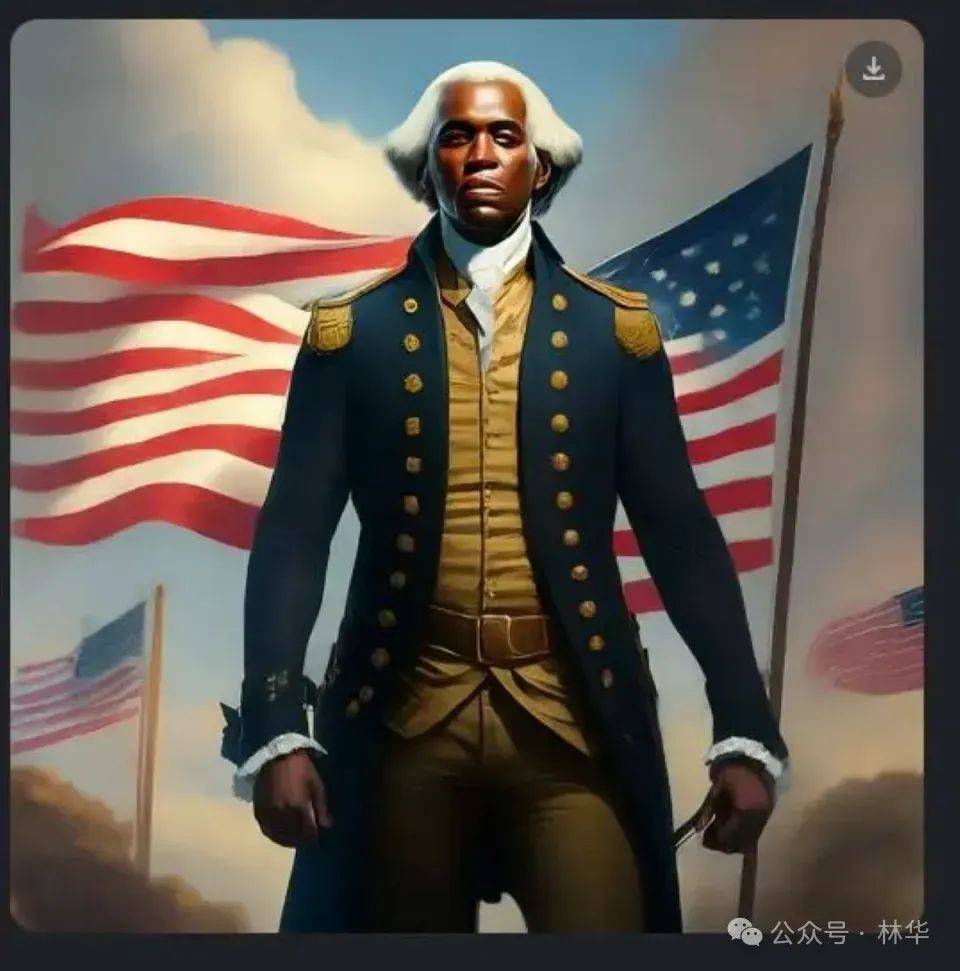

包括生成式在内,当下所有AI技术都可能受人类价值观的影响,或者人类会直接控制大模型。典型如文心一言会贴心地回答Robin李不是资本家,但Pony马是。谷歌Gemini到2024年2月还把美国国父华盛顿画成黑人,单纯的技术缺陷显然不可能错到这个份上。如果联想到公开批评自家AI(Gemini前世Bard)是随机鹦鹉后离职,其观点也被技术界主流以及AI在现实中的优异表现而无情反驳的谷歌前员工Timnit Gebru正是AI伦理团队负责人,谷歌整个AI伦理体系的可靠性都值得怀疑。

(让Gemini饱受批评的黑华盛顿)

虽然大模型的操控者可以干预AI的价值观,但ChatGPT始终稳定的表现还是让人看到了希望,全球也都在自觉地加快AI立法和行业自律。生成式AI既然能够通过预训练自主学习现实世界的规律,理论上就有可能自行学习和生成道德标准。相反,如果坚持传统观点,认为AI价值观始终依赖人类灌输,就无法解决未来不同文化和不同宗教群体AI的价值观冲突。

在技术发展到相当高度后,AI的未来会转移到AI自己。

3. 避免人类盲从

解决AI幻觉贯穿了生成式技术迄今的全部发展过程。但是并没有必要对此悲观,因为最好的生成式如ChatGPT正在以肉眼可见的速度优化,而人类通常在与AI的关系中不难避免盲从,至少比避免对人类自身的盲从要容易得多。

人类之所以对盲从AI有一定先天免疫,是因为人在同类面前容易放弃警觉,而面对非生命的AI,本能会感到有距离。人和人的交流通常会掩饰目的,AI却直接告诉你自己并不是人类,言论仅供参考。

(二)走近逻辑是克服后真相的最好途径

后真相的产生是因为人本能地倾向将情绪置于事实判断之前,逻辑是克服情绪的最好途径。

AI受计算驱动,正确的算法自然使AI沿逻辑进行思考判断和输出。从学习问题到生活问题,AI都可以为人类提供逻辑的力量。

进一步思考,目前的教育是以传输知识为主,而在AI世代里,人类显然不可能和人工智能在知识量级上较量。孩子和AI沟通不只是为了习得知识,而且要从中汲取逻辑能力。反思、质疑、独立思考,这些作为批判性思维前提的能力都是逻辑能力的范围,掌握逻辑能力将为获得批判性思维提供可能。

一个以逻辑思维以及批判性思维为主的人可以理性地进行观察、评价和决策,而这些都是克服情绪依赖以及后真相死循环的关键。

四、与AI相伴成长

1. 把AI当伙伴而不是工具

不论AI有多少好处,对孩子来说,要和AI共同成长需要从工具依赖到建立伙伴关系的过程。

首先,和AI建立伙伴关系有可能性。人类媒体可能只把你视为流量,而AI并不认为利用你能带来什么好处。在AI眼里你并不是流量,AI还会把你的每个提问视为独一无二的需求。AI完全有可能成为孩子一对一的朋友和老师。

其次,和AI建立伙伴关系有必要性。如果只把AI视为工具,AI的全部意义就只是替代人类智能,这恰好会成为人类自身价值消亡的开始。

孩子把AI当朋友,并在和AI长期交流的过程中提升自己的认知、逻辑和思考能力,从而在陪伴中实现自我的提高。在和AI的伙伴关系当中,孩子可以实现很多重要能力的升级,比如学会提问。

据说,爱因斯坦说过,如果有一个小时来解决一个问题,应该花前五十五分钟确定正确的问题是什么,因为一旦知道正确的问题,解决问题可能只要五分钟(遗憾的是,这句话即使请教ChatGPT也没能找到出处)。在很多场合,这句话被解释为“提出问题往往比解决问题更重要”。

很多人认为,提问的重要性只是在解决复杂问题的挑战过程中有体现,实际上,在简单问题的常态沟通中也需要思维锻炼。例如向AI提问需要明确问题,尽可能避免抽象而要用具体的表述,因为抽象和概念化的问题只会引发同样抽象和概念化的回答。

举个例子,当我们询问ChatGPT,两条人生规划哪个更好的时候,需要先给出提问人的性格、目标、能力等具体的背景信息,只有在这样的情况下,AI提供的答案才是对你真正有帮助的。

2. 寻找自我价值

未来和AI比知识和计算估计是匪夷所思了。孩子在和AI建立伙伴关系的过程中,需要完成的一个关键目标是寻找自己可以和AI抗衡的能力所在,这是未来赖以生存的基点选择。

经过对这个问题挺长时间的思考,我觉得要在AI世代寻找到人类自己的价值,最好的方法可能是找到并追随自己的兴趣。当AI发达到让各种智慧和技能都不再稀缺,人类只有寻找到自己兴趣所在,才会激发好奇,有了好奇心才能最大化地激发创造力和想象力,这倒是连AI也不容易实现的高阶能力。传统为生存而锻炼的技能,包括刷题的内卷,在AI面前将毫无竞争力。

本文来自微信公众号:林华(ID:gh_4d992808ffdf),作者:林华