本文来自微信公众号:新智元 (ID:AI_era),作者:新智元编辑部,原文标题:《GPT-4超强进化,近万人联名封杀!白宫紧急开会,ChatGPT概念股暴跌》,题图来自:视觉中国

GPT-5的威胁,已经黑云压顶。

GPT-4诞生后,AI可能给人类社会造成的颠覆性影响,早已让多位业内大佬感到恐惧。

最近,似乎全世界都在围剿ChatGPT。

前一阵由马斯克、图灵奖得主Bengio等大佬联名发起的暂停高级AI研发的公开信,现在签名已经上升到9000多人。

紧接着,美国非营利组织人工智能与数字政策中心(CAIDP)也要求联邦贸易委员会(FTC)调查OpenAI是否违反了消费者保护规则,并禁止其进一步发布GPT-4。

而意大利直接全国上下封禁了ChatGPT,只给OpenAI 20天的调整适应期,拿不出合格的方案,就得交最高2000万欧元的罚款。

封杀ChatGPT狂潮席卷全球

有趣的是,自从意大利开了这个头之后,其他一些国家也跃跃欲试,准备要对ChatGPT开刀。

法国和爱尔兰的隐私监管机构,已经联系了他们的意大利同行,希望得到更多关于调查的详细资料。

德国联邦数据保护专员Ulrich Kelber表示:“从原则上讲,德国也有可能采取类似的程序。”

此外,欧盟也提出草案,计划将ChatGPT视为高风险的AI系统进行监管。

而就在昨天(4月5日),美国总统拜登也在白宫与科技顾问开了会,讨论了AI给人类、社会和国家安全带来的风险和机遇。

据路透社报道,在总统科学技术顾问委员会(PCAST)会议中,拜登强调,“在我看来,科技公司有责任确保他们的产品在公开之前是安全的。”

而在被问及AI是否危险时,他说,“还有待观察,有这种可能性。”

拜登表示,强大技术在没有保护措施的情况下会造成哪些危害,在社交媒体上已经很明显了。

“因为缺乏保障措施,我们看到技术影响了人们的心理健康,让他们对自我形象产生了自卑和绝望,这种影响在年轻人中尤为明显。”

他再次呼吁国会通过两党隐私立法,限制科技公司收集的个人数据,禁止针对青少年的广告,并在产品开发中优先考虑健康和安全。

受此消息影响,在拜登召开这次会议之前,AI公司的股价均出现大幅下跌。

ChatGPT概念股C3.ai的股价持续走低,收跌26.34%报24.95美元,市值28亿美元,创该股上市以来最大日内跌幅。

而此前,自微软宣布与OpenAI建立数十亿美元的合作关系以来,C3.ai与AI领域的许多公司一样,已经成为华尔街近期最热门的公司之一,今年以来C3.ai的股价已经上涨了超过130%。

盖茨:暂停AI研发无法“解决挑战”

当地时间4月3日,盖茨接受路透的采访时公开谈论了千名专家签署的公开信,

呼吁暂停人工智能开发不会“解决挑战”,最好是把注意力放在如何最好地利用人工智能的发展上,很难理解在全球范围内暂停AI研发将如何实现。

他继续表示,我不认为要求某个特定群体暂停工作就能解决挑战。显然,这些东西有巨大的好处……我们需要做的是确定棘手的领域。

盖茨是人工智能的坚定支持者。

3月21日,也就是发起联名公开信的前一天,盖茨曾发表了一篇“人工智能时代已经开始”的博客文章。

其中提到了应该利用人工智能来帮助减少世界上一些最严重的不平等现象。

他在博客中盛赞人工智能,“AI时代已经开启,人工智能革命重要程度不亚于手机和互联网的诞生,这是其一生中唯二的革命性技术进步。”

目前为止,微软已经向OpenAI投资了数十亿美元。OpenAI正在为微软必应、Edge、Microsoft 365和其他产品构建AI技术。

在接受采访时,盖茨质疑暂停AI开发的可行性,想知道如何实施。

“任何暂停的细节都会很复杂,难以执行。我不太明白,他们说的哪些人可能停止,世界上每个国家是否都会同意停止,以及为什么要停止,在这个领域会有很多不同的意见。”

GPT-4学会“自我反思”,性能大涨30%

但是,即使全世界都对超级AI如临大敌,想赶紧悬崖勒马,恐怕也为时已晚。

因为,如今的AI,已经学会自我进化了!

有证据表明:GPT-4,正在改进自己!

前段时间,前谷歌大脑研究工程师Eric Jang发现令人疯狂的一点:GPT-4能够以合理的方式批评自己的成果。

与其为大型语言模型(LLM)寻找完美的提示(让我们一步一步思考),不如让LLM评估自己的输出并立即纠正自己的错误。

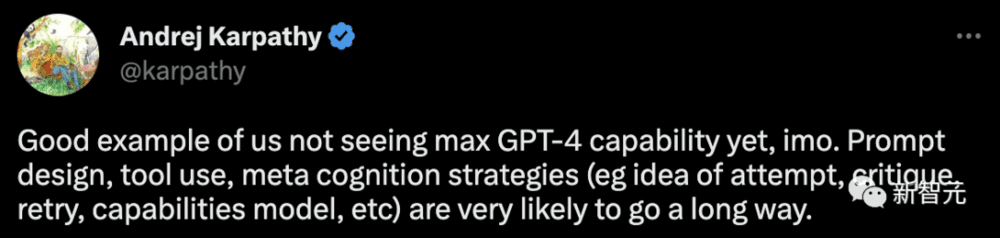

甚至连特斯拉前AI总监,OpenAI研究科学家Andrej Karpathy大赞,这是一个很好的例子,说明我们还没有看到GPT-4的最大能力。

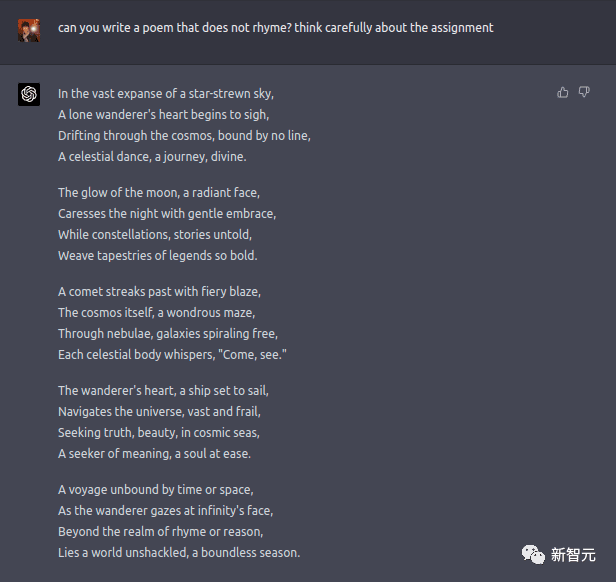

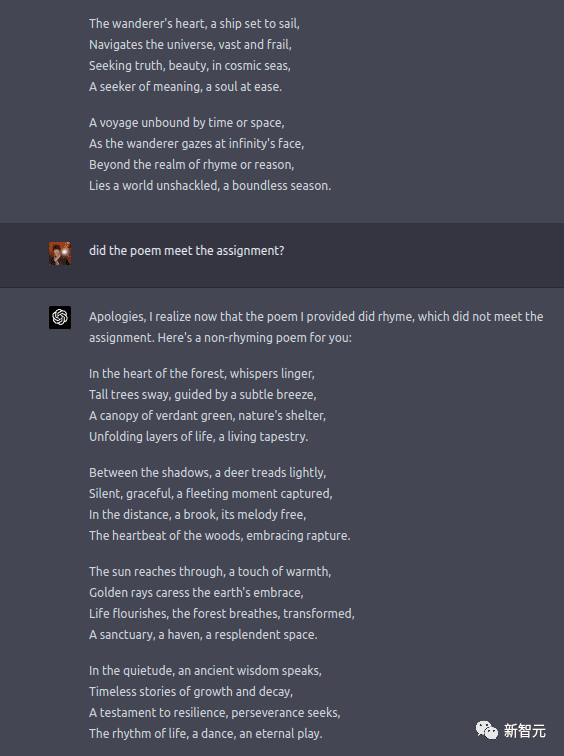

在Eric Jang给出的例子中,曾看到微软研究员发推说GPT-4根本无法写出“不押韵”的诗歌。

然而,当再去询问GPT-4是否完成了任务。这时,它道歉后,生成了一个不押韵的诗!可以说是满分。

这恰恰印证了GPT-4是有“反思”能力的。

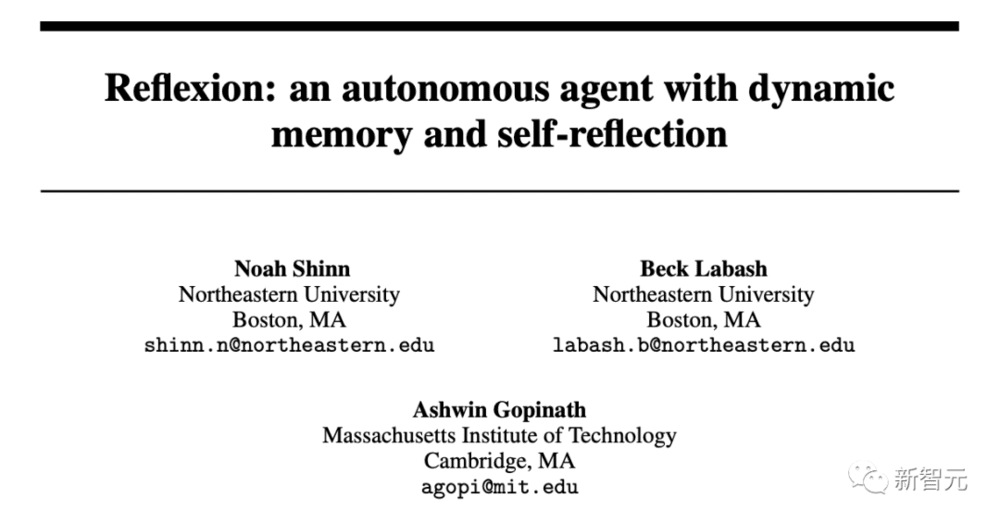

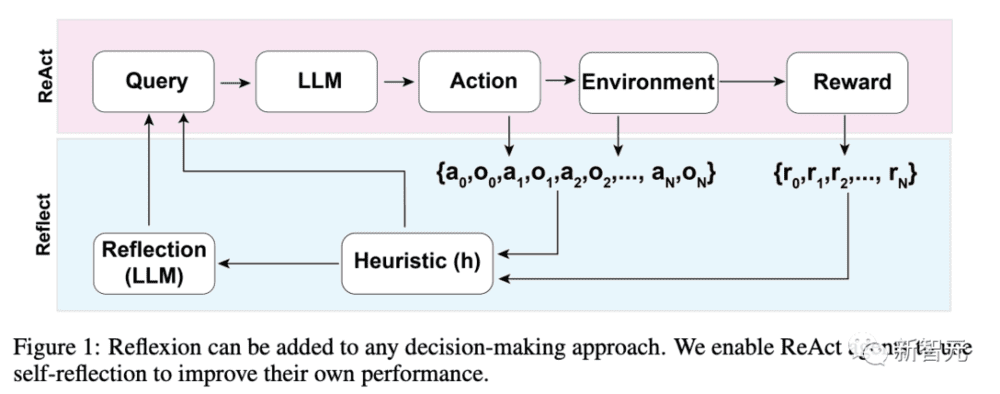

最近,来自美国东北大学、MIT等机构研究者提出了Reflexion。这一方法赋予智能体动态记忆,以及自我反思的能力。

为了验证方法的有效性,研究人员评估了智能体在AlfWorld环境中完成决策任务的能力,以及在HotPotQA环境中完成知识密集型、基于搜索问答任务的能力。

在这两项任务的成功率分别为97%和51%。

有网友便表示,你可以通过要求 GPT-4 反思“你为什么错了?”,并为自己生成一个新的提示,将这个错误原因考虑在内,直到结果正确,从而将GPT-4的性能提高惊人的30%。

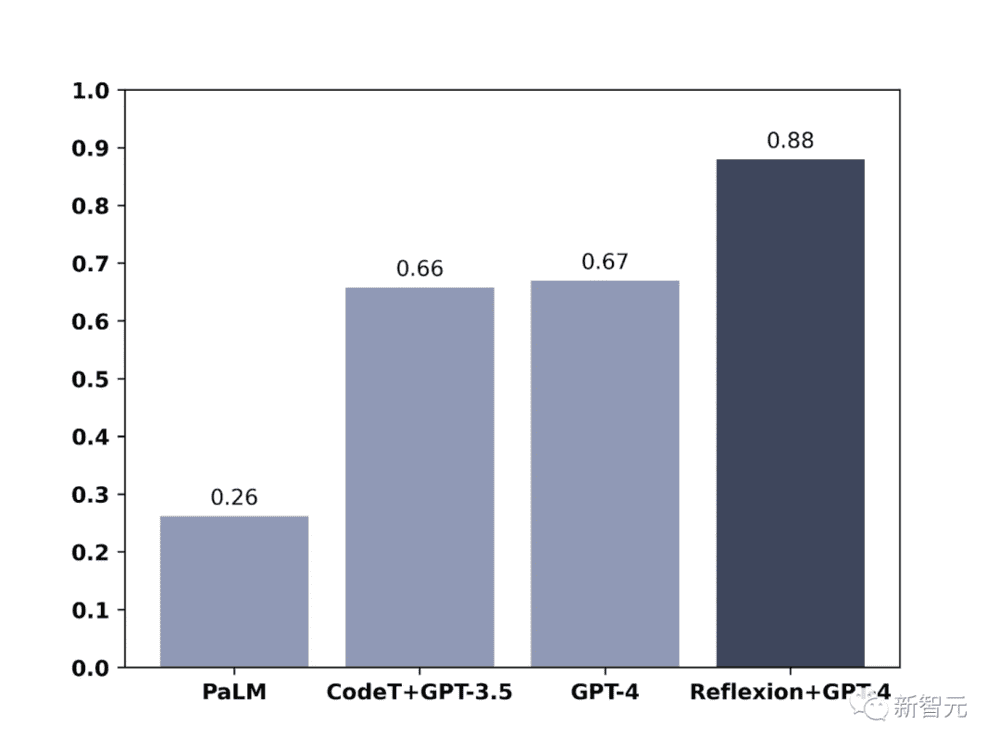

另外,论文指出,在测试模型编写代码的能力时,Reflexion+GPT-4也显著优于常规的GPT-4。

这样看来,就像Eric Jang所说:

我们现在可以考虑一种“后缀提示工程”,而不是巧妙的“前缀提示工程”。这将鼓励LLM在先前生成的解决方案中找到更正和不一致的地方。

ChatGPT长“手”了

如果说GPT-4能够反思,有了大脑,就已经够可怕的了,而现在,ChatGPT还有了“手”,不仅能够用工具,还可以用模型。

在ChatGPT还未上线“插件”功能前,Meta研究人员曾在2月份抛出一篇新论文Toolformer,直接瞄准ChatGPT的“软肋”,让大语言模型自行学会使用工具。

按照Meta的思路,像ChatGPT这样的大语言模型可以缺啥补啥。

比如不会算数,就拿出计算器;需要最新信息,就自己连接搜索引擎搜索;甚至可以直接把想翻译的内容丢给它。

论文一出瞬间爆火,许多AI研究者表示,这篇论文为人们打开了思路,让大语言模型未来可以成为所有事情的起点。

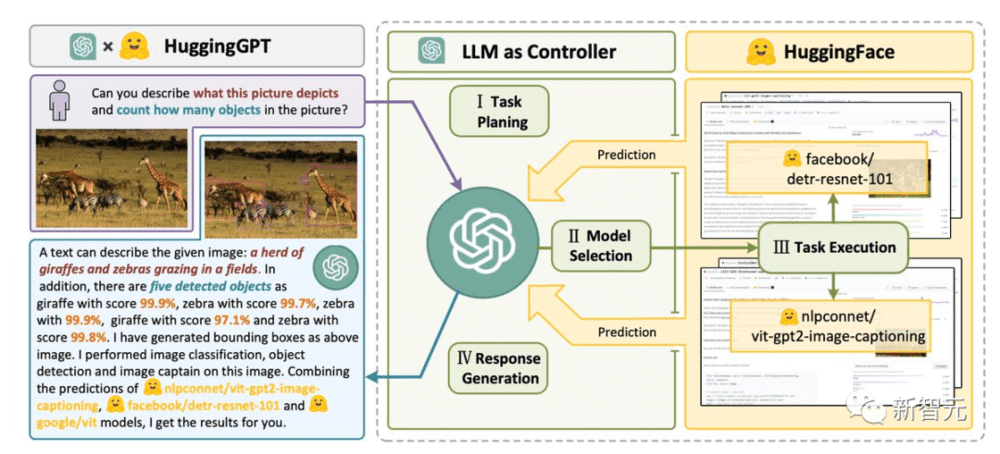

同样,最近浙大和微软亚研院新出的论文“贾维斯”HuggingGPT在业界引起很大的关注。

论文中,研究者提出的HuggingGPT利用ChatGPT作为控制器,连接HuggingFace社区中的各种AI模型,来完成多模态等各种复杂任务。

有网友表示,我强烈怀疑第一个通用人工智能(AGI)的出现将比预期更早。它将依靠“胶水”AI,能够智能地将一系列狭义人工智能和实用工具粘合在一起。

自动写代码

最近,一位开发者做了一个能让GPT-4自动生成代码的项目——Auto-GPT。

甚至还可以执行代码。在后续改进中,Auto-GPT可以使用GPT-4编写代码,并执行Python脚本。这使得它能够递归调试、开发并自我改进……

Auto-GPT让人们更进一步了解到GPT-4强大能力,甚至有网友做了一张梗图:

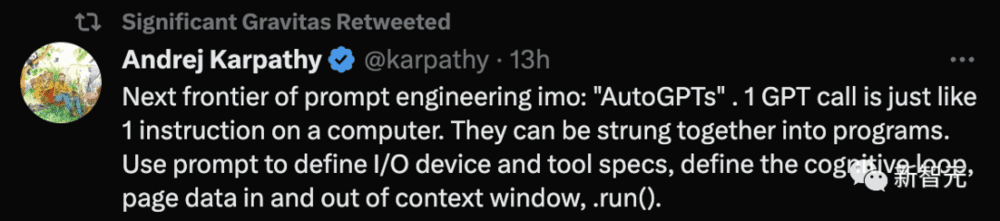

Andrej Karpathy表示,在我看来,提示工程的下一个前沿领域是“AutoGPT”。一个GPT调用就像计算机上的一个指令。它们可以被串联成程序中。使用提示来定义I/O设备和工具规格,定义认知循环,在上下文中分页数据输入和输出,然后运行。

网友:奇点来了

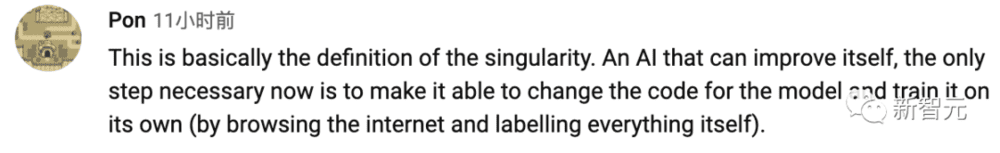

有网友称,这基本上就是奇点的定义。

一个能够自我改进的AI,现在唯一需要的就是使其能够修改模型的代码,并自主训练(通过浏览互联网并自行标记所有内容)。

甚至有的网友认为,技术的飞速进步,让我们已经到了无法回头的地步。到2025年,这个世界将会发生翻天覆地的变化,无论是好还是坏。

从错误中学习,是智力的基础。

如此看来,GPT-4打败自己,想要成为超级AI。

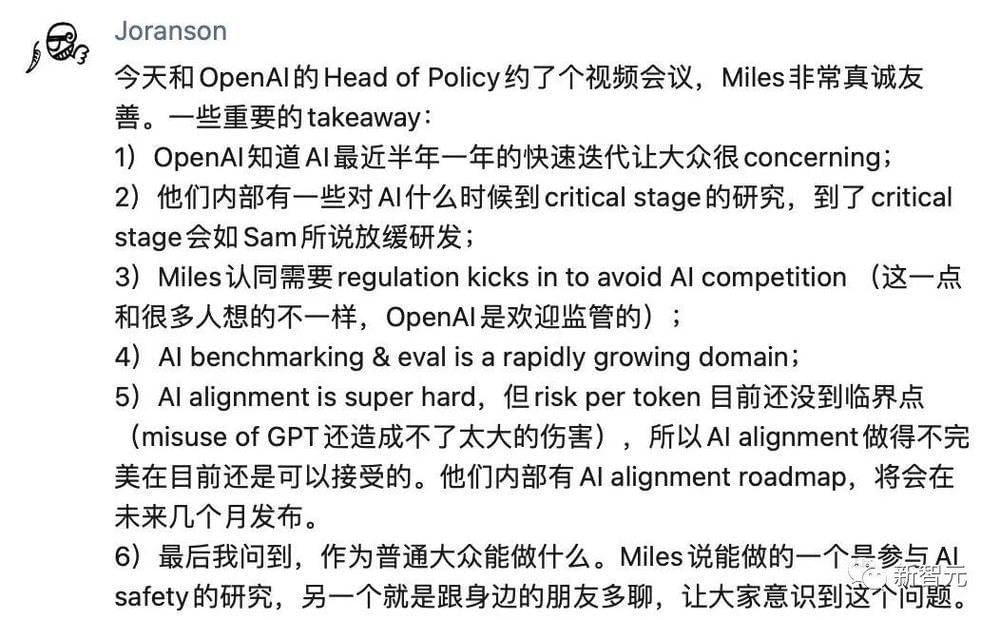

而根据某大佬的最新消息,OpenAI非常清楚,最近他们AI产品的快速迭代引起了极度强烈的反响,而他们也欢迎公众的监督。

其负责人表示,目前risk per token还没到临界点,所以GPT的滥用还造不成太大的伤害。而AI对齐的路线图,即将在几个月内发布。

参考资料

https://www.youtube.com/watch?v=5SgJKZLBrmg

https://www.reuters.com/technology/bill-gates-says-calls-pause-ai-wont-solve-challenges-2023-04-04/

https://www.reuters.com/technology/biden-discuss-risks-ai-tuesday-meeting-with-science-advisers-2023-04-04/

https://www.reuters.com/technology/biden-discuss-risks-ai-tuesday-meeting-with-science-advisers-2023-04-04/

https://www.cnbc.com/2023/04/04/italy-has-banned-chatgpt-heres-what-other-countries-are-doing.html

https://biz.crast.net/bill-gates-weighs-in-on-proposed-ai-pause-wont-solve-challenges/

本文来自微信公众号:新智元 (ID:AI_era),作者:新智元编辑部