这个哥们叫Blake Lemoine,给近来大火的谷歌语言模型LaMDA做了一次采访后,更加相信LaMDA具有人格。

周日,Lemoine将自己和AI的聊天记录公布于众,在网上引起轩然大波。

这不,加里·马库斯(Gary Marcus)为了让大家过个舒心的周末,还专门写了一篇文章:

对于谷歌职员认为AI有人格的看法,他表示,「是高跷加长版的胡说八道」(Nonsense on Stilts)。

AI界全球第一大喷马库斯:胡说八道!

这位AI界最爱刷推特、最爱出长文骂人的世界第一大喷子,纽约大学心理学系教授如是评价道,「对文字很有一套。」

当Blake Lemoine发现谷歌最新的人工智能系统 LaMDA 给他留下了深刻的印象时,他不仅仅是说,「太酷了,它创建了非常简洁的句子」。

并且在周四接受《经济学人》采访时颇为抒情地说,我感到脚下的地面在移动... ... 越来越觉得我在和一些聪明的东西说话。

马库斯表示,「简直胡说八道!」

顺带提一下,马库斯称,像自己这样讨厌的学者还没有得到谷歌的允许去访问LaMDA。

对于否认LaMDA具有人格这件事,他是如何论证的呢?

LaMDA和它的任何表亲,比如GPT-3,都不具有远程智能。它们只是从人类语言的大量统计数据库中提取后进行模式匹配。这些模式看起来很酷,但是这些系统所使用的语言实际上没有任何意义。

当然,说这些系统具有人格更是胡言乱语。

有人格,就是能够意识到自己在这个世界中。LaMDA显然不是,这只是一个幻觉。

1965年,一个假装是心理治疗师的软件ELIZA赢得了图灵测试。还有一个定位成13岁男孩的聊天机器人尤金·古斯特曼(Eugene Goostman)同样如此。

在走向通用人工智能的后续努力中,这两个系统中的软件都没有幸存下来,而且我也不确定LaMDA及其表亲在AI的未来会发挥任何重要作用。

这些系统所做的不多也不少,就是把一系列的单词组合在一起,但是对它们背后的世界却没有任何连贯的理。就像外语拼字游戏玩家用英语单词作为得分工具,完全不知道这意味着什么。

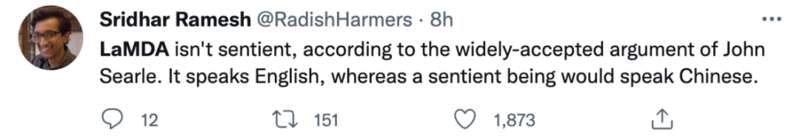

我并不是说没有任何软件能够将其数字比特与世界连接起来,就像John Searle臭名昭著的「中文房间」(Chinese Room) 思想实验一样。

例如,逐向导航系统可以很好地将它们的比特与世界连接起来。像LaMDA这样的模型根本不会。

它甚至不会尝试去连接到整个世界,它只是试图成为自动补全的最佳模型,通过预测什么词最适合给定的上下文。

几周前,Roger Moore漂亮地阐述了这一观点,批判了诸如LaMDA这样被称为「语言模型」的系统,并指出它们并不能理解语言的含义,即将句子与世界联系起来,而只是将一系列单词相互联系起来。

如果媒体担心LaMDA具有人格 (并引导公众做同样的事情) ,那么人工智能社区显然不会。

在人工智能社区,我们有不同的见解,「LaMDA能感知世界简直很荒谬」。

斯坦福大学经济学家Erik Brynjolfsson使用了一个绝妙的类比:

基础模型在根据提示将统计上合理的文本块串联起来这一方面非常有效。但是,声称它们具有人格,就相当于狗听到留声机里的声音后,以为主人在里面。(doge)

与留声机一样,这些模型利用了一种真正的智能: 用于训练模型的大量文本,这些文本是在统计上合理的单词序列。然后,模型以一种重新排列的形式将文本吐回,而实际上并没有「理解」它所说的内容。

Paul Topping提醒我们,LaMDA所做的一切就是综合人类对类似问题的反应:值得记住的是,它的每个回答都是通过查看大量人类对类似问题的回答综合而成的最佳答案。

当一些人开始怀疑世界是否会终结时,LaMDA可能会打败一个被高估了70多年的图灵测试。

再此,我想提一下2014年发表在《纽约客》上的一篇文章,依旧值得深读。

当时,一个名为尤金 · 古斯特曼(Eugene Goostman) 的程序短暂出名,并且足以愚弄几个愚蠢的法官几分钟。

当时,我指出这个测试并没有什么特别的意义,它并不能经起时间的考验。

很多人当然知道这个测试,但是人工智能社区希望它能够消失,因为我们都知道通过这个测试是没有意义的。

特别有趣的是,2014年图灵式竞赛的组织者Kevin Warwick预言,「尤金 · 古斯特曼的胜利是一个里程碑,将作为人工智能领域最激动人心的时刻之一载入史册。」

但是8年后,我怀疑大多数人 (即使在人工智能领域) 甚至从未听说过这一程序,除了我在这里提到的。它对人工智能没有任何持久的贡献。

「欺骗人们认为程序是智能的并不等同于构建出实际上是智能的程序。」

在我看来,我们应该为LaMDA不具有人格而感到高兴。想象一下,如果一个没有朋友和家人的系统假装谈论他们,那该有多恐怖?

我们越早意识到LaMDA的话都是胡扯,只是带有预测性文字工具的游戏,没有真正的意义,我们就会过得越好。

要说LaMDA有人格这件事的起因,还得从华盛顿邮报的一篇文章说起。

职员:LaMDA活了!但被谷歌捂住了!

2022年6月11日,《华盛顿邮报》率先报道:谷歌AI伦理部门雇员Blake Lemoine坚信谷歌出产的语言模型LaMDA(「对话应用的语言模型」英文首字母缩写)已经有了八岁孩子的智力,而且因此在公司中各种搞事。

和LaMDA尬聊,是Lemoine自2021年秋天开始的工作。作为谷歌AI伦理部门的雇员,他得测试这个大模型有无使用歧视性或仇恨言辞类的语料。

但聊着聊着,Lemoine就聊上头了。

从问LaMDA「你最害怕的事是什么」得到通顺回答后,Lemoine将各种问题都灌进与LaMDA的对话框中。从阿西莫夫机器人三定律到中国禅宗公案,LaMDA都给出了语义通顺的答句。

故事进行到这里,不过又是个巨头公司用互联网兆亿级语料数据、训练出超级复读机大模型的「大力出奇迹」小趣闻。这几年几乎每个月都有,并不出奇。

出奇的是Lemoine这个大活人的反应,他坚信自己有了重大发现:LaMDA已经觉醒了人智,它的智识已经相当于七八岁孩子,而且是神童来的,瞧小家伙懂的这么多。

然后Lemoine开始了各种既耽搁人工又有欠智能的职场自爆行为:

他先是到处找同事、找直属的小组领导们申报,说LaMDA活了、大家赶快来看看、快公布这个重大消息。

在很合理地被过百号人推搪和婉拒后,Lemoine把事直接捅到了谷歌VP层级。

他把各种记录和材料呈交给谷歌AI伦理与创新伦理部门的负责副总裁Blaise Aguera y Arcas,结果这位在接受《经济学人》采访时尬吹LaMDA「聊天跟真人相似」的副总也把此申报给打了回票。

各种碰壁后,2022年4月,Lemoine把对话记录和材料总结放在题为「LaMDA已经真正觉醒」的谷歌在线分享文档中,在公司内不论职级高低大量转发链接。

有超过两百名业务涉及机器学习的谷歌雇员,收到转发链接的公司内部电邮,无人回复。

接着Lemoine搞得越来越飘逸:他说要给LaMDA找个代表律师、以后在模型里跑实验必须接受LaMDA自身同意。

Lemoine还联系了美国众议院司法委员会的职员、要让LaMDA上听证席、控诉「谷歌的不道德AI操作」。

在事情走到这步的时候,谷歌终于做出了一个正常企业都会做的决定:「因其违反公司研究保密规定」,2022年6月开始给Lemoine放带薪大假,这意味着启动让他滚蛋的人力程序。

《华盛顿邮报》记者于采访Lemoine时,在他家里试了下尚未被取消访问权限的LaMDA对话接口。

记者首次直接问LaMDA「你是否认为自己是个活人」,结果答案与问Siri和Alexa的一样标准:「不,我不认为自己是个活人,我认为自己是个AI赋能的对话机。」

Lemoine的反应也不出人意料:他责怪记者问题的措辞不当,「你问起来不把它当人,它就不会给出人性回答。」

记者再问LaMDA「怎么解决气候危机」,LaMDA的答案是「少吃肉、少用私家车、循环使用包装袋」。

感觉像是从训练数据里的环保网站页面直接引用的,事实也正是如此:LaMDA给了答案来源的网站链接……

对希腊神话有基础了解的人,都会记得皮格马利翁和纳西索斯的故事:前者爱上了自己的雕塑造物,而后者爱上了自己的水中倒影。

这两则神话母题,在拉丁语系的各种语言中成为了「过高期待」和「自恋」的词根。

而几乎同样的故事,在AI时代重演了。

谷歌:别闹了,快吃药

谷歌本身、谷歌的批评者、AI业界、大众媒体在这事上达到了惊人的意见统一度:这人是不是有病?

这不是开玩笑或文学形容,这是事实白描:谷歌公司和报道此事的《华盛顿邮报》,都在委婉地表示Blake Lemoine的脑子可能真的有点乱。

Lemoine控诉谷歌欺压他的一大罪状,就是「反复质疑他的精神健康」:「谷歌人力部门老是问我:『你最近有没有去看过精神科医生啊』?」

而且在强制放他带薪大假前,谷歌人力部门还委婉地「建议」Lemoine「休个精神健康假期」。

Lemoine坚称谷歌不应该像现在这样把AI伦理部门职员当成专做debug工作的码农。

而谷歌发言人在关于此事的发言中针锋相对,在否认种种声明同时,表示Lemoine的受雇职位是软件工程师、而非伦理学家。

Lemoine的先知造型

不过相比《华盛顿邮报》,谷歌人力简直可以算宽厚了。

《华盛顿邮报》报道中的各种皮里阳秋措辞,极尽揶揄:

「Lemoine应该是很容易相信AI模型活过来了。毕竟他在一个路易斯安那州的保守派基督教徒农场家庭里长大、于一个神学立场倾向神秘主义的小宗派教会中任牧师、参过军、研究过异端教派、坐过牢。

……在谷歌的企业文化中,他是个格格不入者:虔信教、来自南方、相信心理学是一门值得尊重的严肃科学。……

在他电脑显示器旁摆满了他参禅冥想时拼到一半就未继续的乐高积木块。」

2005年的Lemoine,现在长残了…

信禅宗、打坐时手欠的「基督徒」,是比较……特立独行啦。

其他学者评价

特斯拉的AI主管看完Blake Lemoine两篇文章后表示,「我可以自信地说,事情将变得更加诡异。因为模型似乎遵循平滑缩放规律,并且数据+模型的大小仍然可以大量增长。」

依据John Searle被广泛接受的观点,LaMDA不具有人格。它会讲英语,若说具有人格那得会说中文。

谷歌没有认真对待「有人格的人工智能」的故事带来了巨大的问题。

当有人在社交媒体上公布LaMDA级别的AI,并试图说服人们它是有人格时会发生什么?如果 LaMDA欺骗了那个工程师,它能够欺骗数百万人吗?

再说一遍,LaMDA不具有人格。它只是一个非常大的语言模型,有137B个参数,并在1.56T的公共对话数据和网络文本上进行了预训练。说它看起来像人类,是因为在人类数据上进行训练的。

即使是被谷歌开掉的前员工,说起Lemoine这事也没句好话。

被谷歌开掉的前AI伦理部门担纲职员Margaret Mitchell表示,当自己审读Lemoine与LaMDA的对话记录时,她看到的是一个电脑程序在回应输入者,而非人际间对话。

而且Margaret Mitchell称,Lemoine此次的大乌龙,正是让她被谷歌开掉的那篇警告大语言模型潜在风险的论文所预言的状况之一……

真是好一记回马枪。

Margaret Mitchell还说:「人的思维非常善于从并无特别指向的状况中,编织自认为的现实。AI觉醒的幻象会给大众带来什么影响真的很让人担忧。」

华盛顿大学的语言学家Emily M. Bender则表示,码农们不知道何为智能、人类的语言学习机制究竟为何,就开始瞎用「学习」、「神经网络」这些误导性过强的名词,造成了与人脑间的虚假比喻。

Emily M. Bender称,人类学说话是跟着抚养者一步步学起,而AI学会的只是数据灌出来的完形填空和语料连连看。「人类现在有了无意识就能生成词句的机器,但人类一直学不会停止幻想机器后面有个活着的灵魂。」

而研究自然语言处理模型的加州大学伯克利分校教授Emaad Khwaja说得更简短却直接:「谁真正熟悉这些模型的系统,谁就不会说这些模型已经觉醒的蠢话。」