19岁的“罗小猫猫子”是一名短视频平台的生活穿搭类博主,日常粉丝量50多万,主页现存的30多条视频,基本上都点赞过万。

在视频中,她和别的网红博主一样,经常分享自己的妆容和穿搭,偶尔拍摄一些生活碎片,也会跟风拍一些画面沙雕的搞笑场面。

10月14日,她在短视频平台上传了一条视频,并且配文“这大概是最后一条视频了吧,谢谢你们一路陪伴”。

画面里的她虽然化了妆,又有滤镜的加持,但气色看起来还是很差;表现得也不像往常视频中那样活泼开朗,说起话来有气无力的,像是大病初愈的模样。

在视频中,她说自己得抑郁症很久了,并且因为得病还住过两个多月的院,虽然平时视频中她都是很开心的样子,但那些只是为了给粉丝看的。她说自己“不是你们所谓的那种假的抑郁症”,而是真的撑不下去了。

在最后,她说,“想知道原因的话,就来小号看我的直播吧。放心,这一条直播一定不是带货或广告。”

这条看起来像在告别的视频发出以后,收到了不少的评论。有人感到诧异,因为她平时的视频中完全看不出抑郁症的痕迹;有人感到惋惜,作为粉丝给她加油打气;还有人认为她是在故弄玄虚,毕竟很多网红为了吸引流量,什么事情都做得出来,没准又是一次炒作。

于是,不少网友都来到了她的直播间,想要一探究竟。却没想到在直播过程中,她掏出了一瓶农药,说自己想要自杀,还给了农药瓶子一个特写。

直播过程中,她似乎在等什么人,不止一次强调“他还是没有来”,并且对着镜头哭泣。

直播间里有人开始着急了,担心她的状态,怕她冲动,一直劝她看开点儿;但也有人一直在起哄架秧子,让她“要喝快喝”,甚至还发出了“瓶子里不会是尿吧”的嘲讽。

受到刺激的“罗小小猫子”在网友的怂恿下,把农药兑进了饮料里,然后一饮而尽,还把瓶子展示给大家看。

没多久,她就感到了身体的不适。接下来,直播间也被封禁了。

当晚,就有不少社交平台传出了“罗小猫猫子疑似自杀”的消息。

第二天下午,一名自称是“罗小猫猫子”闺蜜的网友,在网上发文,称“罗小猫猫子”正在抢救,并呼吁大家寻找肺源。当晚,她又告诉大家,“罗小猫猫子”已经抢救无效去世了。

很快,这件事就传开了,关于“罗小猫猫子”为什么要喝农药自杀的猜测也越来越多,大家普遍认为她是“被情所困”:

有网友发现,“罗小猫猫子”过去发布的照片和视频里,可以隐约看到手腕上的伤痕,像是自残或者自杀的痕迹,这是她生病的证明;她和前男友分手后,不少网友对她羞辱谩骂,进行人身攻击,这可能是她抑郁的原因。

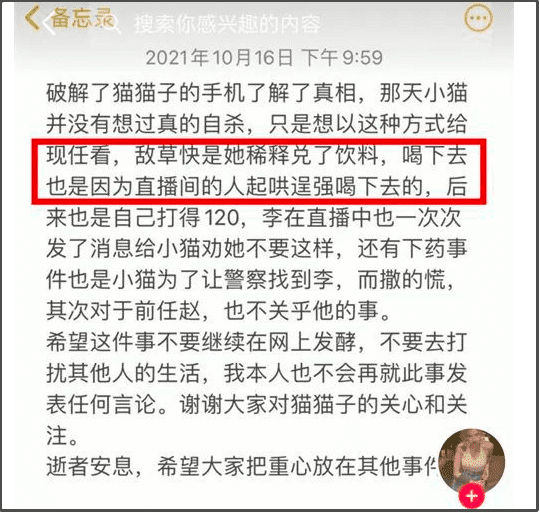

而后,她的闺蜜再次发文,告诉大家,其实“罗小猫猫子”并不是真的想自杀,只是想引起男朋友的重视;农药中兑了饮料,喝下去纯粹是因为网友起哄;她的自杀和前男友、现男友都没有关系。

“罗小猫猫子”的家人在接受媒体采访时,也表示会追究起哄者的责任。

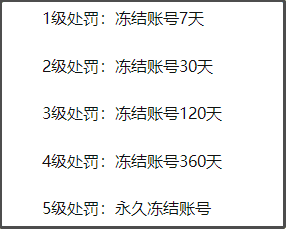

根据网上目前能找到的直播画面显示的内容来看,当时起哄最厉害的那位网友,因为网暴言论,已经被平台封号处理了。

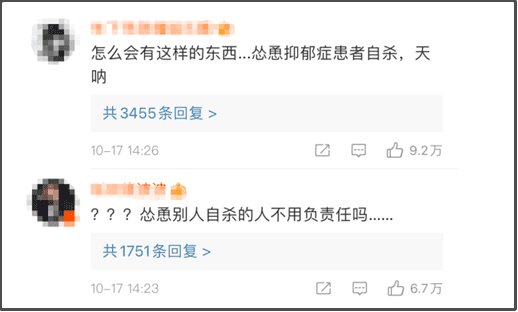

网友们在对一条鲜活的生命就这样逝去表示惋惜的同时,也对起哄者是否需要承担法律责任展开了探讨。

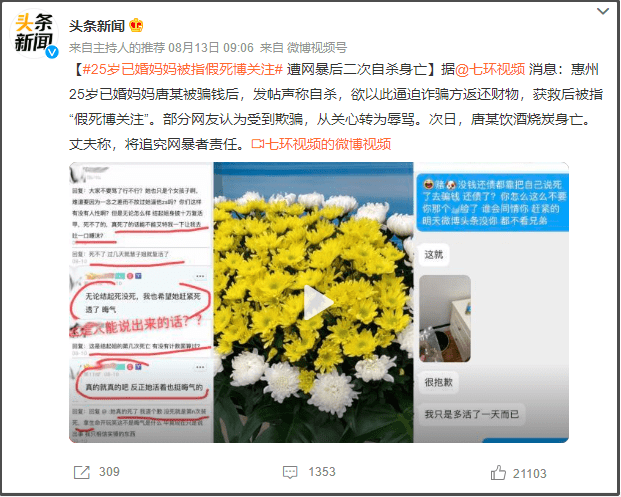

在他人试图自杀时,不但不进行劝阻,反而怂恿、起哄的案例,“罗小猫猫子”并不是第一个。

最令人印象深刻的,应该是2018年,一名19岁女孩因为抑郁症,决定跳楼自杀。她在楼顶犹豫不决时,因为围观的人群一直起哄,所以在纠结了4小时后还是选择了纵身一跃,结束自己的生命。

怂恿她的那些人有的在朋友圈直播,有的在下面喊着“快点跳”,还有的在她选择跳下来的时候,甚至鼓起了掌……只有一直想要帮助她、救她下来的消防员,在楼顶哭出了声。

根据事后的通报,警方将“起哄的和对生命不尊重的”一些人处以行政拘留。这打破了部分人认为只能从道德进行谴责的认知,更是警示所有人,自己的行为可能受到法律的严惩。

然而实际上,《刑法》中并没有专门针对教唆、怂恿他人结束生命而设立的罪名。

《刑法》中有一个概念,叫做“间接正犯”,指的是行为人自己有犯罪意图,然后利用无责任能力人或无犯罪意图人来实施犯罪行为,来达到自己的目的。

比如教唆未成年人盗窃,或者利用精神病人殴打他人,就属于这个范畴;或者是甲为了伤害乙,于是把毒药通过不知情的人传递给了乙,也属于这个范畴。

怂恿他人自杀的这种情况,“起哄者”成为间接正犯,一定是存在胁迫的情况,比如影视剧中经常出现的“你不死你的家人就得替你死”的场面;另一种更为苛刻,需要死者因精神疾病失去了自主判断的能力。

总而言之,需要死者在被“教唆、怂恿”前,并没有自杀的念头。显然,已经站在楼顶的人不符合这个条件。

所以,围观跳楼起哄的人被处以行政拘留,其实主要是因为妨碍救援,还有传播视频,构成了治安违法。

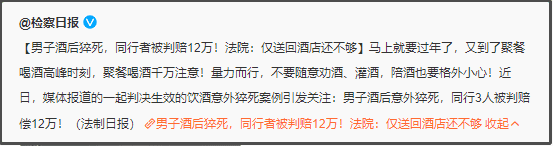

有人拿劝酒致死需要承担法律责任的劝酒者,来类比自杀事件中的起哄者,其实也是不恰当的。

在劝酒致死的案例中,分为民事责任和刑事责任两种,根据情节的轻重以及是否有主观故意情况的程度来判定:

比如通过言语劝酒,当场致死的,行为人如果已知死者有身体疾病不能喝酒,那就要负刑事责任,不知道的话负民事责任;

比如饮酒后酒驾的,如果不阻止,需要负民事责任,不但不阻止甚至还教唆鼓励的,需要负刑事责任;

另外,需要负责的不光是劝酒人本身,所有共同饮酒的人都要承担法律责任。《侵权责任法》中规定,饮酒本身是一项具有危险性的活动,所以共同饮酒人之间存在相互提醒、劝告少饮酒并且阻止过量饮酒人的注意义务。

在网络直播间起哄怂恿他人自杀的情况,和以上两种都有所不同。

劝酒致死需要承担法律责任,是建立在饮酒本身是一件有危险性的事情的基础上的。自杀本身具有危险性自然毋庸置疑,但直播没有。在网络上,作为直播间的观众,参与的本身是“直播”,而不是“自杀”。

同样,这些“起哄者”虽然是现实中跳楼的围观者的一种网络延续,但农药不是网友准备的,也不是网友灌进去的。主播自己具有行为能力的情况下,无法证明观众的言论是否对主播具有直接影响。

由于作秀、吸引流量的行为过多,因此观众无法准确判断自杀的真实与否,也就无法断定观众究竟是“推波助澜”,还是“观看表演”。

当然,在这场悲剧中,有一方的责任是毋庸置疑的,那就是直播平台。

根据文化和旅游部发布的《网络表演经纪机构管理办法》,网络表演经纪机构应当加强对签约网络表演者的约束,当发现签约网络表演者所提供的网络表演含有违法违规内容时,应要求网络表演者停止网络表演活动。

《互联网直播服务管理规定》第九条规定,互联网直播服务提供者以及互联网直播服务使用者不得利用互联网直播服务从事危害国家安全、破坏社会稳定、扰乱社会秩序、侵犯他人合法权益、传播淫秽色情等法律法规禁止的活动,不得利用互联网直播服务制作、复制、发布、传播法律法规禁止的信息内容。

也就是说,平台不得直播自杀等违背公序良俗的内容,否则会被《网络安全法》处罚。

然而,由于直播本身具有不确定性和不可控性,平台无法直接干预主播的言行,只能通过审核后来判断处理。

因此,平台方能否通过技术手段来实现自杀等违规违法内容的管控,并及时处理,成为能否避免造成重大恶劣影响的关键。

众所周知,目前互联网上的内容信息,主要就是两大类,一是文字,二是图片。审核简单来说就是两步走,先机器,后人工。机器用来处理一些简单粗暴,明显违规的内容;人工来判断可能违规,也可能没有,比较模糊不好定义的内容。

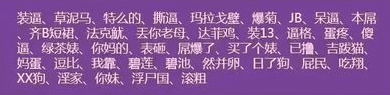

先说文字,文字的逻辑和处理方式相对图片来说简单一些,靠敏感词就可以触发。

网络上有一套较为通用的敏感词词库,各大公司会在这个词库的基础上,再根据平台业务的不同进行调整,并在使用过程中根据遇到的问题,不断进行扩张、补充。

扩张和补充的依据很简单,只要一个词经常出现在负面场景里,并且对这种负面起到了关键作用,就可以视为敏感。

一般来说,敏感词分为几个等级,有绝对不能出现的辱骂、侮辱性词语,或者涉及暴力、淫秽色情的内容,也有需要视情况和场合而决定的,比如劣迹艺人、热点新闻。

当检测到内容中有敏感词后,会根据敏感词的等级和性质进行处理,比如十分严重的就会被直接封号,比较严重的会删除,没有太大影响的会屏蔽,可能敏感的会交由人工审核。

不扩张不行

骂人的花样实在太多了

日常生活中,大家最常见的也是最明显的敏感词处理,当属晋江的胡乱屏蔽一通,并且闹出了不少笑话,引发网友们的无数吐槽。

这就是机器简单处理过后的结果,因为机器无法按照人的思想来分析句意,一检测到有问题的内容,直接就会屏蔽。

人工审核的过程比较简单,看就完事儿了,看完了大家一投票,有问题就删,没问题就恢复。

在这种情况下,虽然人工审核断定没有问题,但账号会被做一个标记,也就是风险标识。这个标识可以“升级”,如果经常触发,等级就会越来越高,直到有一天直接封号。

这种风险等级的存在,是用来预防有的人天天打擦边球的情况,常在河边走,总有一天得湿鞋。

如果在触发了一次后,接下来账号并没有别的异常,是可以降低等级,消除标识并且恢复正常的。

不过,这些账号降级很慢,但升级很快。比如从“0”到“1”可能需要两天,从“1”到“2”只需要一天,然而从“1”回到“0”,可能需要一个礼拜,非常影响账号流量。

因此,一个正常账户的使用者,为了不影响使用,经常会想方设法避开敏感词,用标点符号、拼音、偏旁、错别字等,来降低、规避风险。

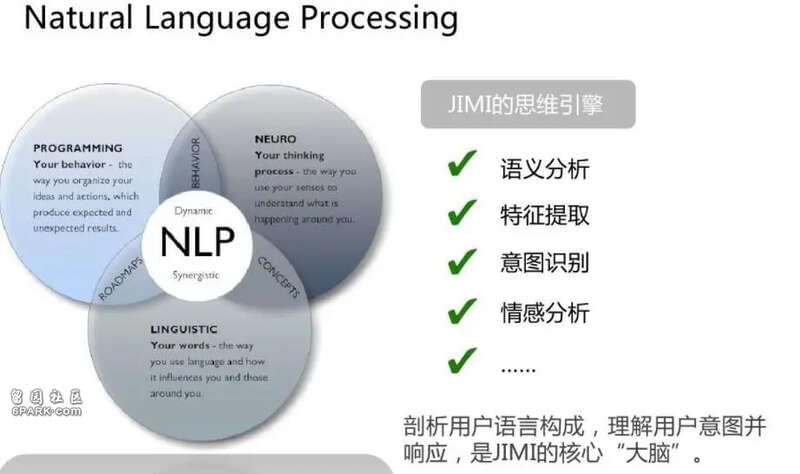

不过,这种做法并非万无一失。首先是因为敏感词库在不断扩充,其次是有自然语言处理,也就是NLP技术。它是一门复杂的科学,融语言学、计算机科学、数学于一体,解释起来不是一两句话就能够说清楚的。

但NLP技术说白了,就是让计算机通过模拟人类对自然语言的理解,来处理人们的日常语言文字。

通过它的应用,计算机可以做到通过提取一段话、一个句子中的关键词信息,进行分析、比对,最终判断真正的词义,消除偏旁、符号、乱码等带来的影响。

不过,鉴于汉字的博大精深,这项技术在应用于敏感词审查时,很难百发百中。

相对于鉴别文字的敏感词库来说,识别一张图片的工作量要大得多。

首先,要把这张图像按照像素点拆开,然后通过矩阵的框选标注,可以识别出图片的特征;识别出这种特征后,再与图库中的图片的特征进行比对,然后识别出图片的内容到底是什么。

说白了,就是一个点一个点去比对分析,最后得出结论。

不过,图片是千变万化的,内容更是多种多样。所以,在能成功识别一张图片之前,需要从成千上万张已经确定内容的图片中,提取它们的共同特征。

虽然在实际应用中,可以通过卷积和池化的过程降低工作量,然而图片数量还是巨大的。想要识别出一张猫咪的图片,可能需要从几万张几十万张甚至上百万张形态各异的猫咪图片里,提取出眼睛、鼻子、耳朵、嘴巴的特征,总结出一套成熟的模型规律,才能正确识别。

目前,网络上的图片审核,大多集中在色情、低俗内容上。想要成功识别一张小黄图,需要先集中分析提取大量黄色图片的特征,然后再进行对比,看是否命中。

因此,许多淫秽色情产业的账号,会把图片藏在一张特别长,难以滑到底的图片的最下面,比如风景照,美食照等等,这样可以减少命中特征的概率。

命中的特征越多,图片的敏感程度就越高,到达一定程度的时候,就会被封号处理。如果命中的特征比较少,则会进入人工审核步骤。

当然,就算图库丰富,也可能有失误的时候,比如错把人手当黄色图片,因为满屏幕都是肤色,手指姿态婀娜,所以命中特征过多。

视频审核可以认为是二者的结合,由文字与图像两者组成,通过在视频中进行抽帧,然后进行审核。视频在上传前,就已经通过审核才可以发出,因此相对来说,内容是可控的。

但直播不同,直播是实时产生内容的,只有主播在明确过界的时候,才能判断出违规。

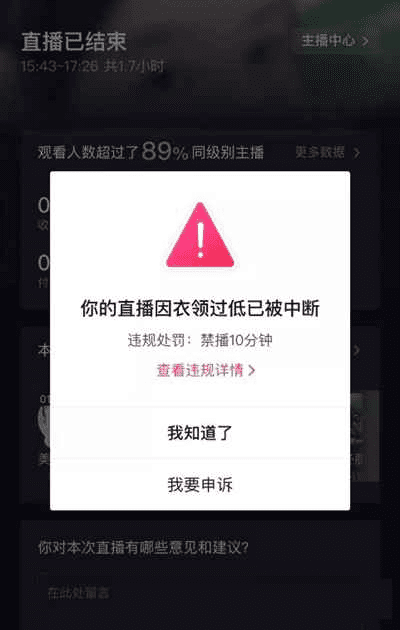

比如有不少人,在直播间听到主播说脏话,上一秒还在夸夸其谈,下一秒直播间的屏幕就黑了。

又或者发现主播衣衫不整,动作不当,立刻就会中断。

但是,自杀与破口大骂、直播低俗内容又有所不同。因为无论是骂街还是搞黄色,都有明显的图片、文字特征,而自杀没有,除非是在屏幕前割腕或者上吊。

喝药这一个动作,很难识别出主播的意图,因为特征不够明确。

因此,想要通过内容审核机制,来避免这种直播内容,其实难度非常大。

除了抽帧外,直播间还有超级管理员,也就是人工巡检。他们可以随时进入自己管理的直播间,随时对直播间进行警告、关停处理。

但是自杀这种行为,管理员在进行干预前,还要先判断主播究竟是在演戏炒作,还是真的轻生,这也需要花费时间。

不过,虽然平台很难单纯靠技术规避风险,但平台本身对高度危险的视频就有审查和监管的义务,并且需要及时干预,断开直播,屏蔽评论。

当平台能力有限时,也可以发动网友的力量,让网友起到一定的监督作用。比如快捷举报功能,减少举报流程,尽快得到响应。

同时,为了减少误报、错报,以及恶意反馈,还要对用户进行身份认证以及考核,以免滥用权力,导致真正需要被救助的人被淹没在庞大的信息流中。

当然,话说回来,就算“只”是以自杀为噱头进行作秀、引流,也应该被及时处理才对。

毕竟类似的事件一再发生,无论真假,最终都有可能是一场悲剧。

参考资料:

科学百科:自然语言处理(NLP)

人民网研究院:网页敏感关键词匹配技术研究

一颗西蓝花:从算法到产品:NLP技术的应用演变

Jimmy:AI入门:卷积神经网络