今天,OpenAI 联合创始人、首席科学家 Ilya Sutskever 发推宣告离职。

在 OpenAI 工作近 10 年后,我做出了离开的决定。OpenAI 的发展轨迹可以称得上是奇迹,我相信 OpenAI 会在 Sam Altman、Greg Brockman 和 Mira Murati 的领导下,以及 Jakub Pachocki 的出色研究领导下构建安全有益的 AGI。

能够一起工作是一种荣幸,我会非常想念大家。这么久了,感谢你们大家所做的一切。我对接下来发生的事情感到兴奋,接下来从事的这个项目对我来说非常有意义,我会在适当的时候分享细节。

Ilya Sutskever 还分享了与 Sam Altman、Greg Brockman 和 Mira Murati 等人的合照。

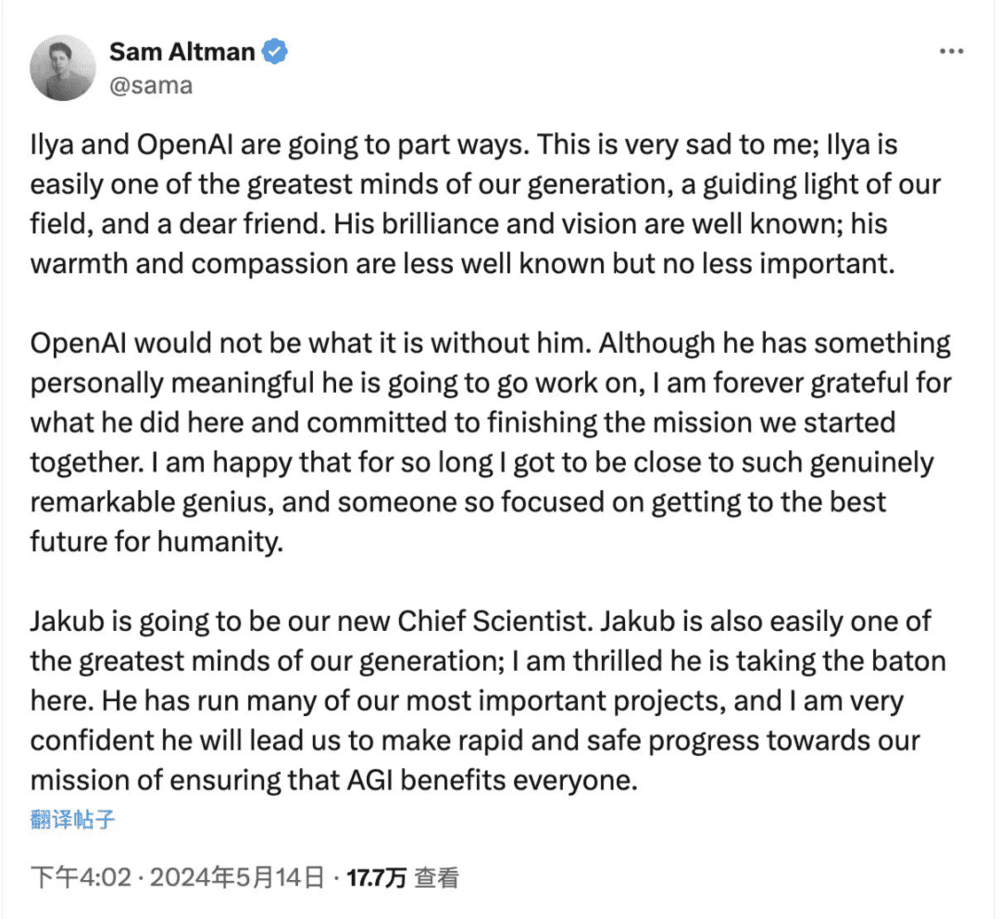

OpenAI CEO 奥特曼在推特上发文表示,Ilya 与 OpenAI 的分道扬镳令人非常难过。

Ilya 无疑是我们这一代最伟大的思想家之一,是我们领域的指路明灯,也是我的挚友。他的才华和远见众所周知;他的温暖和同情心不那么广为人知,但同样重要。

没有他,OpenAI 就不会是今天的样子。尽管他有一件对他个人意义重大的事情要去做,但我永远感激他在这里所做的一切,并致力于完成我们一起开始的使命。我很高兴在这么长时间里,我能如此接近这样一个真正非凡的天才,以及一个如此专注于为人类带来最佳未来的人。

Jakub Pachocki 将成为我们的新首席科学家。Jakub 同样无疑是我们这一代最伟大的思想家之一;我很高兴他将在这里接过接力棒。他负责过我们许多最重要的项目,我非常相信他将带领我们快速而安全地朝着确保通用人工智能(AGI)惠及所有人的使命前进。

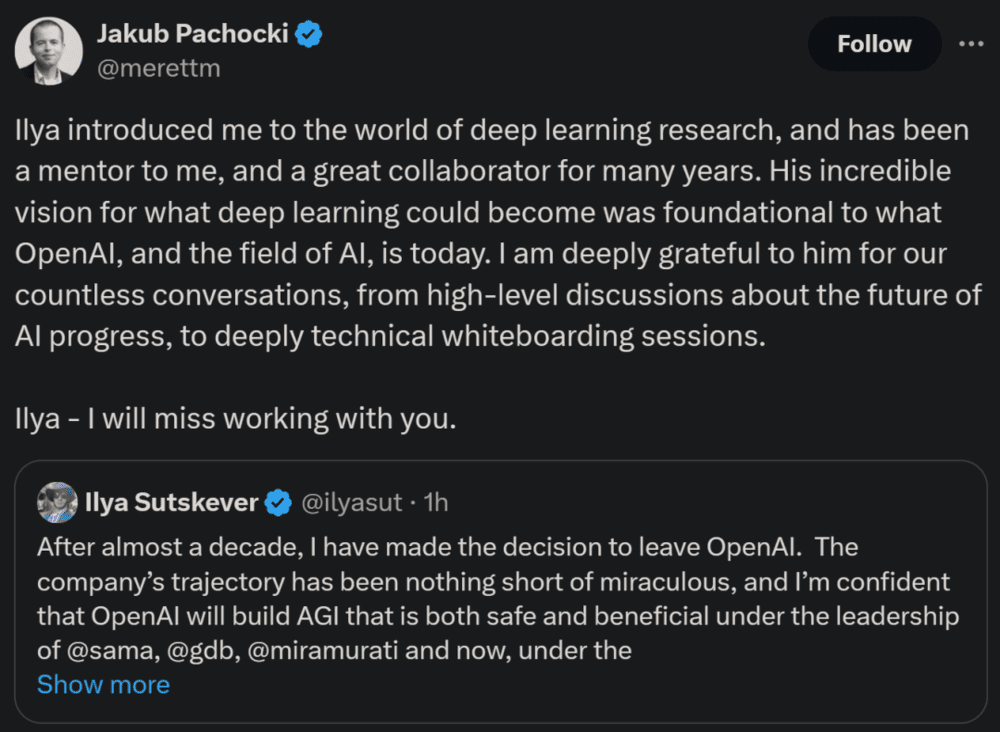

即将成为下一任 OpenAI 首席科学家的 Jakub Pachocki 也对自己的前任 Ilya 表达了感谢。

Ilya 把我带入了深度学习研究的世界,多年来一直是我的导师和伟大的合作者。他对深度学习的令人难以置信的愿景成为 OpenAI 和 AI 领域如今的基础。我非常感谢他与我们进行了无数次对话,从有关 AI 未来进步的高层讨论,到深入的技术白板会议。Ilya,我会想念与你一起工作的日子。

据 OpenAI 官网介绍,新任 OpenAI 首席科学家 Jakub Pachocki 拥有卡内基梅隆大学理论计算机科学博士学位,自 2017 年以来一直领导 OpenAI 的变革性研究计划。此前他曾担任 OpenAI 研究总监,也是开发 GPT-4 和 OpenAI Five 的带头人,还包括大规模 RL 和深度学习优化方面的基础研究。

OpenAI 表示:“他在重新调整公司愿景以扩展深度学习系统方面发挥了重要作用。”

至此,Ilya Sutskever 和 OpenAI 八年的故事结束了。

与 Ilya 同步宣布离开的,还有超级对齐团队的共同领导者 Jan Leike。

而我们都还记得,超级对齐团队在2023年7月才成立,目标是“在 OpenAI 大量计算的支持下,到 2027 年解决这个(对齐)问题。”

如今,两人同时离开,只留下未竟的事业。在 Ilya 的下一步计划中,会将“超级对齐”进行到底吗?

童年生活动荡,本科期间拜入 Hinton 门下

事实上,即使在一个没有 OpenAI 的世界里,Ilya Sutskever 仍会载入人工智能史册。

Ilya Sutskever 是以色列裔加拿大人,出生于前苏联,五岁随家人移民耶路撒冷(因此他精通俄语、希伯来语和英语),2002 年搬到加拿大生活。

在多伦多大学读本科期间,Ilya Sutskever 从一个叫做“改进随机邻域嵌入算法”的项目开始,开始了与 Geoffrey Hinton 的合作,后来在攻读博士学位时正式加入了 Hinton 的团队。

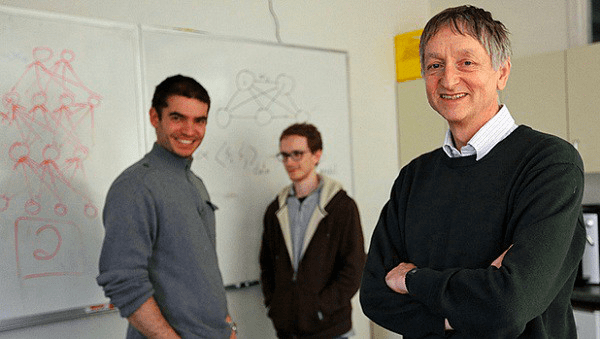

后来的事情我们都熟悉:2012 年,Hinton 带着 Ilya Sutskever 和另一名研究生 Alex Krizhevsky 建立了一个名为 AlexNet 的神经网络,其识别照片中物体的能力远远超过了当时的其他系统。

Ilya Sutskever(左)、Alex Krizhevsky(中)、Geoffrey Hinton(右)

Geoffrey Hinton、Yann LeCun、Yoshua Bengio 成为了深度学习三巨头,并在 2018 年获得了图灵奖,获奖理由就是“在神经网络方面的研究成果”。

但当 Ilya Sutskever 在 21 世纪初加入 Hinton 团队时,大多数人工智能研究者都认为神经网络是一条死胡同。

“由于与 Geoffrey 合作,我有机会研究这个时代一些最重要的科学问题,并追求大多数科学家极不认可、但事实证明完全正确的想法,”Ilya Sutskever 后来在一次采访中说道。

AlexNet 是深度学习的爆发时刻。经历了多年的失败之后,他所在的团队最早证明了模式识别问题可以被解决——秘诀就是一个经过大量数据和算力训练的深度神经网络。

这种思路从计算机视觉延伸到了自然语言处理领域,同样是 ChatGPT 取得如今成就的重要因素,包括 Sora 在视频生成领域的成功也离不开这两点。

2012 年毕业后,Ilya Sutskever 在斯坦福大学跟随吴恩达做了两个月的博士后,随后返回多伦多大学并加入了 Hinton 研究小组的衍生公司 DNNResearch 。

2013 年 3 月,Google 收购了 DNNResearch,聘请了 Ilya Sutskever 担任 Google Brain 的研究科学家。

“Ilya 一直对语言很感兴趣,”现任谷歌首席科学家 Jeff Dean 说:“他对事物的发展方向有很强的直觉。”

在谷歌,Ilya Sutskever 展示了如何深度学习的模式识别能力应用于数据序列,包括单词、句子。他与 Oriol Vinyals 和 Quoc Le 合作创建了序列到序列(Seq2seq)学习算法,深度参与了 TensorFlow 的研究,也是 AlphaGo 论文的众多作者之一。

加入 OpenAI,牵头 GPT 系列研发

对语言的浓厚兴趣,或许推动了 Ilya Sutskever 加入 OpenAI 的脚步。

2015 年 7 月,Ilya Sutskeve 参加了 Y Combinator 总裁 Sam Altman 在 Sand Hill Road 一家餐厅举办的晚宴,在那里遇到了 Elon Musk 和 Greg Brockman。

那场晚宴上诞生了 OpenAI。在场的人就一件事达成了一致:它需要是一个非营利组织,没有任何竞争性的激励措施来淡化其使命,还需要世界上最好的人工智能研究人员。

2015 年底,Ilya Sutskever 以“研究总监”的头衔开始领导 OpenAI 的研究和运营,这个组织还吸引了几位世界知名的人工智能研究者,包括“GAN 之父” Ian Goodfellow、UC 伯克利的 Pieter Abbeel 以及 Andrej Karpathy。

这家新公司拥有 10 亿美元的资金支持,来自 Sam Altman、Elon Musk、Peter Thiel、Microsoft、Y Combinator 和其他公司,从一开始就把目光投向了 AGI,即使当时很少有人认真对待这一前景。

然而,最初的 OpenAI 却举步维艰。Ilya Sutskever 说:“在我们启动 OpenAI 的时候,有一段时间我并不确定将如何继续取得进展。但我有一个非常明确的信念,那就是不能与深度学习对赌。不知怎的,每次遇到障碍,研究人员都会在半年或一年内找到绕过它的方法。”

2016 年,OpenAI 的第一个 GPT 大型语言模型问世。从 GPT-2 到 GPT-3,模型的能力越来越强大,证明了这条路线的实际正确性。每一次发布,OpenAI 都在不断提高人们的想象力上限。

但 Ilya Sutskever 却透露,真正让 OpenAI 出圈的 ChatGPT 发布时,公司内部对此的期望值很低:“你问它一个事实性的问题时,它会给你一个错误的答案。我以为它会很平淡无奇,人们会说:你为什么要做这个?这太无聊了!”

将 GPT 模型封装在一个易于使用的界面中并免费开放,让数十亿人第一次了解到 OpenAI 正在构建的东西。在此之前, ChatGPT 背后的大型语言模型已经存在了几个月。

ChatGPT 的成功,让创始团队受到了前所未有的关注。

2023 年,OpenAI 的首席执行官 Sam Altman 花了大半个夏天的时间,进行了长达数周的外联之旅 —— 与政客们交谈,在世界各地座无虚席的礼堂发表演讲。

作为首席科学家,Ilya Sutskever 保持着低调的风格,也不经常接受采访,不像公司的其他创始成员那般是个公众人物,而是把更多的精力放在了 GPT-4 上。

他对谈论自己的个人生活不感兴趣:“我的生活很简单。去上班,然后回家。我不做其他事情。一个人可以参与很多社交活动,可以参加很多活动,但我不去。”

ChatGPT 的成果给他带来了什么

今年早些时候,Hinton 曾公开表示对自己帮助发明的技术感到恐惧:“我从没见过更高智能水平的东西被远远更低智能水平的东西控制的案例。”

作为 Hinton 的学生,Ilya Sutskever 没有对这一言论发表评论,但他对超级智能负面影响的关注表明他们是同道中人。

随着 GPT-4 以及后续一系列更强大的大语言模型的更新,以 Ilya Sutskever 为代表的一部分 OpenAI 成员越来越担忧 AI 的可控性问题。

在 OpenAI 沸沸扬扬的“宫斗”事件之前,Ilya 曾接受过 MIT 科技评论记者的采访。

他表示,自己的工作重点不再是制造下一代 GPT 或图像制造机 DALL-E,而是研究如何阻止人工超级智能(他认为这是一种假想的未来技术,具有先见之明)的失控。

“Sutskever 还告诉了我很多其他事情 —— 他认为 ChatGPT 可能有意识(如果你眯着眼睛看的话)。”记者如此写道。

Ilya Sutskever 认为,世界需要清醒地认识到 OpenAI 和其他公司正在努力创造的技术的真正威力。他还认为,总有一天人类会选择与机器融合。

一旦人工智能的水平超过人类,人类又该如何监督比自己聪明得多的人工智能系统?

OpenAI 在 2023 年 7 月成立了“超级对齐”(Superalignment)团队,目标是在四年内解决超智能 AI 的对齐问题。Ilya Sutskever 是该项目的牵头人之一,OpenAI 表示会将 20% 的算力专门用于该项目的研究。

在一次访谈中, Ilya Sutskever 大胆预言,如果模型能够很好地预测下一个词,那么意味着它能够理解导致这个词产生的深刻现实。这意味着,如果 AI 按照现有路径发展下去,也许在不久的将来,一个超越人类的人工智能系统就会诞生。但更加令人担心的是,“超级人工智能”可能会带来一些意想不到的负面后果。这就是“对齐”的意义。

这个团队的第一篇成果发布于 2023 年 12 月:使用 GPT-2 级别的小模型来监督 GPT-4 级别的大模型,能获得接近 GPT-3.5 级别的性能,开辟了对超人类模型进行实证对齐的新研究方向。

同时,OpenAI 宣布与 Eric Schmidt 合作,启动了一项 1000 万美元的资助计划支持技术研究,以确保超人类人工智能系统的一致性和安全性。

随着两位团队领导者的离开,超级对齐团队的未来变得有些缥缈。

与 OpenAI 创始团队决裂

从今天的结果来看,Ilya Sutskever 应该是与 Sam Altman 所代表的派系产生了不可弥合分歧。

因为关于“宫斗事件”的过程,OpenAI 董事长兼联合创始人 Greg Brockman 的说法是:

Sam 收到首席科学家 Ilya Sutskever 发来的要求周五中午沟通的短信。Sam 用 Google Meet 参加了这次会议,除了 Greg 之外,整个董事会成员都参与了这场会议。Ilya Sutskever 告诉 Sam 他将被解雇,并且消息很快就会发出。

当天中午 12:19,Greg 收到 Ilya Sutskever 发来的短信,要求尽快电话沟通。12:23,Ilya Sutskever 收到 Google Meet 会议链接。Greg 被告知,他将被从董事会中除名(但他对公司至关重要,并将保留他的职位),而 Sam 已被解雇。大约在同一时间,OpenAI 发布了公告。

OpenAI 在公告中称 Altman 对董事会不够坦诚。有人将其解读为:OpenAI 可能已经在内部实现了 AGI,但并没有将消息及时同步给更多人员,为了防止该技术未经安全评估就被大规模应用,Ilya 等人按下了紧急停止键。

据 The Information 的报道,在 OpenAI 当天举行的全员会上,Ilya Sutskever 承认了员工所说的这是一场“政变”。他表示“你可以这么说(是政变),但我觉得这只是董事会在履行自己的职责。”

当然,这一切都只是猜测。

11 月底,Sam Altman 正式回归 OpenAI。大局已定,Ilya Sutskever 没有立即离开 OpenAI,但也没有再出现在 OpenAI 旧金山的办公室。

Sam Altman 表达了对 Ilya Sutskever 的谢意,并希望继续他们之间的工作关系:“我尊重并热爱着 Ilya,我认为他是这个领域的指路明灯,也是人类的瑰宝。我对他的恶意为零。”

Y Combinator 投资董事总经理 Dalton Caldwell 曾回忆:“我记得 Sam Altman 说过 Ilya 是世界上最受尊敬的研究人员之一,他认为 Ilya 能够吸引很多顶尖的人工智能人才。他甚至提到,世界顶级人工智能学者 Yoshua Bengio 认为,不可能找到比 Ilya 更好的人选来担任 OpenAI 的首席科学家。”

最终接任的 Jakub Pachocki,或许也是 OpenAI 董事会深思熟虑之后的选择。Jakub 2017 年就加入了 OpenAI,这也是他离开学校后的第一份工作。

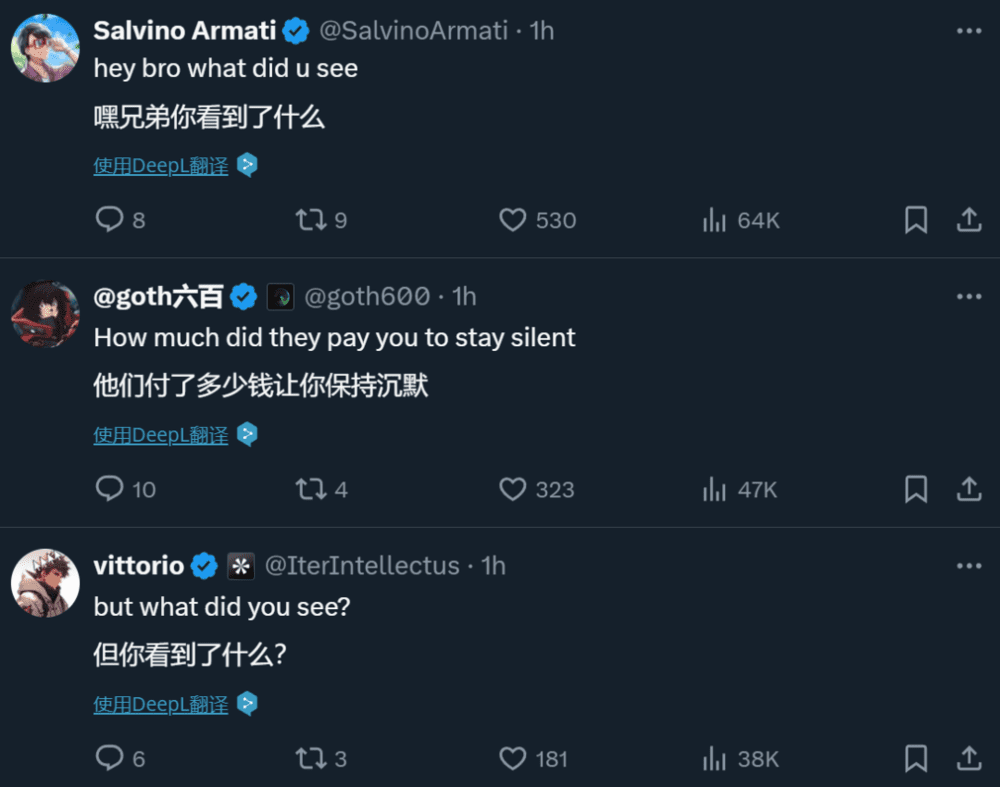

What did Ilya see?

关于 Ilya 离开 OpenAI 的传闻其实已经传了很久。在 OpenAI 发生“宫斗”、Sam Altman 被赶出 OpenAI 之际,有人传言说 Ilya“看到了一些东西”,这些东西足够强大,让他对 AI 的未来产生了担忧,并重新思考 AI 的发展。但他究竟看到了什么,目前还无人知晓。

其实,Ilya 的这种担忧并不是 ChatGPT 出来之后才有的。在拍摄于 2016 年至 2019 年的一段视频中,Ilya 曾表示,在 AGI 实现的那一天,AI 未必会仇恨人类,但他们对待人类的方式可能会像人对待动物一样。人可能无意伤害动物,但如果你想修一条城际高速,你不会征询动物的意见,而是直接去做。当面临这种情况时,AI 可能也会自然而然地做出类似的选择。这是 Ilya 的 AI 哲学观。

这就解释了为什么 Ilya 总是对 AI 的进步忧心忡忡,并专注于 AI 对齐(让 AI 与人类价值观对齐)工作。

Ilya 何去何从?

同为中途离开的 OpenAI 创始成员,马斯克向 Ilya Sutskever 抛出过橄榄枝,表示 Ilya Sutskever 应该加入特斯拉或 xAI。这会是他的下一步打算吗?

鉴于加州没有竞业禁止规定,Ilya Sutskever 可以立即去另一家公司工作或创办另一家公司。

另一位知名的 OpenAI 员工 Andrej Karpathy 就曾经在离开 OpenAI 后加入特斯拉,然后从特斯拉又回到 OpenAI,前不久再次宣布离开。2023 年底的“宫斗事件”发生时,Karpathy 正在休假,完全是“局外人”,但却比 Ilya 早一步办完离职手续。

真相究竟如何呢?我们不知道还有没有机会得知。

Ilya Sutskever 说的很多话可能有些狂野,但在现在这个节点看,已经没有一两年前那样让人感觉“疯狂”了。正如他说的那样,ChatGPT 已经改写了很多人对未来的预期,把“永远不会发生”变成了“会比你想象的更快发生”。

参考链接:

https://twitter.com/sama/status/1790518031640347056

https://twitter.com/ilyasut/status/1790517455628198322

本文来自微信公众号:机器之心 (ID:almosthuman2014),作者:机器之心编辑部