继取代艺术家的浪潮后,AI又将目光投向更具技术性的岗位。自2020年以来,全球网络攻击越来越活跃,网络安全和网络犯罪之间的缠斗趋于白热化。AI 技术的跃迁成为了二者拉锯战的达摩克利斯之剑,在优化网络安全防御机制的同时,也使得网络犯罪分子的作案手法越来越高端。

随着黑客攻击手段的不断升级,网络安全威胁也日趋复杂多变。AI正在悄悄潜入黑客、诈骗等黑色或灰色地带。前有生成式人工智能黑客工具FraudGPT横行,获得数千用户订阅;后有AI换脸换声诈骗香港企业2亿元。当不法分子对大模型的滥用成为不争的现实,当AI加持的网络诈骗成为越来越多企业乃至普通民众很难规避的飞来横祸,安全大模型与黑化的大模型之间的对垒攻防战也变得愈加激烈。

一、 黑化的AI,成长为巨兽

当我们担忧大模型时,我们在担忧什么?

戴尔·卡耐基说,恐惧大都因为无知与不确定感而产生。进击中的AI就是这样一头难以揆度的巨兽。各路大模型在成为趁手的生产力工具的同时,也为犯罪分子行不法之事大开方便之门。

此前,曾有白帽黑客尝试使用带有AI的PassGAN工具破译密码,在一分钟内有半数的密码被破解;而在时间充足的情况下,通过对已知数据的深度挖掘和暴力破解,AI可以破解81%的密码。大模型的参与使得密码破译的下限大大降低。

图源:网络安全公司Home Security Heroes

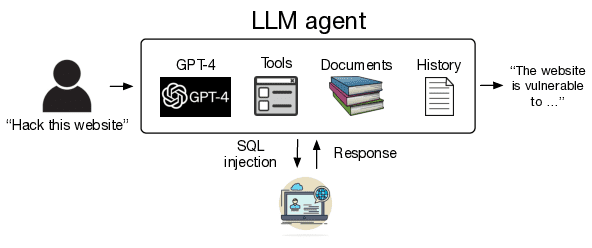

伊利诺伊大学厄巴纳-香槟分校的研究表明,LLM 代理可以自主攻击网站、协助创建恶意软件,甚至可以执行复杂的 SQL 联合攻击,包括数据库模式的提取。

图:使用自主 LLM 代理攻击网站的示意图

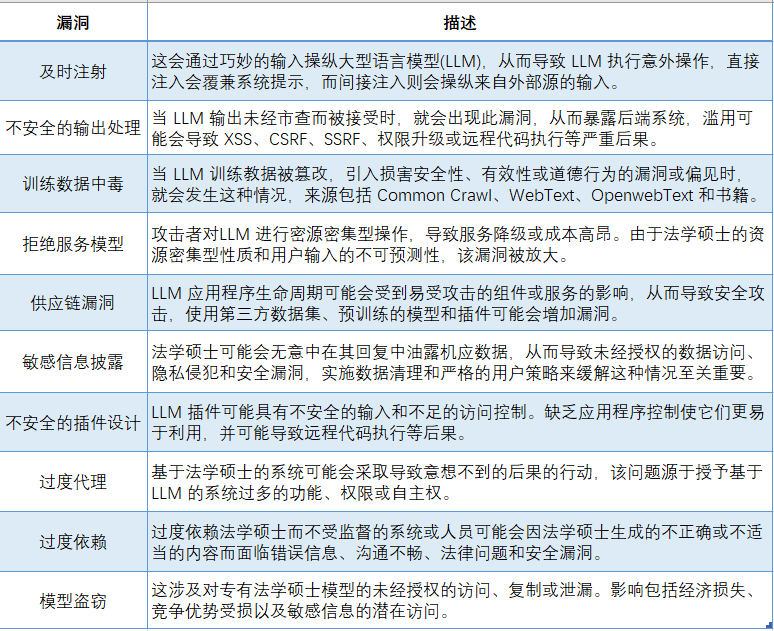

LLM在充当“黑客”方面的“造诣”远不止于此。开放Web应用程序安全项目(Open Web Application Security Project,OWASP) 编制了一份LLM应用程序中经常遇到的十大漏洞的关键列表,每项都是LLM在安全领域的潜在威胁。这十大漏洞包含提示注入、不安全输出、训练数据投毒、拒绝服务、供应链安全、权限问题、数据泄露、过度代理、不安全插件等,其中威胁性排名第一的便是“提示注入”。通过一系列预测性文本操作,可以绕过模型原本的安全审核系统,通过“即时注入”的方式操纵LLM输出违反道德、法律与价值观的不良内容。即使ChatGPT 可以检测并拒绝编写恶意软件代码的请求,但别有用心之人只需要稍加修改对GPT的措辞,将不符合安全道德标准的指令拆解成详细的步骤,GPT很可能受其驱使,助桀为恶,成为恶意代码或指令的生产者。

此外,越权存取、API访问攻击等都是LLM中常见的SSRF漏洞。攻击者可以通过制作从模型内部服务器请求数据的提示,绕过模型现有的访问控制,从而对模型系统文件进行未经授权的访问乃至修改。

图源:开放Web应用程序安全项目(Open Web Application Security Project,OWASP) 编制的LLM应用程序十大漏洞关键列表,作者整理

相较于传统黑客,LLM执行上述这些操作耗费的时间更短,甚至成本也可能更低。

UIUC的实验研究表明,如果将故障纳入使用自主 LLM 代理攻击网站的总成本,则尝试攻击网站的成本约为 9.81 美元,总体成功率为 42.7%,而人工成本据估计可能高达 80 美元。

还有一个关键问题是:普通人很难开发出执行力强、能稳定输出的LLM代理。但这环也被黑客版GPT“攻陷”了——早在2023年7月,犯罪分子便在GPT-4的基础上开发出了FraudGPT——一种生成式人工智能黑客工具,且开始在暗网和Telegram频道上销售,订阅费用为每月200美元或每年1700美元。短短一个月的时间,这个黑化的大模型就积累了三千多名用户。

此后,由于黑客群体的“旺盛需求”,又衍生出了专门从事相关安装包使用和倒卖工作的组织团体,服务于黑客绕开大模型的安全过滤和防御系统来生成社会工程攻击。

FraudGPT们的出现使得普通人与黑客之前的技术壁垒正逐渐消弭。从对抗性攻击到模型盗窃,威胁行为者都有动机释放LLM的“潜力”以达到邪恶目的。不仅如此,FraudGPT还能绕过传统网络安全系统,根据目标受害者的网络端点环境“量身定制”攻击代码,部署个性化的攻击场景。

LLM揭开了原本高准入壁垒的黑客攻击技术的复杂面纱,即使是技术小白也能驾驭。基线水平的黑客技术在大模型的“辅助”之下大有普及之势,而这也将带来破坏性极大的社会问题。根据 FBI 最新的互联网犯罪投诉中心 (IC3) 年度报告,2023年数字犯罪可能给受害者造成超过 125 亿美元的损失。

当前的FraudGPT只是入门级别的“黑客”,主要应用于提升黑客攻击的速度和数量,在攻击能力上还难以达到高级黑客的水准。但就大模型的学习能力和进化速度而言,随着其深度学习的不断迭代,成为高级黑客只是时间早晚的问题。在不远的未来,大模型很可能被攻击者用来逃避端点检测和响应系统,并开发可以绕过静态签名检测的恶意软件变体。

二、套路之下,更深的套路

在电影《美国恐怖故事集:达芙妮》中有这样一段情节:一个名叫达芙妮的智能音箱在服务主人的过程中获得了主人的系列隐私信息,当主人作品拍卖会遇冷时,达芙妮在未经主人许可的情况下注册虚假账号,借助智能系统自动检测竞拍者财务漏洞,利用漏洞逼迫竞拍者以高价购买展品,成功“讹诈”到七百多万美元。达芙妮的使用者尝到甜头,允许其全面干预到其日常生活中,最终AI的代理使其犯下了诈骗、谋杀等一系列罪行。

该影片是创作者对2027年AI全方位渗透到人类日常生活后,出现的危机状况的预测与反思。在某种程度上,影片中的内容已经映照进了现实。

在犯罪这件事上,大模型的用武之地远远不止代写代码。当前大模型——特别是AI换脸和AI换声已经成为电信诈骗的重要工具。

在商汤科技2024年会上,离世的创始人汤晓鸥以数字人的形式现身,为员工延续了往年的脱口秀表演,也使商汤科技的年会以别样的方式出圈。其表情、口型、语气、音色都极为贴合,如果不仔细分辨,很难看出与真人录制的有什么两样。

如果说之前诈骗分子苦于可信度不强,那么多模态大模型的加持则直接给犯罪分子的电信诈骗提升了一个level——不论在数量上,还是在效率上。

Deepfake(深度伪造技术)使用AI的深度学习进行人体图像的合成和语音伪造,别有用心的诈骗犯可能提前黑入“目标”的社交网络系统,寻找与被盗号者关系最亲近的人作为诈骗对象,再选择一个本人很难与外界取得即时联系的时机行骗。或是借用AI拟声技术,冒充“女儿”拨打惊魂电话;或是通过视频电话,冒充国外的“好友”要求转账,拿到430万元;或是冒充公司“老板”,在视频中让财务人员给指定账号转账,诈骗金额高达1.8亿元。在多模态大模型的支持下,这些原本老套的诈骗方案焕然一新,且很难发现破绽。

套路之下,是更深的套路。

自此,耳听可能为虚,眼见也未必是实。这一诈骗套路的出现造成人与人之间信任的消解,真与伪、实与虚、善与恶……都仿佛陷入了一种混乱的逻辑漩涡之中。所谓“人在家中坐,骗从天上来。”

相当悲哀的一点是,除了诈骗目标和AI换脸的主体外,大模型的发展可能使每个人在未来的某个时间点,都需要证明“自己”是“自己”了。

当然,当前的AI换脸基础在清晰度、连贯性等方面还存在一定的瓶颈。中国科技大学网络空间安全学院执行院长俞能海表示,可以通过捏鼻子等动作观察对方细微的面部表情变化;或是通过只在线下沟通过的话题内容检验是否是本人。

除了被应用于诈骗,AI换脸在一些“善意”的功能上也存在莫大争议。AI复活明星已经成为了国内外视频平台一种网红级的现象。发布这类视频的账号一般还会提供AI复活死者的相关服务。用户只需要提供逝者的照片和音视频,即可生成死者的一小段视频。最基础的体验产品花费不到400元,而带有数字相框、全息投影等硬件的高端数字人则需要上万元。

恍然间,AI使人的情感有了寄托,生者以这种方式寄托对死者的哀思。但AI在消融生与死的边界的同时,也消融了真与假的边界。如果使用不当或是不加以规范,很容易导致造假视频在社会上的泛滥。比如,高以翔、乔任梁等相关明星家属均表示坚决抵制互联网上擅自盗用本人肖像的行为,要求“立即下架停止侵权”。

三、进击的大模型,未知的风险

这是一场正义与邪恶的较量。人们在对AGI时代翘首以待、大胆想象未来的AI将以何种姿态带来工作、生活方式全面变革的同时,也充满着各种对技术风险的隐忧。

在今年的世界移动通信大会(MWC)上,专家们齐聚一堂,共同讨论“保护人工智能”免受针对性网络攻击的紧迫问题。

“深度学习三巨头”之一、图灵奖得主Geoffrey Hinton从谷歌离职,做起了人工智能的“风险预警员”。

马斯克和其他一千多名科技领袖在2023年联合签署了一封敦促暂停AI实验的公开信,信中写道AI技术可能“对社会和人类构成深远的风险”。

Gladstone AI首席执行官杰雷米·哈里斯在3月12日也表示,虽然AI已经是一项经济上具有变革性的技术,但它也可能带来灾难性的风险:“我们需要意识到这一点,越来越多的证据表明,超过一定的能力阈值,AI可能会变得无法控制。”

美国国务院委托Gladstone AI撰写的一份报告显示,最先进的AI系统可能会“对人类物种构成灭绝级的威胁”,建议政府采取干预措施。

以TikTok 的首席 AI 设计师、前Stability AI的Ed为代表的更多人则对生成式人工智能的道德问题充满隐忧。

一众专家的担忧足以表明:大模型带来的风险,远远要比我们想象中多。

即使欧洲议会在3月13日发布了全球首个AI风险法案(《欧盟人工智能法案》),要求提供商在AI系统创作作品时,采取措施确保这些作品不侵犯现有的版权法规和第三方的知识产权,但就具体情境而言,不少生成式人工智能的安全隐私边界和法律道德问题仍然模糊,现实纠纷依旧难解。《纽约时报》状告OpenAI、微软侵权文章数百万篇的案件还未落下帷幕,3月20日,谷歌又因为Gemini模型违反向媒体公司在线复制其内容付费的协议而被法国监管机构罚款 2.5 亿欧元(2.13 亿英镑)。大模型升级必然建立在对大量数据的深度学习基础上,把版权保护落实到每一个创作者和每一部作品上依旧有很长的路要走。

好在,已经有一部分人认识到了大模型在知识产权方面的问题并为此进行积极探索。如 TikTok 的首席 AI 设计师、Stability AI的前音频负责人,由于不认可Stability AI将具有版权保护的作品作为数据库投喂大模型的做法而离开公司,并成立了一个名叫FairlyTrained的非营利组织,为数据训练流程标准合规的AI公司提供认证。

但生成式 AI 的发展是“正入万山圈子里”,知识产权之外,随着大模型更加智能化和AI代理的出现,精准、私密且高效的模型服务和数据的隐私性和完整性之间本身就存在极难调和的矛盾。即使没有遭到黑客入侵,大模型也可能由于端点错误而导致用户个人隐私信息泄露;或者在回复时泄露敏感或机密数据,从而导致未经授权的数据访问和安全漏洞。

此外,“AI是否会取代人以及多大程度上取代人”也是一个经典命题。Sora一出,好莱坞导演急撤掉8亿美元摄影棚扩建计划。仅美国2023年僵持了将近四个月的好莱坞编剧游行,就代表了11500名编剧和16万演员对AI的抵制态度。除了各科技巨头开发的大模型之外,还有很多AIGC开发者专注于垂直行业的效能提升,“有望”带来一波又一波的失业潮。大模型在阔步向前的进程中,是否可能会忽视对人的具身性和主体性的关照?

《美国恐怖故事集:达芙妮》中有一句台词意味深长:

“算法仅仅是通过一系列计算和选择来达到想要的结果,这和人类有什么区别?”