或许,能打败OpenAI的只有OpenAI。

2022年底,OpenAI推出人工智能聊天机器人ChatGPT,开启了大模型领域的“竞速跑”模式。2024年2月15日,随着视频生成模型Sora的横空出世,OpenAI再度掀起热潮。

Sora将视频生成内容拉到了一个全新的高度,逼真的视频效果刷新了社会对AI能力边界的认知。它的问世,就如同一枚深水炸弹,瞬间引爆全球科技圈。

不少业内人士直言,Sora的到来标志着一次质的飞跃。英国皇家工程院国际院士、欧洲科学院院士许彬(Pan Hui)在接受《每日经济新闻》记者采访时表示,“目前Sora在视频生成品质上面绝对是无可匹敌的。Sora生成的视频可以从小特写切大全景,变换不同的机位。”

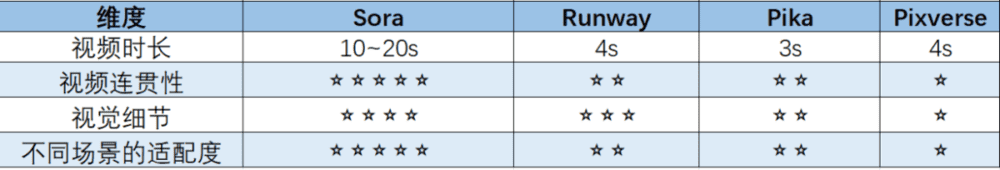

值得注意的是,文生视频大模型并不是一条全新的赛道。为了更直观地呈现Sora的文生视频能力,《每日经济新闻》记者采用OpenAI官方公布的5条Sora视频提示词,对Pika、Runway和PixVerse的文生视频能力进行了测试,并将生成结果与Sora视频进行了对比,测试场景涉及人物特写、电影预告片等5类。

对比结果显示,Sora在生成长度、连贯性和视觉细节方面表现出明显的优势,几乎实现了“降维打击”。

从ChatGPT到Sora,为何OpenAI能连续打造出“王炸级神器”?

加州大学伯克利分校计算机科学PHD、知乎作者SIY.Z分析称,“如果必须用一个词来展现OpenAI最核心的技术,我觉得是scaling law——即怎么样保证模型越大,数据越多,效果就越好。”从文本生成模型GPT、文生图模型DALL·E,到文生视频模型Sora,OpenAI或许已经打造出了一条自己的AGI通用技术路线。

一、5大场景实测: Sora在时长等4个维度上实现“降维打击”

2月15日,OpenAI正式发布了首款文生视频大模型Sora。演示视频一经发布迅速引发业内热议,部分网友更是哀嚎,“要失业了。”

华大集团CEO尹烨在一篇文章中写道,“从这一刻,可拟合更多真实物理定律的数字孪生世界走进了人类社会。我愿意将其类比为,开启了AI发展的牛顿时代。”

Sora的文生视频能力到底有何突出之处?

由于Sora并未开放测试账号,因此《每日经济新闻》记者采用OpenAI官方公布的5条Sora视频提示词,在街头、卡通动画、人物特写、动物特写以及电影预告片这5大场景下对同类模型Runway、Pika和Pixverse进行了效果测试。同时,将OpenAI官方公布的Sora视频与前述3个文生视频大模型进行了对比。

效果测试对比发现,Sora在生成视频的时长、连贯性和视觉细节方面表现出明显的优势,几乎达到“吊打”的程度。

英国皇家工程院国际院士、欧洲科学院院士许彬(Pan Hui)在接受《每日经济新闻》记者采访时也表示,“Sora的核心优势可以总结为,生成高清晰度的长视频。不论是清晰度,还是时长,目前都是第一。OpenAI更专注在照片写实主义的技术,虽然现在去讨论它会否引领新浪潮可能为之尚早,但是目前Sora在视频生成品质上面绝对是无可匹敌的。”

不过,需要说明的是,本次效果对比仅基于5个场景下的提示词,场景和提示词的数量均较为有限,并且不同模型生成的结果可能存在随机性。

一位技术从业者也向每经记者表示,尽管Sora与其他文生视频大模型的结果对比非常强烈,但不排除Sora的视频是OpenAI多次生成后选取最好的一条予以发布,因此展示效果更优。

1. 更长的视频时长

在与Runway、Pika和PixVerse的对比中,Sora生成的视频平均长度将近16秒,最长达到20秒,而相比之下,其他三个模型生成的视频长度均在3秒~4秒左右。Sora最长可以生成长达一分钟的视频,这使得Sora能够更完整地呈现视频内容,使其更适合制作短片、广告和其他应用。

2. 更强的视频连贯性

Sora生成的视频具有无缝过渡、自然的摄像机移动和流畅的角色动画,增强了整体观看体验。而相比之下,其他模型制作的视频经常会出现场景突变、画面不流畅等问题,影响观看体验。

许彬表示,“Sora可以改变视频的视角。Sora生成的视频,可以像一镜到底一样,从小特写切大全景,变换不同的机位,但是保证画面中的人物/物品。同时,(Sora生成的视频中)物体的一致性很强。一致性一向是在视频生成的领域里比较挑战性的一环,而Sora在此方向表现很好。”

3. 更丰富的视觉细节

此外,每经记者发现,Sora生成的视频视觉细节丰富,物体纹理清晰,色彩逼真,整体视频质量更高。相比之下,其他模型生成的视频通常显得模糊、细节不足、色彩不那么鲜艳。

例如,在生成的“女人眨眼睛”的视频中,Sora对女性眼部的特写十分到位,从眉毛、睫毛、眼皮褶皱、眼袋、卧蚕和细纹的细节来看,已经达到以假乱真的效果。

4. 更能满足不同的场景

从上述5大不同场景的呈现效果不难看出,Sora明显更能够满足不同创作者的需求,无论是创作科幻场景、动画人物,还是模拟真实场景,都可以轻松实现。

华鑫证券研报称,Sora的核心技术是基于OpenAI在自然语言处理和图像生成方面的深厚积累,与Runway、Pika等相比,Sora在视频生成的真实感、细节表现上均具标志性价值。

AI视频生成虽不是新事,但Sora的推出有望推高AI多模态的热度,可关注AI多模态应用塑造数字内容生产与交互新范式,赋能视觉行业,从文字、3D生成、动画、电影、图片、视频、剧集等方面,有望带来内容消费市场的繁荣发展。

二、从GPT到Sora,OpenAI打通AGI技术栈

从Sora身上,可以看到OpenAI沿袭了过往大语言模型训练的许多成功经验。

Sora视频的逼真和连贯程度着实令人惊叹,而帮助Sora实现能力飞跃的是该模型的两项核心突破。

首先在底层架构上,Sora采用的Diffusion Transformer(DiT,或扩散型 Transformer)架构。

OpenAI的文本模型,例如GPT-4,就是采用的Transformer模型,传统的文本到视频模型通常是扩散模型(Diffusion Model),Sora采用的DiT架构则融合了GPT和传统的扩散模型架构。

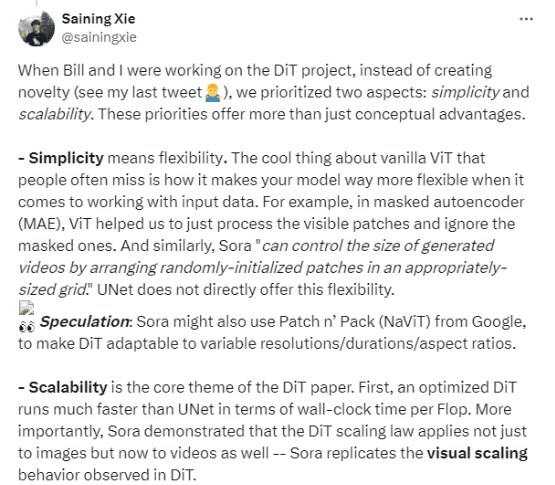

从OpenAI官网公布的Sora技术报告中可以发现,Sora采用的DiT架构的理论基础是一篇名为Scalable diffusion models with transformers的学术论文。该篇论文是2022年12月由伯克利大学研究人员、现Sora团队技术领导William(Bill)Peebles和纽约大学研究人员谢赛宁共同发表。

在Sora发布后,谢赛宁在X平台上写道,“当Bill和我参与DiT项目时,我们并未专注于创新,而是将重点放在了两个方面:简洁性(Simplicity)和可扩展性(Scalability)”。他表示,“可扩展性是论文的核心主题,优化的DiT架构的运行速度比UNet(传统文本到视频模型的技术路线)快得多。更重要的是,Sora证明了DiT缩放定律不仅适用于图像,现在也适用于视频——Sora复制了DiT中观察到的视觉缩放行为。”

图片来源:X平台

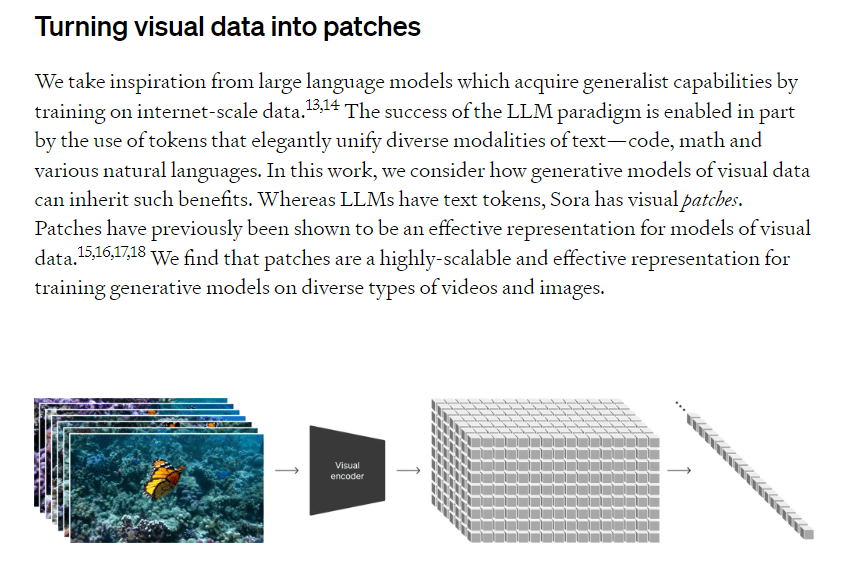

其次,Spacetime Patch也是Sora创新的核心之一。在这一点上,Sora的设计思路和GPT-4也是一致的。

Patch可以理解为Sora的基本单元,Patch是视频的片段,一个视频可以理解不同Patch按照一定序列组织起来的。就像GPT-4 的基本单元是Token,而Token是文字的片段。GPT-4被训练以处理一串Token,并预测出下一个Token。Sora遵循相同的逻辑,可以处理一系列的Patch,并预测出序列中的下一个Patch。

许彬向记者解释,“把视频数据变成一个个小块(patches),让模型对图像的理解能够像文字一样。参考过往GPT的表现,GPT对文本的语义理解水平非常细腻,将同样的原理应用在视频上,可以增加数据的灵活性以及模型最后的表达能力。”

图片来源:Sora技术报告

正如谢赛宁所谈到的“Scalability”一样,加州大学伯克利分校计算机科学 PHD、知乎作者SIY.Z在知乎上这样写道,“如果必须用一个词来展现OpenAI最核心的技术,我觉得是scaling law——即怎么样保证模型越大,数据越多,效果就越好。一句话概括 Sora 的贡献,便是在足量的数据,优质的标注,灵活的编码下,scaling law在transformer + diffusion model的架构上继续成立。”

在他看来,数据、标注、编码、底层架构都是来自于此前大模型的成功经验。谢赛宁在X平台也曾提到, Sora有两个关键点尚未被提及,一是关于训练数据的来源和构建,二是关于(自回归的)长视频生成相关的技术细节。

可以说,对于目前all in AGI的OpenAI来说,从文本生成模型 GPT、文生图模型 DALL·E,到文生视频模型 Sora,OpenAI或许已经打造出了一条自己的AGI通用技术路线。

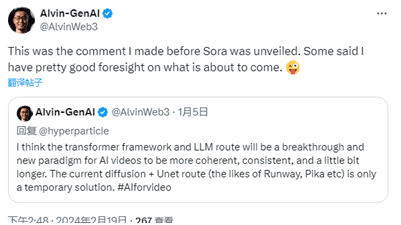

值得注意的是,建立在此前成功经验之上的Sora路线,可能会成为接下来的文生视频模型新范式。早在1月,一位前阿里的AI专家在X平台上表示,“我认为,Transformer框架和LLM路线,将是AI视频的一个突破口和新范式,它将使AI视频更加连贯、一致,并且时长更长。目前的Diffusion+Unet路线(如Runway、Pika等),只是暂时的解决方案。”

图片来源:X平台

三、800亿美元,“资本狂欢”,OpenAI估值9个月增长两倍

从聊天机器人ChatGPT,到文本转图像模型DALL·E,再到近期的文本转视频模型Sora,风口上的OpenAI成为资本市场不变的关注焦点。

实际上,文生视频大模型并不是一条全新的赛道。很多文生视频大模型早已走入大众的视野,例如Stability AI的Stable Video Diffusion、Runway的Gen-2 Video、谷歌的Lumiere、Meta的Make-A-Video、Pika以及PixVerse等等。

其中,Pika在去年11月正式发布Pika 1.0后更是掀起全球热潮,其创始人郭文景也名声大噪,Pika 1.0也被称作是Runway Gen-2的最强竞品。不过,在Sora火爆出圈后,随着其所代表的新技术路线的出现,文生视频领域的版图恐怕要重新改写了。

一方面,核心技术是一道鸿沟——Diffusion Transformer和Spacetime Patch并非新鲜事物,但却只有OpenAI成功推出了Sora。并且,从文生视频的实测对比来看,Sora的确实现了降维打击。

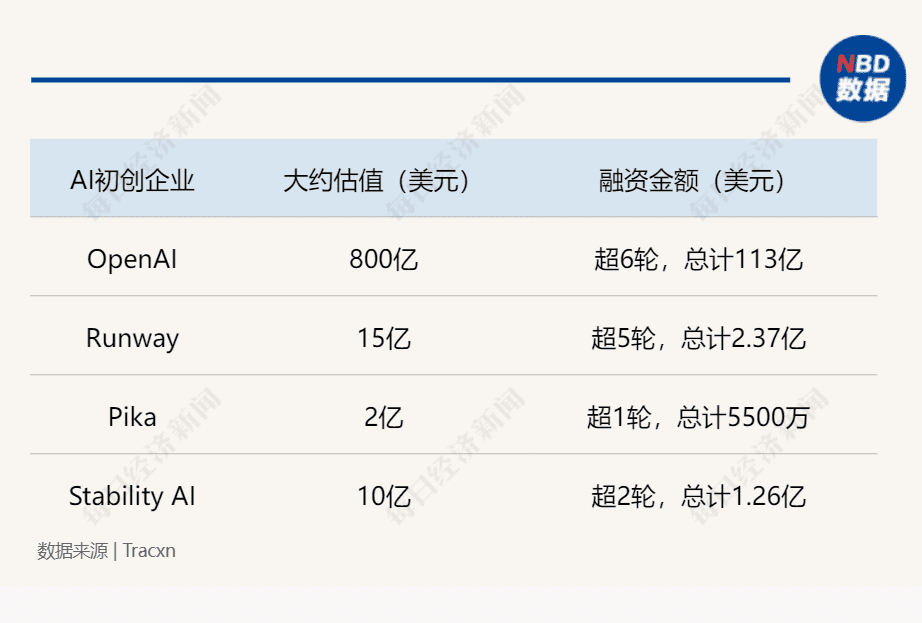

另一方面,从估值和融资规模来看,背靠微软的OpenAI在AI初创公司中可以说是断层领先。之所以其产品一经发布,就能让行业震惊于其超强的迭代能力,恐怕也离不开背后的烧钱。

图片来源:每经制图

Sora火爆出圈后,资本圈的最新消息是, OpenAI的估值已飙升至800亿美元以上,值得一提的是,该公司的估值在9个月的时间里增长了两倍。

除了各种AI大模型产品之外,OpenAI CEO山姆·阿尔特曼还瞄准了半导体领域。据报道,阿尔特曼正与潜在投资者、半导体制造商和能源供应商等各种利益相关者接触,预计将融资7万亿美元打造芯片帝国。

在技术和资金的加持下,OpenAI在接下来的时间里,可能还将继续遥遥领先。

与之相比,Runway截至目前累计融资超2.5亿美元。TechCrunch报道称,Runway的估值在去年6月底达到15亿美元,其投资者包括谷歌、英伟达、Salesforce等。

Pika的估值目前近2亿美元,这家仅有四人的初创公司有着非常豪华的投资人阵容,包括前Github CEO Nat Friedman、Quora创始人Adam D'Angelo、OpenAI创始成员Karpathy、Perplexity CEO等。

去年11月,Stability AI的估值达到约10亿美元。不过,Stability AI今年来也不断面临着资金方面的压力。2023年11月,Stability AI被曝出由于财务状况压力巨大正在寻求出售。此外,其重要投资者美国对冲基金Coatue Management还在去年10月致信管理层,要求CEO埃马德·莫斯塔克辞职。

四、内容创作领域将被颠覆,监管迫在眉睫

许多人认为,Sora的出现可以改变一系列创意产业,从电影制作、广告到图形设计,从游戏开发到社交媒体、影响力营销甚至教育科技等领域都将受到影响。

“最直接的是视频制作领域。不管是电影,还是人人都能参与的短视频,很多危险的,不容易拍摄的场景,都可以让AI帮我们完成。这样大大改变了视频创作的逻辑,也降低了视频创作的门槛。不具备视频拍摄能力的人,通过自己的想象力,也可以变成优秀的视频创作者。”许彬说道。

他同时告诉记者,Sora和其他类似的AI视频模型在多个行业都显示出巨大的商业潜力和市场需求。“包括媒体和娱乐、银行、金融服务与保险、零售以及医疗保健等行业将极大受益于生成式AI的进步。这些技术的应用不仅可以优化营销和销售活动,改善客户服务,还能加强产品开发和风险管理。”

许彬同时表示,“生成式AI在这些领域的变革潜力已表明了广泛的市场需求和跨行业的巨大经济价值,可能为各个行业创造2.6万亿至4.4万亿美元的价值。”

此外,据外媒报道,光速印度合伙人Hemant Mohapatra将Sora的出现比作为潘多拉的魔盒已经打开,将会让一切都发生改变。“它生成的视频质量之高,会让库存视频生成公司立即感受到威胁。”

二级市场的腥风血雨已经可以印证这一说法。Sora发布的次日,美国电脑软件公司Adobe股价暴跌超7%;美国图片库、图片素材、图片音乐和编辑工具供应商Shutterstock跌超5%;几周前发布了“文生视频”工具Lumiere的谷歌母公司股价下挫1.58%。三家公司一天内就合计蒸发近480亿美元的市值。

另一方面,随着AI的快速发展,有关其风险的讨论也一直未曾停歇,如何防止其被滥用或误用以及如何避免其对人们的认知产生负面影响是业内许多专家探讨的重点之一。

“视频生成很容易应用在诈骗领域。很多地方都有人脸识别,视频生成也让过往的技术变得不再安全。为了减轻这些技术可能带来的风险,建立健全的道德准则、实施严格的数据隐私措施,以及确保AI模型开发和使用的透明度至关重要。”许彬告诉记者。

随着AI的发展,各国也在致力于加强对AI的监管。早在去年10月,美国白宫首次发布针对AI的行政令,将对AI研发和应用制定全面的监管标准。去年11月,中国、美国、英国、欧盟等多方代表在首届全球人工智能安全峰会上签署了《布莱切利宣言》。

许彬认为,未来,重点可能会转向增强(AI)能力,同时确保以合乎道德和负责任的方式开发和使用它们,以最大限度地发挥其对各个行业的积极影响。“AI视频模型正在朝着更负责任的AI实践方向发展,(需要)通过投资研发来增强AI应用的安全性和保障。采取积极主动的方法来解决这些社会和伦理问题是可能的。”

本文来自微信公众号:每经头条 (ID:nbdtoutiao),作者:文巧、郑雨航,编辑:兰素英,视觉:刘青彦