年末晒成绩之际,百度、中汽中心、同济大学却联合公布了这样一份报告:

《自动驾驶汽车交通安全白皮书》。

这份聚焦自动驾驶道路交通安全的报告,还是产学研联合出品,有车,有路,也有政策和技术。

今年,自动驾驶公司各显神通,商业化落地进展迅速。

此时强调自动驾驶的安全,又有何深意?

普通人对于自动驾驶最大的担忧,《自动驾驶汽车交通安全白皮书》(下称《白皮书》)又给出了哪些解答?

L4级无人车,敢放心坐吗?主驾副驾都没有人的RoboTaxi,越来越多的地区都能体验到。

怎么让普通市民放心乘坐?

业内常说L4及以上的的高级别自动驾驶比人类更可靠,有什么依据?

数据说话。

首先来了解下人类司机为什么会犯错误。

《白皮书》中援引了公安部交通管理局《道路交通事故统计年报》数据:

2017-2019年我国交通事故年均发生23.19万次,年均死亡人数达6.3万人,另有24万人受到非致命伤害,约90%以上的道路交通事故是驾驶员人为因素导致的。

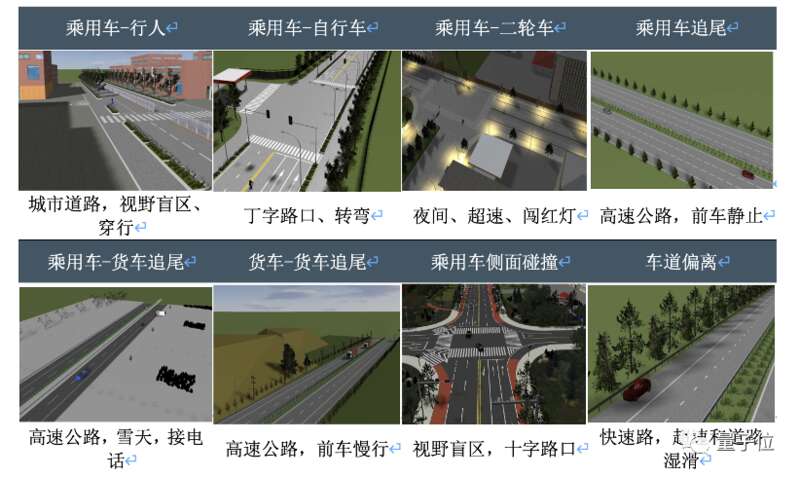

易发多发点位为交叉口(无信号灯)处和红绿灯处,其数量占比达到了百分之五十以上,弯道等典型路段也存有一定的规模。

这些事故包括车与车、车与人、车与两轮/三轮车、单车事故等等。

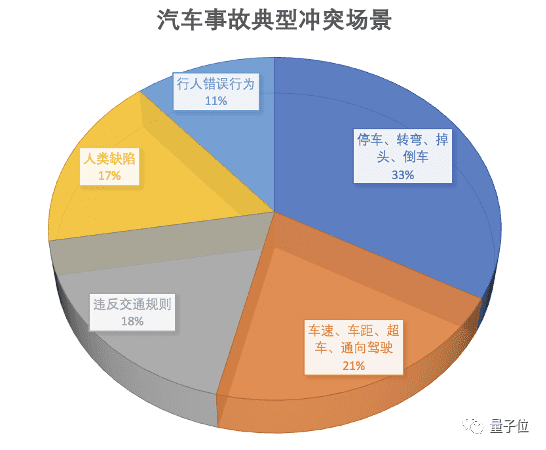

而根据CIDAS数据库中筛选出的2011-2021年5664起典型乘用车事故,成因无外乎两点:

因驾驶员无法对风险进行正常感知和识别等主观错误导致的事故发生。

因驾驶员自身能力受限无法正确面对内外部干扰导致的事故发生。

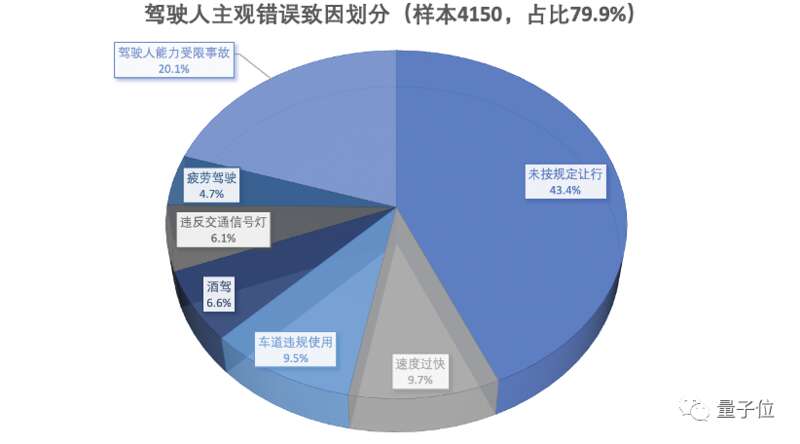

主观错误,比如抢行、超速、酒驾、疲劳驾驶等等,占样本总数的79.9%。

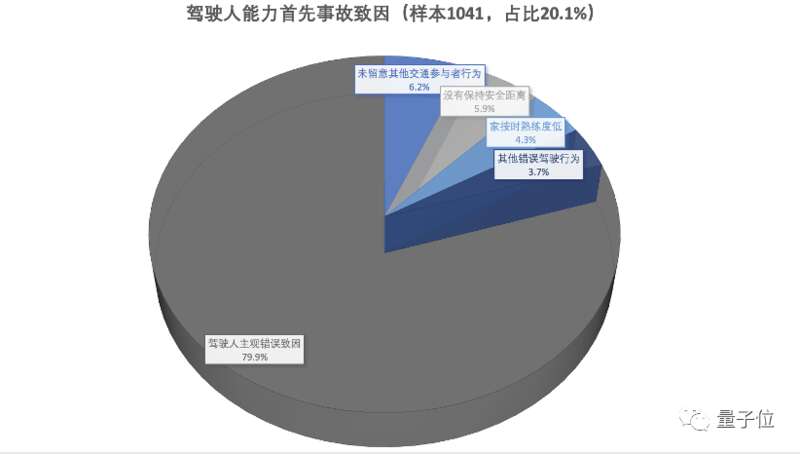

自身能力受限,指的是驾驶员自身能力不足或受环境条件限制,观察不全其他交通参与者行为造成事故,占样本总数的20.1%。

所以,人,是交通安全中最不确定的因素。

自动驾驶技术中的感知、决策、执行系统,充分地识别道路中各类动态、静态目标、实现自主决策和车辆运行。

不会违反交通规则,不会疲劳驾驶、更不会酒驾。

最重要的,自动驾驶系统不会“路怒”,更不会和其他车辆行人争执冲突。

这样就从根源上减少甚至消除因人类驾驶中违规操作、驾驶经验不足等风险。

自动驾驶系统为什么更安全?《白皮书》以百度Apollo的L4技术体系为例,分析了常见自动驾驶系统的安全保障体系。

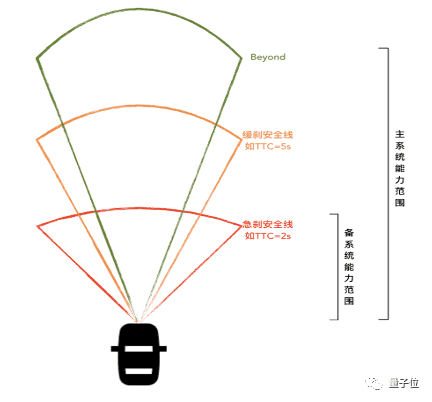

首先是主系统安全,即感知、决策、控制等等核心算法能力,同时满足低时延系统、高精度感知、多传感器冗余的特征。

此外,类似Apollo这类L4自动驾驶系统还提供车路协同保障,在视距范围外提前获知道路信息,提前规划决策,避免盲区死角等安全隐患。

第二层保障是冗余系统,包括硬件冗余、监控和软件冗余。

硬件冗余好理解,就是传感器、车辆控制、计算单元的“预备部队”,一旦某一系统故障失效,马上有后备启用。

故障监控系统,能够对系统运行中的所有软硬件类失效做到实时检测监听,同时进行风险预测。

软件冗余系统则是一套完整的轻量化感知定位与决策控制的软件。

同样具有感知决策功能,范围较主系统稍小,当检测到主系统故障或失效时,备份系统代替其接管车辆的操控,实现安全停车。

最后是远程云代驾。得益于中国5G优势,车辆在极端困难场景下,有条件请求远程安全员接管,安全平稳的通过。

AI司机比人类司机更靠谱?自动驾驶都在讲“更安全”,所以究竟如何定义更。

《白皮书》这次也有理有据给出论证。

但开门见山,率先明确的是另一个易于被误解的问题:

自动驾驶=无事故?

《白皮书》明确:并不是。

真实数据表明,自动驾驶系统不能避免所有事故——至少现阶段不能。

原因较为复杂多样,可能是感知算法的缺陷、传感器数据融合问题、极端场景缺乏训练数据等等。

另外这也符合新技术和新事物发展的客观规律,不会一蹴而就。

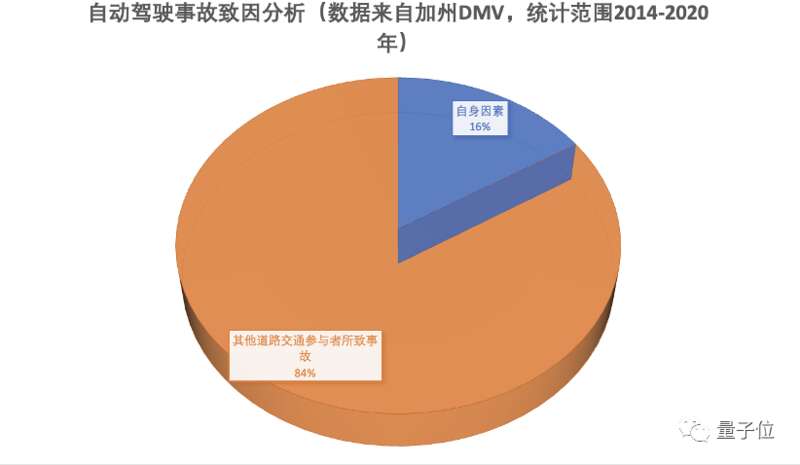

但即便“自动驾驶≠零事故”,在分析事故案例后,数据也在证明——

自动驾驶比人类驾驶,安全概率上不止提高亿点点。

《白皮书》提出,人为因素导致事故的两大因素中,首先自动驾驶系统能够避免人类司机的主观错误,从而使80%的事故致因能有效避免。

而驾驶人能力受限导致的事故致因中,自动驾驶汽车能够通过车路协同技术对周围环境进行全视角感知,能够提前发现90%以上的事故风险因素。

此外,即便发生事故,自动驾驶也能降低伤害程度。

美国加州机动车辆管理局所披露的自动驾驶事故案例显示,自动驾驶汽车尽管无法完全避免交通事故,但其相比于人类驾驶汽车,能够显著降低事故带来的人员伤亡和财产损伤。

2019年至2020年的149起事故案例中,没有一起死亡事故,接近83%的事故,未涉及人员受伤。

而在有人员事故受伤的案例中,仅有2起事故存有安全气囊的打开,该2起事故人员受伤程度仅为轻伤。其余20多起事故均仅为安全员或事故对方人员感觉到背部或颈部疼痛。

所以,《白皮书》通过援引官方和业内头部公司案例数据,得出这样的结论:

自动驾驶汽车普及,会进一步减少不规范的交通参与者的驾驶行为,进而减少因人类错误带来的事故。

在面对不可避免的事故中,尽管自动驾驶汽车没法规范其他目标的行为,但能提前预判风险,有效的避免事故带来的二次伤害,极大的减少道路交通人员伤亡情况。

自动驾驶安全报告,为什么是现在?百度联合中汽中心、同济大学发布的自动驾驶安全报告,时间点值得玩味。

为什么是现在?当下正在发生什么?

今年自动驾驶行业的大事之一,是L4及以上级别的自动驾驶,开始商业落地。

百度在北京、长沙、广州多地陆续开始L4级RoboTaxi商业化运营,服务人次已经超过40万。

12月初百度还在北京亦庄经开区拿下全国首个RoboTaxi收费试点牌照,商业正循环迈出行业第一步。

另外,老牌车企例如上汽,也紧跟Apollo之后开始探索RoboTaxi商业化运营;新势力小鹏汽车日前也宣布进军RoboTaxi。

乘用车上,典型案例是与百度合作的威马汽车,将百度AVP自主泊车应用在新车型上,在特定ODD内先实现一部分L4功能。

政策方面,截至2021年11月,全国已有38个省/市出台管理细则,先后建设了70家测试示范区,开放了5200多公里测试道路,发放1000余张测试牌照,道路测试总里程超过1000万公里。

而相关的安全法规也逐渐进入立法进程。

2021年3月24日,公安部发布了《道路交通安全法(修订建议稿)》公开征求意见的公告,已明确了具有自动驾驶功能的汽车进行道路测试和通行的相关要求及违法和事故责任分担规定,赋予了自动驾驶系统、道路测试的法律地位,为自动驾驶的规模化商用设立了法律环境。

这说明无论管理部门研判或是行业认知,自动驾驶降临已经不可阻挡。

核心原因,在于以Robotaxi为主要体现的L4自动驾驶,商业化前提初步成熟:

诸如百度这样的头部公司,已经具有去掉安全员的技术实力。

而AI本身的技术特点,又决定了它“接近人”需要很久,而一旦接近人类水准,就会在极短时间内超越人类。

计算机视觉技术中除自动驾驶外的的另一分支人脸识别技术,就是最好的例证。

所以在这样一个时间节点上,加强公众对自动驾驶的认知,协助政策完善、树立行业共识十分有必要。

行业头雁百度,自然有义务承担市场教育的任务。正所谓能力越大,责任越大。

而且如果现在不做,还要等到什么时候?

迫在眉睫的自动驾驶安全科普就在今年,数起辅助驾驶的事故,让舆论有“谈自动驾驶色变”的倾向。

甚至行业内都有人喊出“不要L3、L4,一律叫辅助驾驶”这样的言论。

一刀切的方法,忽略了自动驾驶的本质和目标,也根本不能消除大众疑虑。

对于新技术的推进,还可能起到贻误战机的负面效应。

毕竟众所周知,自动驾驶也是全球新技术周期里,最具颠覆性的关键变革技术,功在当代,利在千秋。

或许也是这种紧迫感,让百度、中汽中心、同济大学站到了台前,让他们冒着风险科普“自动驾驶≠零事故”。

他们联手的《白皮书》用数据和研究说话,证明自动驾驶汽车不能完全避免事故,却比人类司机更加可靠,能把道路交通事故风险或损失大幅降低。

现阶段的自动驾驶,就像诞生之初的汽车、飞机等交通方式一样,正在经历逐渐接受适当风险,定义相对安全的历史阶段。

但问题是,作为《白皮书》的产业主导方,百度为什么能有这样的认知?以及敢于明确这样的认知?

无他,实践出真知。

首先,只有真正将自动驾驶技术大规模应用于商业化场景的公司,才对自动驾驶安全的重要性有切身体会,才有主动拥抱自动驾驶安全的动力。

百度今年陆续公布的自动驾驶商业化布局,涉及RoboTaxi、无人物流、智慧交通、无人巴士、乘用车、矿山等等场景,范围之广、速度之快远超其他玩家。

快速商业化的底气,来自于百度Apollo近10年的技术积累。

2100万公里路测里程、411张测试牌照,背后是真正打通的“数据驱动”闭环,这样才能使数据真正“以战养战”,快速迭代进步。

其次,百度处于行业领先地位,敏锐感受到了行业即将迎来的重要转折。

中国的市场规模、产业链协同、政策准入,还有自动驾驶公司本身技术实力共同促成了自动驾驶产业的成熟和领先。

而开启自动驾驶下一个爆发期的必要条件,就是要回答好安全课题。

让管理部门和公众看到自动驾驶技术的可靠和安全,政策才会更开放,市场才会更广阔。

政策和市场的进步,反过来又能促进技术进步。

百度主导的《自动驾驶汽车交通安全白皮》出台,也为行业今后发展敲响警钟。

安全第一是自动驾驶永远的原则,不过分夸大技术实力,不误导用户。

即使有L4的实力,但谦虚谨慎如L2,可能会走的更稳更快。

One More Thing值得注意的是,《白皮书》中披露了一起由于社会车辆闯红灯,造成百度测试车辆被碰撞的事故。

2021 年在某开放道路测试过程中,由于对向社会车辆闯红灯,导致了一起安全员接管躲闪失误的车辆碰撞。

事发时,测试车辆左转通过交叉路口,对向社会车辆直行闯红灯,进入路口后社会车辆前部碰撞测试车辆右侧前部。

当时,百度自动驾驶测试车行驶至路口中间位置,感知到对向车道内有社会车辆处于运动状态,并根据预测出的行驶轨迹预判其有闯红灯的安全风险。

从安全角度考虑,自动驾驶系统采取制动措施提前避让违规通行的社会车辆。

但同时,测试车上的安全员也看到有车闯红灯朝向测试车驶来,出于驾驶本能,通过踩踏加速踏板的方式进行人工接管,指挥测试车辆在人工驾驶模式下加速行驶, 最终被社会车辆碰撞。

最后的复盘显示,如果自动驾驶系统全程控制、人工驾驶不介入,测试车会及时刹停,社会车辆会从测试车辆前方通过,不会发生此次碰撞。

再总结一下,意思大概就是:除了因为人类驾驶严重违章闯红灯,还因为人类安全员本能反应,否则如果完全交给自动驾驶,能有啥事故呢?

所以这份白皮书,字里行间就一句话:贵人类驾驶,才是交通事故的最大Bug~