同时也把NOP Piolt,这个许多人都未曾听闻的“自动辅助驾驶功能”带到了人们面前。

工作人员告诉车主的朋友,事发时,这辆汽车正处于NOP开启状态,事故原因目前还不明晰。

在这一状态下,车辆可以自主决策和执行车辆换道、并道,不需要驾驶员拨动转向拨杆。

这些技术看起来很先进、很梦幻,但同时也伴随着危险。

可问题是,到底有多少人买车时只知道了“梦幻”,不知道“危险”。

01“别乱说,我们不是自动驾驶”

事故发生后,死者亲友发布的讣告里写下“驾驶蔚来ES8汽车启用自动驾驶功能(NOP领航状态)”。

这一措辞被企业方面否认——

“可以确定的是,蔚来没有提供‘自动驾驶’服务。”

一些网友看来,这仿佛是一场文字游戏,因为此前的新车发布会上,官方还曾直接用上“蔚来自动驾驶”措辞。

“我说你A功能有问题,你怎么告诉我不存在A功能,只有B功能。”

尽管旁观者很疑惑,但对蔚来而言,区分“自动驾驶”和“辅助驾驶”是必须的。

这决定了开车时到底是智能系统主导,还是传统的司机主导。

目前对自动驾驶的分级,普遍是按美国汽车工程师学会的分级制度,从L0到L5。

分水岭是L3,三级以下的车辆,无论何时使用辅助功能,驾驶员都必须处于驾驶状态。

简单粗暴点说,就是甭管功能吹的多天花乱坠,司机都得保持正常开车状态。

而三级以上的车辆,才能被真正地称为“自动驾驶”,开车时不用人管。

但目前,还没有一家公司真正实践了在量产汽车上广泛应用L3级。

这场事故中的NOP,便是L2级,它无法达到大众想象中“人不碰方向盘、车自己开”,只能提供一定的自适应巡航、车道修正、辅助变道等功能。

2017年,奥迪A8最早宣布推出搭载L3级技术的车型,但该车型自面世以来、还未真正应用过这一技术。

全世界范围内,也只有德国日本等少数国家开放了L3级自动驾驶的使用。

也就是说,大众想象中“解放双手的自动驾驶”,就未曾出现在中国的日常出行中。

可如果抛开普通人甚少了解的分级制度,你会发现能让人产生“实现自动驾驶”错觉的措辞遍地都是。

2021年世界人工智能大会上,小鹏汽车副总裁纪宇说“小鹏汽车目前能做到L2.75级自动驾驶。”

认证为蔚来副总裁沈斐的微博号@Mr_沈斐曾发布一条微博,说“NIO Pilot越来越上瘾”,“放心地边吃东西边开车”。

最初,特斯拉对辅助驾驶系统Autopilot的介绍是“全自动驾驶硬件”。

2019年时,大家发现这一介绍悄悄地变成了“驾驶的未来”。

中国官网上,特斯拉一直将Autopilot直译为“自动驾驶”,但按官方设定,就算启动这一系统,司机也要手握方向盘。

直到2016年多起事故后,才将其翻译为“辅助自动驾驶”。

与营销话术上的混乱相对应的是,普通网友关于“自动驾驶”的认知是极易被模糊的。

随便点开一篇相关车企介绍文章,留言区的读者以为当下的“自动驾驶”可以与“开车可以睡觉”相挂钩。

一些车型进行“自动驾驶”挑战或测试的视频里,司机将双手离开方向盘进行实验。

其实从2015年特斯拉装车实现量产后,“自动驾驶”就一直处于概念比技术响亮的状态。

2016年时,马斯克宣传过“特斯拉大约两年内实现全自动驾驶”的愿景,并开始出售“完全自动驾驶”套餐。

客户需要额外缴纳3000美元的费用,来“等待这一系统的诞生”。

作为国产新势力车企的领头羊,蔚来身上也贴有“自动驾驶的中国制造”标签。

但与车主们为信仰买车不匹配的是,“自动驾驶”的利弊很少明朗地被呈现到大众面前。

02目前还没有完美的“自动驾驶”

一位蔚来车主表示,提车时,销售对车上的NIO Pilot功能进行了告知。

譬如泊车辅助不等同于自动驾驶,双手不要随意离开方向盘。第一次开启功能时,屏幕上也出现了文字提醒。

用户手册中,其实也有详尽的系统使用注意事项。

从程序上看,蔚来尽到了告知的义务。

但这位车主同时也表示听完后还是没搞懂,他反问销售“你的意思是,这车不能自动驾驶是吗?”

销售把宣传单上的文案又重复了一遍:“蔚来自动驾驶系统仅为辅助驾驶之目的而设计。”

始终让他疑惑的是,“自动驾驶”的功能到底有没有?

电影《速度与激情》系列

电影《速度与激情》系列在复杂精密的技术面前,普通人的第一认知往往只能到“有没有”“能不能用”的地步。

大家既不可能像工程师一般、对使用细节了如指掌。也不可能完全理解这套系统运行与失效的原理。

譬如,不少网友就对这次事故中汽车撞上工程车无法理解,“那么大的车,系统都识别不出来吗?”

实际上,识别算法一直是自动驾驶的痛点。

2016年5月,美国车主启用特斯拉自动驾驶辅助功能时,撞上了一台正在转弯的货车,不治身亡。

马斯克称,事故原因是雷达将前方的车辆当做了高速路上横跨道路的标牌,所以没有刹车。

2021年5月美国加州,一辆特斯拉处于功能开启状态时,径直撞上了路中央侧翻的白色货车,司机当场身亡,

调查结果显示,车辆将白色货车识别成了天空和云。

还有诸多类似事故,被怀疑或已经认定为源于系统识别的问题。

电影《速度与激情》系列

电影《速度与激情》系列2020年9月山东青岛,一名理想车主开启“自动辅助驾驶系统”时,系统未识别到正在向左变道的大货车,并道时与大货车发生追尾。

这次事故经交管部门判定,大货车违规并线承担全责,理想也发布公告提醒“要以驾驶员为主控制车辆”。

结果,事件仅一个月后,湖南郴州又发生一起理想汽车追尾大货车的事故。

同样是开启功能的情况下,未识别大货车变道。

机器的认知模式终究与人类不同,人眼或许能轻易地识别不同形状、不同颜色的工程车,能辨认出光影。

但对系统来说,有时影子的形状都可能被识别成物体。

知乎上,一位认证为“小鹏汽车 大数据工程师”的用户举例,一道桥上的护栏在特定时分投下的光影,光带像车道线,而真正的车道线却被阴影遮住。

这一特性导致,自动驾驶系统势必需要依赖海量的数据,就像教小孩识物时,需要给他看足够多的画面。

不只是常规驾驶画面,还需要很多类似大货车变道、遇上工程车的个例。

@汽车营销分析此前发布了一段蔚来车主提供的视频,夜间行车时系统并未识别出路面上的事故车辆。

还好他反应及时,赶紧接管绕了过去,险些撞上路面的三角警示牌。

相似的多起事故足以证明,这些辅助驾驶系统还存在着漏洞与不足。

但弥补缺陷的方法,除了催促车企们“继续改进”,只剩了一句说给普通车主们的“应保持警惕,不过度依赖系统”。

“自动驾驶”技术的支持者们,可以凭信仰买车。

但正在“自动驾驶”赛道上狂奔的企业们,却不该撒手让车主们凭信仰开车。

03企业不能只会“讲故事”

在汽车圈内,特斯拉、蔚来等新势力车企的粉丝一直是个有点特殊的团体。

如果以方便理解的娱乐圈作比,奔驰宝马大众这些燃油车起家的汽车品牌,就像是老牌明星。

而特斯拉、蔚来、理想等品牌,就像是新冒出的养成系明星。

区别在于,老品牌们和老牌明星一样,在几十上百年的发展历史里“作品”足够多。

无数人的驾驶经验与体验,最后塑造出了一个汽车品牌的形象。

而特斯拉们展露头角时“还没出道”,只是向大众提供了一个憧憬与概念。

就像选秀明星一般,先讲了一个美好的故事,提供人设与梦想、再慢慢成长。

正是这个“故事”,让无数人成为了这些养成系品牌的粉丝。

电影《速度与激情》系列

电影《速度与激情》系列特斯拉造电动车,就时常被看做是一个“硅谷小子大战底特律巨头”的故事。

极富理想主义色彩的CEO马斯克,喊着要推动世界能源体系转型的目标。

带着一群硅谷工程师,用IT理念造汽车,并邀请人们参与众筹、加入他宏大的愿景。

之后又搬出了惊为天人的造火箭、造星链计划。

马斯克一直在向用户许诺,特斯拉正在接近真正的“自动驾驶”。

甚至底下员工甚至不得不站出来提醒,特斯拉目前还没做到,Autopilot系统开启时司机的双手不能离开方向盘。

与宏大理念相对应的是,特斯拉、蔚来们的确在新能源汽车的技术、理念的实践上取得了进展与突破。

譬如打出“用户企业”概念的蔚来,正在着手建造方便汽车续航的换电站。

这足以获得支持者们的信任,实际上,这份信任也是用户购车的重要原因之一。

@财经采访事故车主的好友林伟伟,而林伟伟表示,车主在购买蔚来前多次向销售人员询问“自动驾驶”。

他非常信赖NOP,并认为“自动驾驶是电动车与油车的区别”。

站在车主的角度,自己赚的钱自己花,当然可以“凭信仰买车”。

但企业却不能,只靠信仰卖车。

在自动驾驶系统与辅助驾驶系统都不够完善的前提下,倘若企业把风险都推给个人承担,是不合理的行为。

2012年,谷歌内部曾让一些普通员工参与高速公路驾驶系统测试。

尽管司机们被警告该系统尚未完全自主,要求他们把目光始终投向地面,研究团队依旧发现司机们很快开始过于信任系统。

车载摄像头提示,被测试者正在“小睡、化妆和摆弄手机”。

这本就是个很难靠个人自制力规避的困局,企业总不能把新技术往车主面前一放,说:

“你可以相信我们的系统,但又不能完全相信。”

昨天,理想汽车CEO发了条朋友圈,认为继续规范自动驾驶领域的宣传话术。

但或许,与修正营销手段同样重要的是,企业们也需要在系统中纳入强制提醒司机集中注意力的机制。

类似于火车上的刹车踏板,司机需要每隔半分钟踩一下、证明是有人状态。

可以预见的是,倘若“自动驾驶”技术真有技术成熟、落地的一天,或许全世界的交通运输业都会因此震颤、改变。

但在这宏大愿景实现之前,不该把一切缺陷都寄希望于个人补足,让车主也只凭信仰开车。

蔚来致死事故后,希望“L2.5”们也跟着去世。

先说一句:

现在所有量产车上的自动驾驶全 tm 是辅助驾驶。

把辅助驾驶送上神坛的,每一个过度宣传自动驾驶的车企都有责任。

最近发生了件事大家应该都听说了,一辆开着自动辅助导航驾驶功能( NOP )的蔚来 ES8 在高速上出车祸了,驾驶者不幸身亡,年仅 31 岁。

这辆车出事的原因,据说是因为开着 NOP 的 ES8 没有识别出前方的障碍物,导致车辆在高速路上发生碰撞,最后酿成悲剧。

车子的驾驶者是国内知名餐饮连锁品牌美一好的创始人林文钦,事发后,蔚来的 CEO 和总裁秦力洪纷纷在蔚来线上社区向逝者表达了默哀。

不过对于事故的原因,蔚来说自家的NOP 只是辅助驾驶,并不是自动驾驶,所以事故责任应该是驾驶者。

这话好像在哪见过?

没错,当年特斯拉的Autopilot 出事的时候也是用了相同的话术,出事之前是自动驾驶,出了事,就是辅助驾驶。

到现在, Autopilot 也依然像个没事人一样继续宣传,监管机构也没认定特斯拉存在过失,更没进行处罚。

所以,要判断厂商们是不是过度营销,其实还存在判定标准上的难题。

咱们现在看到的 L2 , L3 啥的这些 “ 自动驾驶 ” 的分级,其实都来自于美国机动车工程师协会( SAE )的标准。

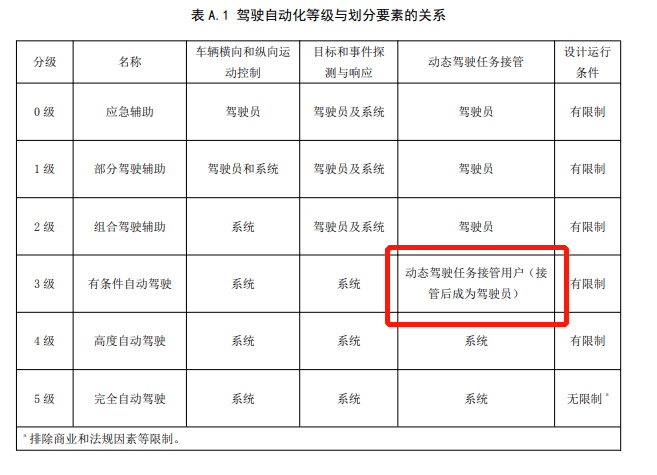

不光是 SAE ,我们国家也有类似的标准( 处于公示阶段 )。

但这里需要强调的是!

上面这些压根不是什么自动驾驶分级标准,它的名字叫汽车驾驶自动化分级。大家细品,这两个概念放在一起看,是不是就有点厂商们居心不良的意思了?

再来看看这份标准中大家最关心的部分,也就是关于 L0-L5 的描述。

我们以 SAE 为例:

蓝色部分就是 L0-L2 的要求,明确写着驾驶员支持功能,我们可以理解为辅助驾驶或驾驶自动化。

咱们平时看到的,自动泊车、自适应巡航这些都是 L2 以下的。

绿色部分是 L3-L5 的要求,写着自动驾驶功能相关要求。

在这个级别,则要求全场景巡航、自动避障、云端驾驶等。

所以,对于目前宣称达到 L2 级别的所有车型,它压根就是辅助驾驶,或者专业的说叫驾驶自动化系统。

但是这些车企们又怎么叫,小鹏的是自动驾驶辅助系统 XPILOT ,蔚来的是自动辅助驾驶系统 NIO Plilot 。

好家伙,翻译过来还是辅助驾驶,到这儿就变成自动驾驶辅助了,换个主语眼睛都不带眨的。

可能有小伙伴会问,那之前有销售跟我说他们的车实现了 L2.5 级别的自动驾驶,这也不算是自动驾驶吗?

首先, SAE 这个标准本来是行业性标准,它压根就不是拿来评价车辆自动驾驶的能力,不存在官方的那种强制约束力。

就好比是,我实现了 L3 里的某些功能,也比 L2 要更高级,那我起个 L2.5 你也不能拿我怎么样。

我们退一万步讲,既然现在大家都用 SAE 的这个分级来做宣传,那是不是得遵守人家的分级规则?

人家 SAE 的表里压根没什么 L2.5 ,更别提什么 L2+ , L2.9 了。

所以说,那些宣传 L2.5 , L2+ 的,不是他们自己蠢就是心里憋着坏。

除此之外,有些车企也宣传我们是在某些特定场景下可以实现 L3 级别的自动驾驶,按 SAE 的标准 L3 就是 L3 ,也压根没有什么特殊情景下实现 L3 的这个说法。

归根结底,压根就不应该这么过度营销。

过度营销直接导致消费者们对于车辆辅助系统的盲目自信,高速撒手开车,躺着睡觉的视频已经快屡见不鲜了。

万一弄出了像蔚来这次的事故,这责任划分谁都掰扯不清楚。

关键是这责任你不能全怪车企,为啥呢?因为目前法律没有针对自动驾驶这块的相关法规。

威马汽车的 CEO 提出说, L0-L2 的事故责任都在驾驶者, L4-5 的责任都在车企。

因为 L2 以下的辅助驾驶,驾驶员是操作主体,也是责任主体。L4 以上的自动驾驶,操作主体是车辆本身,承担主要责任的应该是车企。

而 L3 这部分其实是最难难划分的地方。

举个国内这边的自动化驾驶等级划分标准来说。

从上图红圈的这个要求里可以看出来,在 L3 级别下,用户必须具备识别自动驾驶系统发出的请求或故障的能力,并且在接管车辆以后成为驾驶员。

说白了,就是当自动驾驶出现问题时,你要能发现问题并及时接管车辆,就是在 L3 级别下你要适度的参与。

而 L2 级别,你就必须时时刻刻的盯着它,有特殊情况要立即上手。

所以,在 L3 级别下出事,到底是人的问题还是车的问题这就说不清了,那些 L2+ 的就更说不清楚了。

不过这也不能怪标准的制定者,因为对于这部分,大家都是刚刚开始研究的小白,现在谁都没办法提出一个明确的界限划分。

那真就无能为力了吗?

也不是,首先就是监管发力,比如美国 NHTSA 对特斯拉的监管和审查。

这两天,美国国家公路交通安全管理局( NHTSA )宣布启动对特斯拉的 Autopilot 自动辅助驾驶系统的调查。

因为从 2016 年到现在,仅仅是 Autopilot 故障所造成的事故就有 30 起,造成 10 人死亡。

所以,NHTSA 也准备通过新一轮调查来判断Autopilot 是否能达到特斯拉所宣传的效果,存不存在误导用户的虚假宣传情况。

其次,在国内这边, SAE 与 CATARC 在 2020 年联合推出 CL2 级中国首个智能驾驶等级认证规则。

目前已经有 4 家企业的多款车型通过认证,但是这个CL2 级智能驾驶认证也不是强制性的,只能说是给我们消费者们提供了些权威性的意见。

要想真正解决车企们夸大宣传虚假营销的乱象,靠监管或者 CL2 认证还远远不够。

还得回到车企本身。

别再拿什么自动驾驶、智能驾驶、无人驾驶当噱头来宣传,有这功夫埋下头去老老实实钻研技术不好吗?

等技术真正开发出来,还能率先在标准划定领域展现自己的实力,这不比搁那打嘴炮强多了。

在其他领域,你夸大宣传了充其量就是货不对板,产品没那么好用。

但这玩意儿误导了消费者的认知以后,是会出人命的。在技术和标准严格规范之前,整个行业应该以人为本,好好说人话。

夸大宣传,也可以杀人。