在遇到一个弯道时,汽车未能跑过去,而是直接冲出街道,撞到附近一棵大树上。

大火瞬间覆盖车身,汽车被烧得焦黑,没有人从里面逃出来。

这辆撞树的汽车是2019年款的特斯拉Model S。因为是电动汽车,里面的电池在被火浇灭后不断复燃,消防员们连续用了4个小时才扑灭大火。平常,这只需要几分钟。

因为缺乏经验,消防员还一度打电话询问特斯拉公司,电池燃烧该怎么灭。在用了3万加仑的水后,火终于熄了。

接着,一个令人吃惊的景象出现在人们眼前:

有两具尸体分别坐在前排乘客座,和后排座位上,

但是,司机座位上没有人!

也就是说,这两人是在真正意义上的“无人驾驶”时出车祸的。

哈里斯县第4区的警员马克·赫曼(Mark Herman)向媒体确认了这个消息。死者的家属随后也现身,表示这两人是想晚上兜风,“顺便测试特斯拉的自动驾驶性能”。

这起车祸,对特斯拉是一起沉重打击。

上周六,马斯克发布了公司最新的安全报告,并在推特上写道,“有着自动驾驶的特斯拉发生事故的可能性比普通汽车低10倍”。

但是,美国汽车安全管理局在上月起已经对特斯拉展开27项调查,调查的重点正是它的自动驾驶。

根据特斯拉在官网上的描述,“自动驾驶”是一套“先进的驾驶辅助系统,能够提高驾驶的安全性和便捷性”。

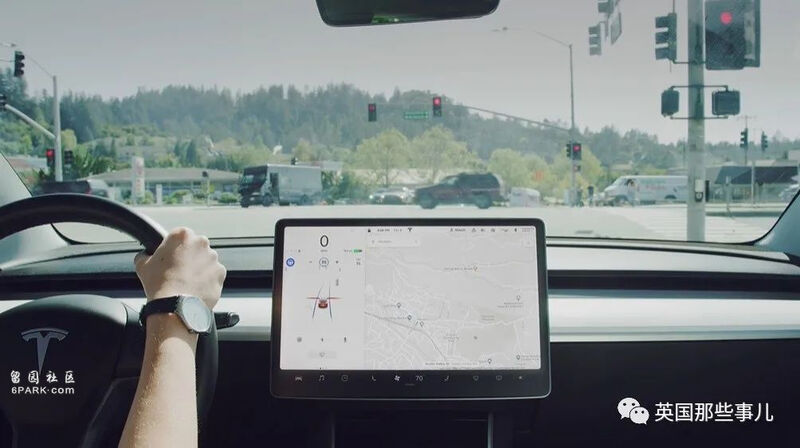

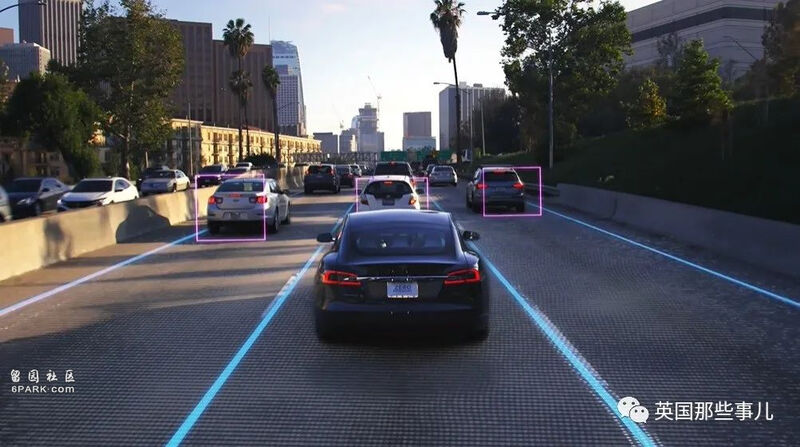

它配备有8个外部摄像头、1个雷达、12个超声波传感器,和一个车载平板电脑。这些设备能够探测出周围的环境,帮助汽车在车道内自动转向、加速和制动。

根据人们的印象,既然有自动驾驶,那么就不需要司机出力了。甚至可以完全不需要司机,实现无人驾驶。

特斯拉激进的宣传策略,也让人们误以为它可以做到这种地步。“无需驾驶”是特斯拉的一大卖点。

从2019年起,特斯拉所有汽车都配备“自动驾驶”系统。在去年10月,它也开始推广“全自动驾驶”的测试系统,邀请1000多名志愿者和顾客上街测试。

但不管是之前的“自动驾驶”,还是现在的“全自动驾驶”,特斯拉的汽车离科幻小说中不需要司机的情景离得很远。

根据加州机动车管理局和特斯拉最近的沟通文件,哪怕是特斯拉最新版本的车,也只有2级自动驾驶水平,也就是需要司机时刻把手放在方向盘上,控制汽车的部分功能。

想要让汽车和人类一样智能,能够在所有交通环境和天气条件下自动驾驶,需要5级水平。福特等汽车厂商表示,想要实现这种技术,至少还有十几年时间。

但马斯克过去几年不停嚷嚷着“2021年就能实现完全的自动驾驶”,这给了人们很大的误解。

实际上,从2016年起,就有不少人因为过于信赖特斯拉的“自动驾驶”技术,遭遇车祸,甚至丧命。

2016年5月,一个名叫约书亚·布朗(Joshua Brown)的海军退伍军人在佛罗里达州威利斯顿附近遭遇车祸。

他是特斯拉的粉丝,“自动驾驶”技术刚推出的时候他就使用过,还在自己的油管频道上赞叹,“我根本不用开车,什么都不用做!”

但在某次开特斯拉Model S时,系统没有分辨出明亮天空下的白色卡车,导致特斯拉直接冲上去,车顶都被掀开,人当场死亡。

2018年3月,一名苹果公司工程师在加州山景城的车祸中丧生,他当时正开车特斯拉赶去上班。

根据美国国家运输安全委员会的调查,这名工程师在事故发生以前,多次向兄弟和妻子抱怨过自动驾驶不智能的问题。

调查上称:“很多次,当司机在左侧车道经过事故发生地时,特斯拉都会自动往左开向高速公路和入口车道之间的三角区。他不得不手动控制,让车保持在车道内。”

“他向家人展示过,特斯拉经过这个地点时是如何开的。他也向特斯拉服务中心求助,告诉技术员这个问题。”

但是这么多次小心,还是比不过一次不小心。在事故发生前10秒,工程师打开了自动驾驶系统,他当时的手也没有放在方向盘上。

在特斯拉经常开错的地方,恰好有一辆货车,特斯拉以每小时109公里的速度冲过去,半边门被扯碎,工程师也死了。

去年,这样的事故发生在中国台湾。在上午6点44分,光线明亮的情况下,有一辆货车侧翻在地,路过的车辆纷纷避让。

但当一辆白色特斯拉Model 3经过时,司机似乎完全没有看到,以每小时110公里的速度冲向货车,撞击严重。

幸好,司机活了下来,他表示特斯拉当时处于自动驾驶状态,因为信任系统,他以为车会自动让开。

当他意识到特斯拉不会减速,想要接管时,已经晚了。

因为这样的事故不少,特斯拉在使用手册中不得不强调,就算是用自动驾驶,也需要司机全程参与,必须把手放在方向盘上,随时准备介入。

为了防止人们实现“真·无人驾驶”,一旦驾驶座和方向盘感受不到人的存在,汽车就会发出警报。

但这么设计就和人们想要的“方便、轻松”违背了,如果要人全程投入,和普通汽车有什么差别呢?

于是,不少人开始钻空子,想出稀奇古怪的方法让特斯拉误以为驾驶座上有人。

还有人在Tiktok上发视频,炫耀自己的特斯拉无人驾驶也能开。

甚至有人发教学视频,教人们该怎么做。

这次发生的事故,就是休斯顿的两名59岁和69岁的大爷学会了特斯拉的“黑科技”,想感受一把无人驾驶。结果,就出事了。

汽车安全中心的董事詹森·莱文(Jason Levine)认为,这些事故的根源,就在于起名不当,“自动驾驶”这个名词太有误导性。

“自动驾驶,意味着汽车可以自己驾驶,包括自动停车。但目前的特斯拉其实很难做到这些。这个名词是让消费者相信,汽车能做它实际做不到的事。”

南卡罗莱纳大学的教授布莱恩特·史密斯(Bryant Smith)也认为,特斯拉的营销策略和名词使用,是暗示甚至鼓励司机将注意力从道路上移开,让他们干自己的事。

“这家公司创始人所说的、让人们相信的东西,和他们的系统实际能做到的东西,存在不可思议的脱节。”

其实,就算特斯拉强力要求司机们在自动驾驶时全程注意,这也是不可能的。

因为人们在没有任务的时候容易困倦、走神,等到真的出现危险,想调转注意力避开,会非常困难。

无人驾驶、全自动驾驶,这些概念虽好,但人们还需要一段时间才能实现。

目前,还是谨慎地靠自己开车吧,车祸这事,就算只发生一次都够糟糕了……